TL;DR

📋 핵심 발견

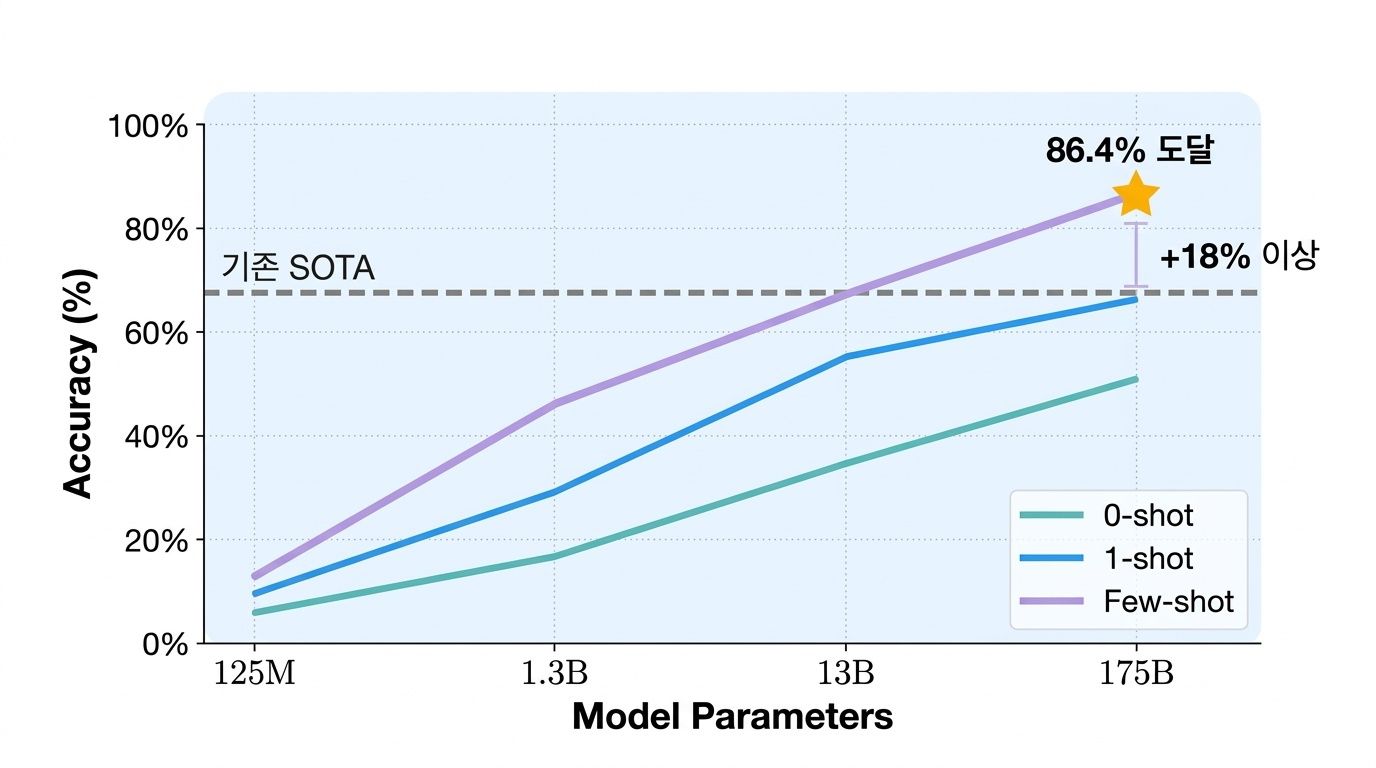

1,750억 파라미터의 GPT-3는 LAMBADA 벤치마크에서 Few-shot 86.4% 정확도를 달성하며, 당시 SOTA(Turing-NLG 17B의 68.0%)를 18% 이상 경신 — 모델을 크게 만들고 예시 몇 개만 보여줘도 fine-tuning 없이 고성능이 가능함을 최초로 대규모 실증

GPT-3가 생성한 뉴스 기사를 인간이 구별하는 정확도가 52%로, 동전 던지기(50%)와 거의 같은 수준 — 거대 언어 모델이 인간 수준의 텍스트를 생성할 수 있음을 보여주며 AI 생성 콘텐츠의 사회적 논의를 촉발

125M부터 175B까지 8가지 크기의 모델을 체계적으로 비교하여, 파라미터 수 증가에 따른 성능 향상이 멱법칙(power law)을 따르며, 특히 Few-shot 능력은 모델이 클수록 불균형적으로 급증함을 실증

별도 학습 데이터 없이 3자리 수 덧셈·뺄셈에서 100% 정확도, 2자리 곱셈에서 29.2% 정확도를 달성 — 언어 모델이 명시적으로 학습하지 않은 추론 능력까지 '창발(emergent)'할 수 있음을 시사

Language Models are Few-Shot Learners

arXiv: 2005.14165

💡이 논문이 등장한 배경

2020년 이전의 NLP 세계는 '전문가 양성' 모델이 지배하고 있었습니다. BERT, RoBERTa 같은 모델은 범용적으로 언어를 이해하는 능력을 사전학습(pre-training)으로 쌓은 뒤, 각 작업(번역, 감정 분석, 질의응답 등)마다 수천~수만 개의 라벨링된 데이터를 모아 별도로 미세 조정(fine-tuning)해야 했습니다. 마치 훌륭한 기초 체력을 가진 운동선수가 있지만, 축구를 하려면 축구 훈련을, 농구를 하려면 농구 훈련을 따로 시켜야 하는 것과 같았습니다.

이 방식에는 근본적인 한계가 있었습니다. 첫째, 새로운 작업이 등장할 때마다 대규모 라벨링 데이터가 필요했는데, 이는 비용이 많이 들고 때로는 불가능했습니다. 둘째, fine-tuning 과정에서 모델이 특정 데이터셋의 패턴에 과적합(overfit)되어, 실제 세계의 다양한 상황에 취약해지는 문제가 있었습니다. 셋째, 인간은 새로운 작업을 배울 때 수만 개의 예시가 필요하지 않습니다. 설명 한 줄과 예시 서너 개면 충분합니다.

GPT-3 논문의 저자들은 이렇게 질문했습니다: "모델을 충분히 크게 만들면, fine-tuning 없이 텍스트 프롬프트만으로 새로운 작업을 수행할 수 있지 않을까?" 이것은 단순한 기술적 개선이 아니라, NLP의 패러다임 자체를 바꾸려는 도전이었습니다.

🔍 핵심 아이디어

GPT-3의 핵심 아이디어는 놀랍도록 단순합니다: 모델을 아주, 아주 크게 만들면, 별도의 훈련 없이 '문맥 속 학습(in-context learning)'만으로 다양한 작업을 수행할 수 있다. 이것은 마치 엄청나게 많은 책을 읽은 사람에게 "이런 식으로 해줘"라고 예시를 몇 개 보여주면, 처음 보는 작업도 곧바로 해내는 것과 같습니다.

이 시각자료는 GPT-3가 사용하는 세 가지 인컨텍스트(in-context) 학습 방식과 전통적인 미세 조정(Fine-tuning) 방식의 차이를 보여줍니다. Zero-shot, One-shot, Few-shot은 모델의 가중치를 업데이트하지 않고 추론 시 입력 텍스트(컨텍스트)만을 통해 작업을 수행하는 반면, Fine-tuning은 대량의 데이터를 통해 모델 가중치를 직접 수정합니다. GPT-3는 별도의 그래디언트 업데이트 없이 텍스트 상호작용만으로 새로운 작업을 학습하는 '메타 학습' 능력을 강조합니다.

위 다이어그램에서 볼 수 있듯이, GPT-3는 세 가지 방식으로 새로운 작업에 접근합니다. Zero-shot은 작업 설명만 주고 바로 수행하게 하는 것이고("영어를 프랑스어로 번역해: cheese =>"), One-shot은 예시 하나를 보여주는 것("sea otter => loutre de mer"), Few-shot은 예시를 10~100개 정도 보여주는 것입니다. 핵심은, 이 세 방식 모두 모델의 가중치(weight)를 전혀 업데이트하지 않는다는 점입니다. 모든 '학습'이 입력 텍스트(컨텍스트) 안에서만 일어납니다.

이것이 기존의 fine-tuning과 근본적으로 다른 점입니다. Fine-tuning은 수천~수만 개의 예시를 통해 모델의 뇌(가중치)를 물리적으로 재구성합니다. 반면 in-context learning은 모델의 뇌는 그대로 두고, 입력으로 주어진 맥락만을 활용하여 패턴을 파악합니다. 시험 전에 교과서를 다시 공부하는 것(fine-tuning)과, 시험지에 적힌 예시 문제만 보고 출제 의도를 파악하는 것(in-context learning)의 차이라고 할 수 있습니다.

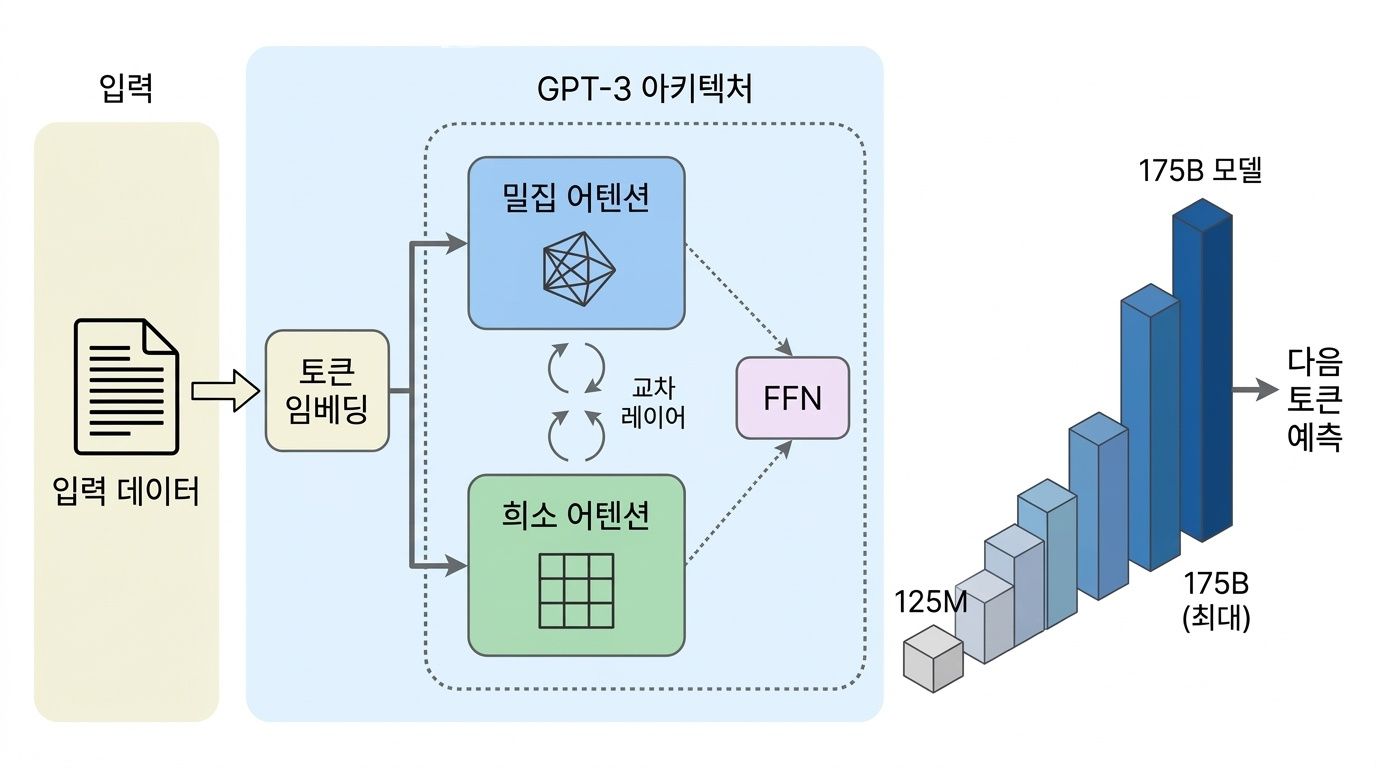

GPT-3는 GPT-2의 아키텍처를 계승한 자기회귀(autoregressive) Transformer 기반 모델입니다. 효율적인 연산을 위해 교차 밀집(alternating dense) 및 국소 밴드 희소 어텐션(locally banded sparse attention) 패턴을 사용합니다. 논문에서는 125M부터 175B까지 총 8가지 크기의 모델을 비교 분석하며, 175B 모델이 가장 거대한 성능을 발휘함을 명시합니다.

아키텍처 자체는 GPT-2와 동일한 자기회귀(autoregressive) Transformer입니다. 혁신은 구조가 아니라 규모에 있었습니다. 96개 레이어, 96개 어텐션 헤드, 12,288 차원의 모델 — 총 1,750억 개의 파라미터. 이전 최대 모델(Turing-NLG 17B)의 10배 규모입니다. 효율적인 연산을 위해 교차 밀집(alternating dense)과 국소 밴드 희소 어텐션(locally banded sparse attention)을 번갈아 사용했지만, 핵심 메시지는 분명했습니다: 같은 구조라도 충분히 크게 만들면 질적으로 다른 능력이 나타난다.

이 논문이 "scaling hypothesis(스케일링 가설)"를 강력하게 뒷받침한 이유가 바로 여기에 있습니다. 모델의 크기를 키우는 것이 단순히 기존 성능을 조금 높이는 것이 아니라, fine-tuning 없이도 작업을 수행하는 완전히 새로운 능력을 '창발(emerge)'시킨다는 것을 보여줬습니다.

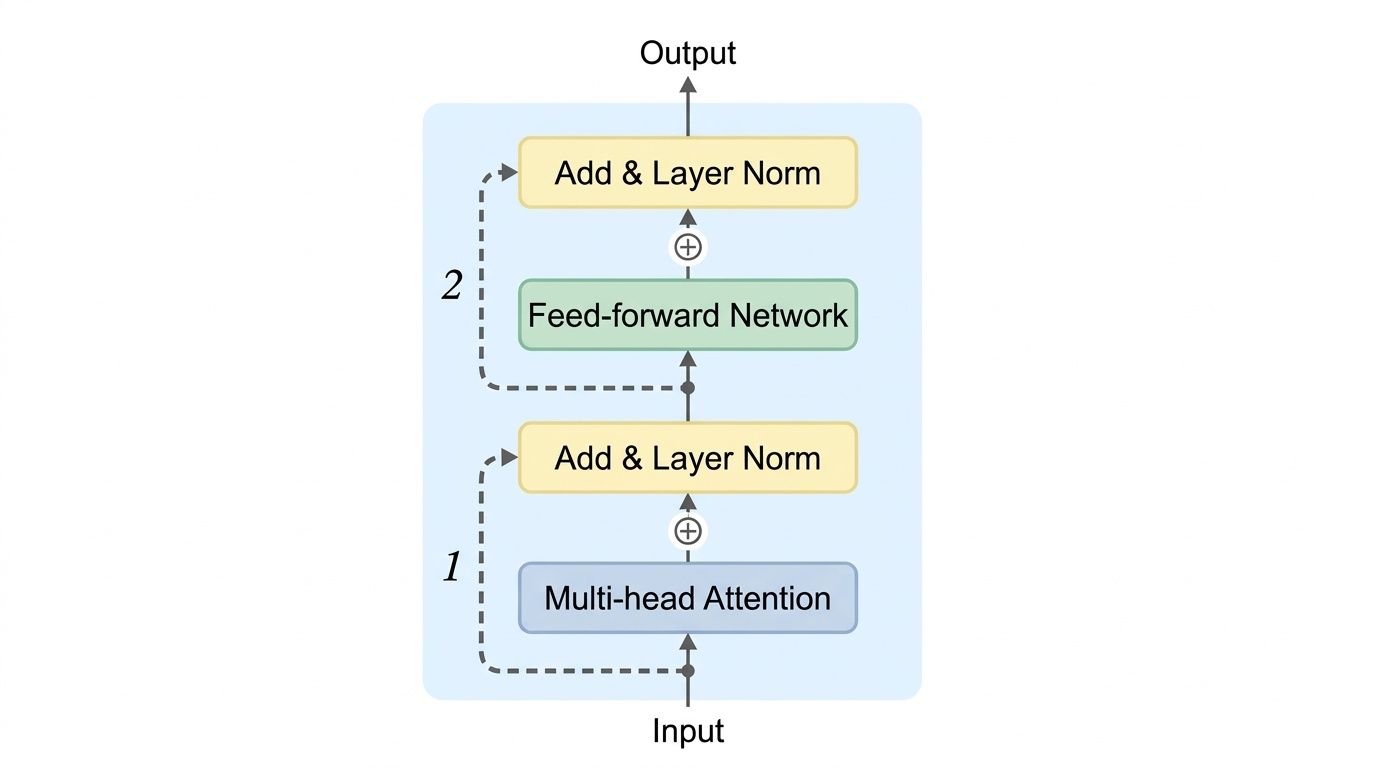

트랜스포머의 단일 인코더 레이어(또는 디코더 레이어)의 상세한 내부 구조를 시각화합니다. Multi-Head Attention 서브 레이어와 Position-wise Feed-Forward Network 서브 레이어를 보여주고, 각 서브 레이어를 감싸는 Residual Connection과 Layer Normalization이 어떻게 적용되는지 흐름을 나타냅니다.

그런데 RNN을 제거하면 한 가지 중요한 정보가 사라집니다 — 바로 단어의 순서입니다. Self-Attention은 본질적으로 집합(set) 연산이라 '나는 밥을 먹는다'와 '밥은 나를 먹는다'를 구분하지 못합니다. 이 문제를 해결하기 위해 Positional Encoding을 도입했습니다. 각 위치에 고유한 패턴의 사인/코사인 함수 값을 생성하여 입력 임베딩에 더해줍니다. 이를 통해 모델은 단어의 절대적 위치뿐 아니라 상대적 거리도 학습할 수 있습니다.

🤔 어떻게 작동하는가

Step 1: 거대한 데이터로 세상의 언어를 학습하기

GPT-3는 인터넷에서 수집한 약 3,000억 개의 토큰으로 학습됩니다. 하지만 모든 데이터를 동등하게 취급하지는 않습니다. Common Crawl(4,100억 토큰)이 양적으로 압도적이지만, 품질이 높은 Wikipedia(30억 토큰)와 WebText2(190억 토큰)는 실제 학습에서 각각 3%와 22%의 비중으로 '과대 대표'됩니다. 마치 시험 준비할 때 인터넷 글을 대량으로 훑되, 교과서와 참고서는 여러 번 반복해서 읽는 것과 같습니다.

GPT-3 학습에 사용된 데이터셋의 양과 실제 학습 시 반영된 가중치(Training Mix)를 나타냅니다. 데이터의 양 자체는 Common Crawl이 압도적으로 많지만, 품질이 높은 Wikipedia나 WebText2 같은 데이터셋은 실제 토큰 수보다 더 높은 비중으로 샘플링되어 학습에 반영되었습니다. 총 3,000억 개의 토큰을 학습하는 과정에서 고품질 데이터는 여러 번(최대 3.4회) 반복 학습되었습니다.

Step 2: 다음 단어를 예측하며 언어의 패턴 흡수

학습 방식은 단순합니다 — 주어진 텍스트의 다음 단어를 예측하는 것. "The capital of France is"라는 입력이 들어오면 "Paris"를 출력하도록 학습합니다. 이 단순한 목표를 3,000억 번 반복하면서, 모델은 문법·사실·추론·번역 패턴까지 암묵적으로 흡수합니다. 1,750억 개의 파라미터는 이 방대한 패턴을 저장하는 용량을 제공합니다.

Step 3: 스케일링 — 크기가 만드는 질적 변화

논문은 125M부터 175B까지 8가지 크기의 모델을 훈련하여 스케일링 효과를 체계적으로 검증합니다. 결과는 명확합니다: 모델이 커질수록 모든 설정(Zero/One/Few-shot)에서 성능이 올라가지만, 특히 Few-shot의 이득은 모델이 클수록 불균형적으로 커집니다. 작은 모델에게 예시 10개를 보여줘도 별 차이가 없지만, 1,750억 파라미터 모델에게 같은 예시를 보여주면 성능이 급등합니다. 이는 in-context learning 능력 자체가 규모의 함수임을 시사합니다.

모델 파라미터 수가 증가함에 따라 NLP 작업의 성능이 일관되게 향상되는 스케일링 법칙을 보여줍니다. 특히 LAMBADA 작업에서 175B 모델의 Few-shot 성능은 86.4%에 도달하여 기존 최고 기록(SOTA)을 18% 이상 경신했습니다. 이는 거대 모델일수록 컨텍스트 내의 예시를 활용하여 작업을 파악하는 능력이 비약적으로 상승함을 입증합니다.

Step 4: In-Context Learning — 프롬프트가 곧 프로그램

추론 시, 사용자는 자연어로 작업을 설명하고 선택적으로 예시를 제공합니다. 모델은 이 입력을 2,048 토큰의 컨텍스트 윈도우 안에서 처리하여 응답을 생성합니다. 핵심은 그래디언트 업데이트가 전혀 없다는 것입니다 — 모델의 가중치는 학습 시 고정된 채로 유지됩니다. 이것은 프롬프트 자체가 일종의 '소프트 프로그래밍'이 되는 패러다임의 시작이었습니다.

Step 5: 데이터 오염 방지 — 정직한 평가를 위한 노력

인터넷 규모의 데이터로 학습하면, 테스트 데이터가 학습 데이터에 포함될(data contamination) 위험이 있습니다. 논문은 이를 인지하고 n-gram 기반 중복 검출을 수행하여, 오염이 성능에 미치는 영향을 벤치마크별로 분석합니다. 일부 벤치마크에서 오염이 발견되었지만, 대부분의 경우 오염된 데이터를 제거해도 성능 차이가 미미했다고 보고합니다.

🛠️ 실험이 말해주는 것

GPT-3의 실험 결과는 크게 세 가지 메시지를 전달합니다.

첫째, 스케일링은 범용적으로 작동합니다. 언어 모델링, 독해(reading comprehension), 번역, 질의응답 등 거의 모든 NLP 태스크에서 모델 크기와 성능 사이에 명확한 양의 상관관계가 나타났습니다. LAMBADA에서의 86.4% Few-shot 정확도가 대표적이지만, SuperGLUE에서도 Few-shot으로 71.8 점을 달성하여 fine-tuned BERT large(69.0)를 넘어섰습니다. 단, fine-tuned SOTA(89.0)에는 미치지 못하여, in-context learning이 모든 상황에서 fine-tuning을 대체하지는 못함도 명확히 했습니다.

둘째, GPT-3는 예상치 못한 능력도 보여줍니다. 3자리 덧셈·뺄셈에서 100% 정확도, 단어 언스크램블(word unscrambling), 새로운 단어를 문장에 사용하기 등 명시적으로 훈련하지 않은 추론 작업에서도 의미 있는 성능을 달성했습니다. 이는 후에 "emergent abilities(창발적 능력)"이라는 개념으로 발전합니다.

모델의 크기가 커질수록 인간 평가자가 AI가 생성한 뉴스 기사와 실제 기사를 구별하기가 점점 더 어려워짐을 보여줍니다. 가장 큰 175B 모델의 경우 인간의 식별 정확도가 52%에 불과하여, 사실상 무작위 추측(50%)과 차이가 없는 수준의 고품질 텍스트를 생성합니다. 이는 거대 언어 모델이 생성한 콘텐츠의 사회적 영향력과 오용 가능성에 대한 시사점을 제공합니다.

셋째, 텍스트 생성 품질이 인간을 속일 수 있는 수준에 도달했습니다. 인간 평가자에게 GPT-3가 생성한 뉴스 기사와 실제 기사를 구별하게 했을 때, 175B 모델에서 식별 정확도가 52%에 불과했습니다. 이는 무작위 추측(50%)과 사실상 동일한 수준으로, 거대 언어 모델의 생성 능력이 사회적 영향을 미칠 수 있는 임계점에 도달했음을 보여줍니다.

⚡️ 현실 세계의 임팩트

GPT-3는 2020년 6월 API 베타 공개 이후 300개 이상의 애플리케이션에 적용되었고, 이후 ChatGPT(2022년 11월)의 직접적 기반이 되었습니다. ChatGPT는 출시 2개월 만에 1억 사용자를 돌파하며 인터넷 역사상 가장 빠르게 성장한 서비스가 되었고, 이 모든 것의 기술적 출발점이 이 논문입니다.

GPT-3의 코드 생성 능력은 Codex로 발전하여 GitHub Copilot의 기반이 되었습니다. 현재 Copilot은 수백만 개발자가 사용하는 AI 코딩 어시스턴트로, 이 논문이 제시한 'few-shot으로도 코드를 생성할 수 있다'는 가능성이 현실화된 것입니다.

이 논문이 제시한 in-context learning 패러다임은 현재 AI 산업의 표준이 되었습니다. 'prompt engineering'이라는 직군이 탄생했고, GPT-4, Claude, Gemini 등 모든 주요 LLM이 이 논문이 정립한 few-shot 프레임워크 위에서 발전하고 있습니다.

학술적으로 이 논문은 NeurIPS 2020에 게재되었으며, 2026년 현재 약 30,000회 이상 인용된 AI 역사상 가장 영향력 있는 논문 중 하나입니다. 스케일링 법칙, 창발적 능력, RLHF 등 후속 연구의 거의 모든 방향이 이 논문에서 출발합니다.

☝️ 연구의 계보

GPT-3는 Transformer(Vaswani et al., 2017) → GPT-1(Radford et al., 2018) → GPT-2(Radford et al., 2019) → 스케일링 법칙(Kaplan et al., 2020)으로 이어지는 연구 계보 위에 있습니다. 특히 GPT-2가 '비지도 학습만으로도 다양한 NLP 작업이 가능하다'는 가능성을 보여준 것을 GPT-3가 규모의 힘으로 실증한 것입니다. 이 논문 이후 InstructGPT(Ouyang et al., 2022)의 RLHF 기반 정렬, ChatGPT와 GPT-4로의 발전, 그리고 Chinchilla(Hoffmann et al., 2022)의 컴퓨팅 최적 스케일링 연구 등이 직접적으로 이어졌습니다.

🫸 강점과 한계

[강점] 125M~175B까지 8가지 모델을 체계적으로 비교하여, 스케일링의 효과를 단일 연구 안에서 설득력 있게 실증한 점은 후속 연구의 로드맵이 되었습니다.

[강점] Fine-tuning 없는 in-context learning이라는 새로운 패러다임을 제시하고, 수십 개의 다양한 벤치마크에서 이를 검증한 점 — 이 프레임워크(Zero/One/Few-shot)는 현재 LLM 평가의 표준이 되었습니다.

[강점] 텍스트 생성의 사회적 영향(편향, 가짜 뉴스 등)을 논문 안에서 직접 다루며, AI 윤리 논의를 기술 논문에 통합한 선구적 시도입니다.

[한계] 2,048 토큰의 컨텍스트 윈도우는 Few-shot 예시 수를 제한하며, 긴 문서 이해나 복잡한 추론 체인에는 부족합니다. 이 한계는 이후 GPT-4(128K 토큰)에서야 크게 완화되었습니다.

[한계] In-context learning이 '왜' 작동하는지에 대한 메커니즘 분석이 부족합니다. 모델 내부에서 어떤 일이 일어나는지는 여전히 열린 연구 질문으로 남아 있습니다.

[한계] 1,750억 파라미터 모델의 학습에 수백만 달러의 컴퓨팅 비용이 필요하여, 학계나 소규모 조직이 결과를 재현하거나 검증하기 어렵다는 접근성 문제가 있습니다.

[시사점] 이 논문은 '아키텍처 혁신'보다 '규모의 확대'가 AI 능력 향상의 핵심 동력일 수 있음을 보여주며, 이후 AI 연구와 산업의 방향을 근본적으로 바꿔놓았습니다.

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료❗️

최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩