TL;DR

📋 핵심 발견

CIFAR-10에서 FID 3.17, Inception Score 9.46을 달성하여 당시 생성 모델의 새로운 최고 기록을 세웠습니다. 이는 GAN 기반 모델들과 대등하거나 능가하는 수준으로, diffusion model이 실용적 생성 모델이 될 수 있음을 처음으로 입증한 결과입니다.

복잡한 variational lower bound 대신 단순한 노이즈 예측 MSE 손실(L_simple)만으로도 최고 수준의 샘플 품질을 달성할 수 있음을 보여주었습니다. 이론적 아름다움과 실용성을 동시에 잡은 핵심 발견입니다.

Diffusion model이 progressive lossy decompression과 동일한 구조를 가진다는 이론적 연결고리를 제시했습니다. 대부분의 정보 비트가 사람이 인지하기 어려운 미세한 디테일에 할당된다는 발견은 모델이 '의미 있는 구조'를 먼저 학습함을 시사합니다.

256×256 해상도의 LSUN과 CelebA-HQ 데이터셋에서 ProgressiveGAN에 필적하는 고해상도 이미지 생성을 달성했습니다. 이는 diffusion model이 저해상도에만 국한되지 않음을 보여준 중요한 결과입니다.

Denoising Diffusion Probabilistic Models

arXiv: 2006.11239

💡이 논문이 등장한 배경

2020년 당시, 이미지 생성의 왕좌는 GAN(Generative Adversarial Network)이 차지하고 있었습니다. GAN은 두 신경망이 위조범과 감별사처럼 서로 경쟁하며 이미지를 만들어내는 방식인데, 놀라운 결과를 보여주면서도 치명적인 약점들이 있었습니다. 학습이 극도로 불안정하고(두 네트워크의 균형이 쉽게 무너짐), mode collapse라 불리는 문제 — 모델이 몇 가지 '안전한' 이미지만 반복 생성하며 다양성을 잃는 현상 — 가 빈번했습니다.

VAE(Variational Autoencoder)라는 대안도 있었지만, VAE가 만든 이미지는 늘 살짝 흐릿했습니다. 마치 안경 없이 본 세상처럼요. 이론적으로는 우아했지만 실제 결과물의 품질에서 GAN에 크게 뒤처졌습니다.

한편, Sohl-Dickstein 등이 2015년에 제안한 diffusion probabilistic model이라는 아이디어가 있었습니다. 열역학의 비평형 과정에서 영감을 받은 이 접근법은 이론적으로 흥미로웠지만, 실제로 고품질 이미지를 생성하는 데는 실패한 상태였습니다. 좋은 아이디어가 있었지만, 그것을 '작동하게' 만드는 레시피가 아직 없었던 것입니다.

🔍 핵심 아이디어

Diffusion model의 핵심 아이디어는 놀라울 정도로 직관적입니다. 깨끗한 사진 위에 모래를 한 줌씩 뿌려서 결국 사진을 완전히 가려버리는 과정을 상상해보세요. 이 '모래 뿌리기'(forward process)는 수학적으로 정확히 기술할 수 있습니다. 핵심 통찰은 이것입니다: 만약 신경망이 '모래를 한 줌 걷어내는' 법을 배울 수 있다면, 순수한 모래더미에서 출발해서 한 줌씩 걷어내며 완전히 새로운 사진을 만들어낼 수 있다는 것입니다.

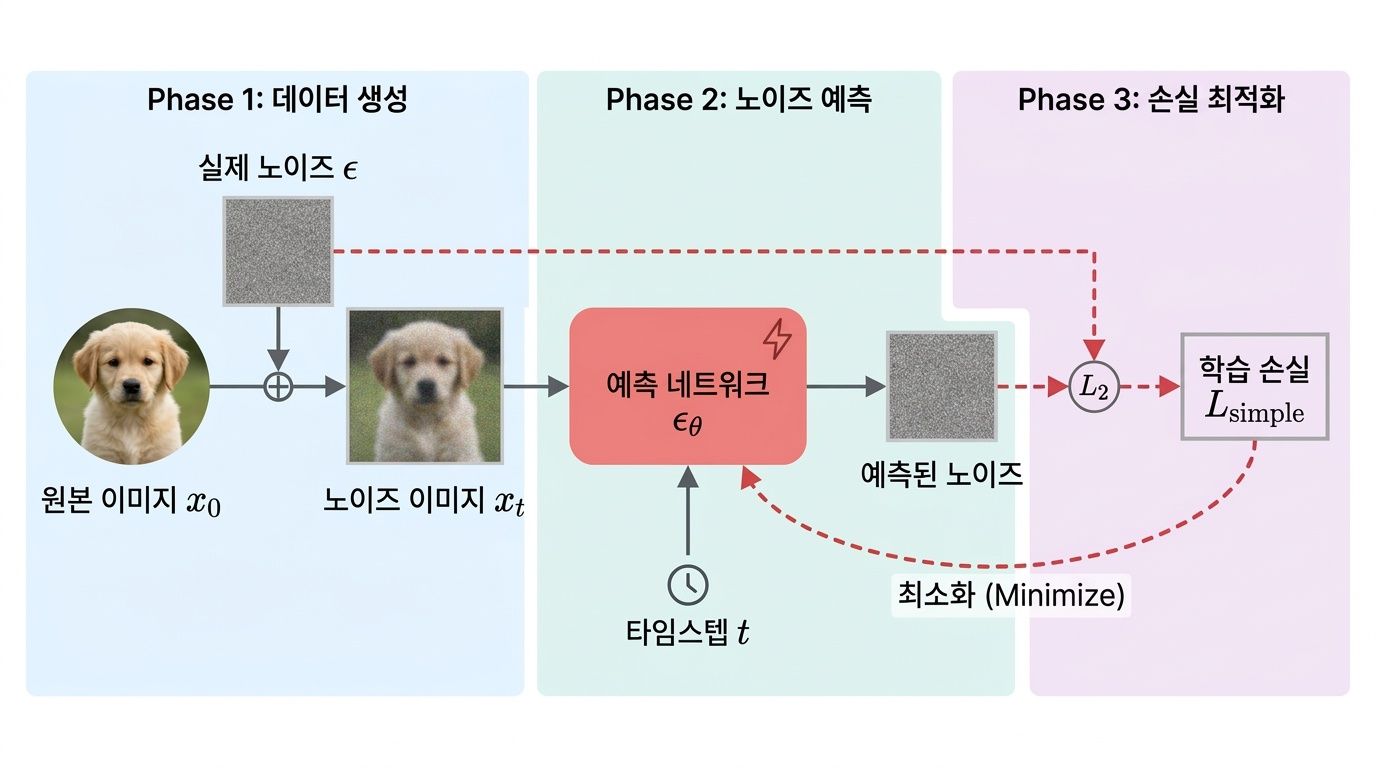

깨끗한 이미지(x0)에 점진적으로 노이즈가 추가되어 순수 노이즈(xT)가 되는 전방 확산(forward diffusion) 프로세스와, 순수 노이즈(xT)에서 노이즈 예측 네트워크(εθ)를 통해 깨끗한 이미지(x0)로 점진적으로 복원되는 역방향 샘플링(reverse sampling) 프로세스를 시각적으로 설명합니다. 각 시간 단계(timestep)에서 이미지의 변화와 εθ 네트워크의 역할을 보여줍니다.

수학적으로, forward process는 원본 이미지 x₀에 가우시안 노이즈를 T번의 시간 단계에 걸쳐 점진적으로 추가합니다. 각 단계에서 추가되는 노이즈의 양은 β₁, β₂, ..., β_T라는 스케줄에 의해 결정되며, 이 논문에서는 β₁=0.0001에서 β_T=0.02까지 선형적으로 증가하는 스케줄을 사용했습니다. T=1000 단계를 거치면 어떤 이미지든 거의 완벽한 가우시안 노이즈가 됩니다.

이 논문의 진짜 혁신은 reverse process — 즉 노이즈에서 이미지를 복원하는 과정 — 을 어떻게 학습시키느냐에 있습니다. 기존 연구들은 reverse process의 평균(μ)과 분산(σ²)을 모두 예측하려 했지만, Ho 등은 과감하게 단순화합니다. 분산은 고정값으로 두고, 네트워크에게는 오직 하나만 묻습니다: "이 노이즈 낀 이미지에 어떤 노이즈가 섞여 있니?"

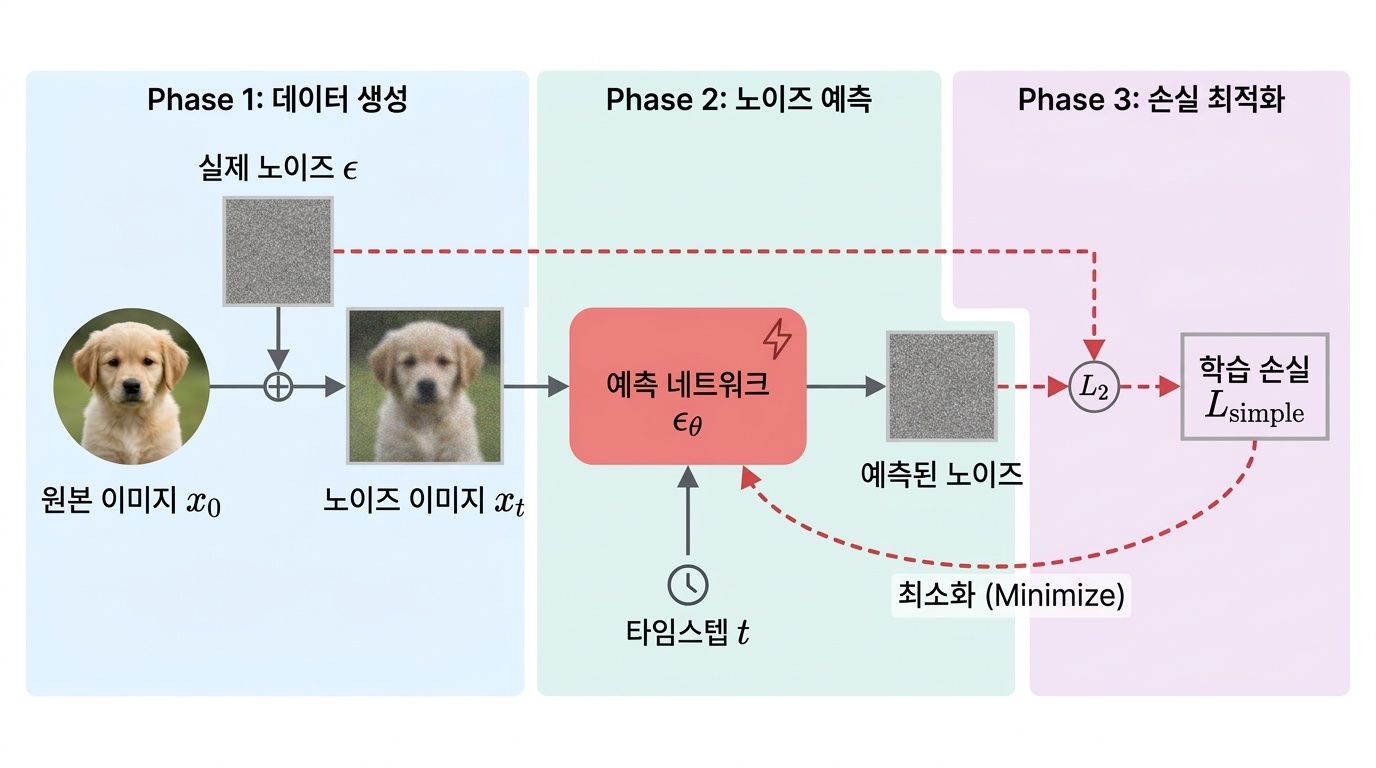

확산 모델의 핵심 학습 목표인 L_simple(θ) = E[||ε - εθ(x_t, t)||²]를 시각적으로 설명합니다. 원본 이미지(x0)에 무작위 노이즈(ε)가 추가되어 중간 상태(x_t)가 되는 과정과, εθ 네트워크가 x_t와 t로부터 노이즈를 예측하고, 이 예측된 노이즈와 실제 노이즈 간의 L2-norm 차이를 최소화하는 과정을 보여줍니다.

이것이 바로 유명한 L_simple 목표 함수입니다: L_simple(θ) = E[‖ε − ε_θ(x_t, t)‖²]. 원본에 실제로 추가한 노이즈 ε와, 네트워크가 예측한 노이즈 ε_θ의 차이를 줄이는 것입니다. 놀랍도록 단순하지만, 이 단순함이 오히려 기존의 복잡한 variational bound보다 더 나은 샘플 품질을 만들어냈습니다. 복잡한 수학이 아니라 '노이즈 맞추기 게임'이 핵심이었던 것입니다.

이 논문은 또한 diffusion model과 denoising score matching, 그리고 Langevin dynamics 사이의 깊은 이론적 연결을 발견했습니다. 노이즈를 예측하는 것은 사실상 데이터 분포의 score(gradient of log-probability)를 학습하는 것과 동일하며, 이는 역방향 과정이 물리학의 Langevin dynamics — 입자가 에너지가 낮은 곳으로 이동하는 과정 — 와 수학적으로 같은 구조임을 의미합니다.

🤔 어떻게 작동하는가

Step 1: Forward Process — 이미지를 노이즈로 녹이기

깨끗한 이미지 x₀에 매 시간 단계마다 약간의 가우시안 노이즈를 추가합니다. 이 과정은 마르코프 체인으로, 각 단계 q(x_t|x_{t-1})는 이전 단계에만 의존합니다. 핵심적인 수학적 트릭은 '임의의 시간 t에서의 x_t를 x₀에서 한 번에 계산'할 수 있다는 것입니다: x_t = √(ᾱ_t)·x₀ + √(1-ᾱ_t)·ε. 이 덕분에 학습 시 T번을 순차적으로 돌릴 필요 없이, 랜덤한 t를 뽑아 바로 그 시점의 노이즈 이미지를 만들 수 있습니다.

깨끗한 이미지(x0)에 점진적으로 노이즈가 추가되어 순수 노이즈(xT)가 되는 전방 확산(forward diffusion) 프로세스와, 순수 노이즈(xT)에서 노이즈 예측 네트워크(εθ)를 통해 깨끗한 이미지(x0)로 점진적으로 복원되는 역방향 샘플링(reverse sampling) 프로세스를 시각적으로 설명합니다. 각 시간 단계(timestep)에서 이미지의 변화와 εθ 네트워크의 역할을 보여줍니다.

Step 2: 노이즈 예측 네트워크 ε_θ — U-Net이 탐정 역할을 하다

네트워크의 임무는 간단합니다: 노이즈가 섞인 이미지 x_t와 현재 시간 단계 t를 받아서, '어떤 노이즈가 추가되었는지'를 추측하는 것입니다. 마치 탐정이 범죄 현장(노이즈 이미지)과 시간 정보를 받아 범인(노이즈)을 찾아내는 것과 같습니다. 이 탐정 역할에는 U-Net 아키텍처가 사용됩니다. U-Net은 이미지를 점점 작게 압축했다가(다운샘플링) 다시 키우는(업샘플링) 모래시계 형태이며, skip connection으로 세부 정보를 보존합니다. 시간 정보 t는 Transformer의 sinusoidal position embedding과 동일한 방식으로 인코딩되어 네트워크에 주입됩니다.

확산 모델의 핵심 구성 요소인 U-Net 기반의 εθ 네트워크 아키텍처를 시각적으로 제시합니다. Transformer sinusoidal position embedding이 시간 t를 네트워크에 어떻게 통합하는지, 그리고 네트워크가 노이즈 ε를 예측하는 과정을 설명합니다. 입력(노이즈가 추가된 이미지 x_t, timestep t)과 출력(예측된 노이즈 ε)을 명확히 표시합니다.

Step 3: 학습 — 노이즈 맞추기 게임

학습 과정은 놀라울 정도로 단순합니다. (1) 학습 데이터에서 이미지 x₀를 하나 뽑고, (2) 랜덤한 시간 t를 뽑고, (3) 랜덤 노이즈 ε를 생성하여 x_t를 만들고, (4) 네트워크에 x_t와 t를 넣어 노이즈를 예측하게 하고, (5) 예측한 노이즈와 실제 노이즈의 MSE를 최소화합니다. 복잡한 variational bound의 여러 항을 전부 무시하고, 이 단순한 L_simple만으로 학습해도 최고 품질의 이미지가 생성된다는 것이 이 논문의 핵심 발견입니다.

확산 모델의 핵심 학습 목표인 L_simple(θ) = E[||ε - εθ(x_t, t)||²]를 시각적으로 설명합니다. 원본 이미지(x0)에 무작위 노이즈(ε)가 추가되어 중간 상태(x_t)가 되는 과정과, εθ 네트워크가 x_t와 t로부터 노이즈를 예측하고, 이 예측된 노이즈와 실제 노이즈 간의 L2-norm 차이를 최소화하는 과정을 보여줍니다.

Step 4: Reverse Process — 노이즈에서 이미지 만들기

생성 시에는 순수한 가우시안 노이즈 x_T에서 출발합니다. 각 시간 단계에서 네트워크가 예측한 노이즈를 빼서 한 단계 덜 노이즈한 이미지를 얻고, 여기에 약간의 랜덤 노이즈를 다시 더합니다(마지막 단계 제외). 이 '약간의 랜덤성'이 중요한데, 같은 시작점에서도 다양한 이미지를 생성할 수 있게 해줍니다. T=1000 단계를 거치면 깨끗한 이미지가 완성됩니다. 초기 단계에서는 큰 구조(얼굴의 윤곽, 전체 구도)가, 후기 단계에서는 세밀한 디테일(피부 질감, 머리카락)이 형성됩니다.

확산 모델이 순수 노이즈(xT)에서 출발하여 역방향 프로세스를 통해 이미지를 생성하는 과정을 단계별로 보여줍니다. 초기 단계에서는 이미지의 큰 윤곽(coarse features)이 형성되고, 후기 단계에서는 미세한 디테일(fine details)이 추가되어 최종적으로 고품질 이미지가 완성되는 모습을 시각적으로 강조하며, 점진적 압축(progressive compression)과의 연관성을 설명합니다.

Step 5: Progressive Lossy Compression — 정보 이론적 해석

이 논문의 또 다른 중요한 기여는 diffusion model을 정보 이론의 렌즈로 해석한 것입니다. Reverse process의 각 단계는 일종의 '점진적 압축 해제'로 볼 수 있습니다. Rate-distortion 분석을 해보면 흥미로운 결과가 나옵니다: 모델이 사용하는 대부분의 '비트'(정보)는 사람이 인지하기 어려운 미세한 디테일에 할당됩니다. 반대로 사람에게 중요한 큰 구조(얼굴 형태, 물체 배치 등)는 아주 적은 비트로 인코딩됩니다. 이는 모델이 자연스럽게 coarse-to-fine 순서로 이미지를 구성함을 의미합니다.

Figure 5의 Rate-Distortion 곡선을 기반으로, 확산 모델의 점진적 압축 특성을 설명합니다. 역방향 프로세스 단계(T-t)가 진행됨에 따라 'Rate'(전송된 비트/차원)와 'Distortion'(RMSE)이 어떻게 변화하는지 보여주며, 대부분의 비트가 지각하기 어려운 디테일(imperceptible distortions)에 할당된다는 모델의 중요한 기여를 시각적으로 해석합니다.

🛠️ 실험이 말해주는 것

CIFAR-10 벤치마크에서 DDPM은 FID 3.17과 Inception Score 9.46을 달성했습니다. 이는 당시 unconditional 생성 모델 중 최고 수준이었으며, 특히 FID에서 기존의 GAN 기반 모델들과 대등하거나 능가하는 결과였습니다. 256×256 해상도의 LSUN 침실, 교회 등의 데이터셋에서도 ProgressiveGAN에 필적하는 고품질 이미지를 생성했습니다. 이는 diffusion model이 단순히 이론적 호기심의 대상이 아니라, GAN의 실질적 대안이 될 수 있음을 처음으로 증명한 순간이었습니다.

학습 목표에 대한 ablation 결과는 특히 흥미롭습니다. 이론적으로 '올바른' variational bound를 직접 최적화하면 log-likelihood는 좋아지지만, 실제 이미지 품질(FID)은 오히려 나빠졌습니다. 반면 이론적으로 '틀린' 단순화된 목표(L_simple)가 최고의 샘플 품질을 만들어냈습니다. 이는 log-likelihood와 인간이 인지하는 이미지 품질이 반드시 일치하지 않는다는 중요한 교훈을 줍니다. 분산 β_t를 학습하지 않고 고정값으로 두어도 결과에 큰 차이가 없었다는 것도 주목할 만합니다.

Rate-distortion 분석에서, reverse process 초기 단계(큰 구조 생성)는 극소량의 비트만 사용하고, 후반 단계(미세 디테일)에서 대부분의 비트가 소비된다는 것을 보였습니다. 이는 diffusion model이 autoregressive model과 유사한 점진적 디코딩 특성을 가지면서도, 더 유연한 구조를 제공함을 시사합니다.

⚡️ 현실 세계의 임팩트

DDPM은 Stable Diffusion, DALL·E 2/3, Midjourney, Imagen 등 현재 AI 이미지 생성의 거의 모든 상용 서비스의 이론적 기반이 되었습니다. 텍스트를 입력하면 이미지를 만들어주는 서비스들의 핵심 엔진이 바로 이 논문에서 시작되었습니다.

OpenAI의 Sora(비디오 생성), Google의 Veo, Runway의 Gen-3 등 비디오 생성 모델도 diffusion model 위에 구축되어 있습니다. DDPM의 '점진적 denoising' 패러다임이 이미지를 넘어 동영상, 3D, 오디오 등 다양한 도메인으로 확장된 것입니다.

Google Scholar 기준 약 15,000회 이상의 인용을 기록하며, 2020년대 AI 분야에서 가장 영향력 있는 논문 중 하나로 자리잡았습니다. 이 논문 이후 Improved DDPM, DDIM, Latent Diffusion, Classifier-Free Guidance 등 수백 편의 후속 연구가 쏟아져 나왔습니다.

의료 영상 합성(희귀 질환 데이터 증강), 신약 개발(분자 구조 생성), 단백질 설계(RFDiffusion) 등 과학 연구 분야에서도 DDPM 기반 생성 모델이 핵심 도구로 활용되고 있습니다.

☝️ 연구의 계보

이 논문은 Sohl-Dickstein 등(2015)이 처음 제안한 diffusion probabilistic model의 아이디어와, Song & Ermon(2019)의 score-based generative model(NCSN) 연구 위에 서 있습니다. 비평형 열역학에서 영감을 받은 이론적 프레임워크를 실제로 '작동하는' 고품질 생성 모델로 만든 결정적 전환점입니다. 이 논문 이후 Nichol & Dhariwal의 Improved DDPM(2021), Song 등의 DDIM(2020, 빠른 샘플링), Rombach 등의 Latent Diffusion(2022, Stable Diffusion의 기반), Ho & Salimans의 Classifier-Free Guidance(2022) 등이 연이어 발표되며 diffusion model의 생태계가 폭발적으로 성장했습니다.

🫸 강점과 한계

[강점] 학습 안정성: GAN의 고질적 문제인 mode collapse, 학습 불안정성이 없습니다. 단순한 MSE 손실 하나로 안정적으로 학습되며, 하이퍼파라미터 튜닝이 GAN 대비 훨씬 관대합니다.

[강점] 이론과 실전의 결합: variational inference, score matching, Langevin dynamics 사이의 깊은 이론적 연결을 보여주면서도, 동시에 실제 이미지 품질에서 GAN과 경쟁할 수 있음을 증명했습니다.

[강점] 단순화의 힘: 복잡한 목표 함수 대신 L_simple이라는 극도로 단순한 손실로 최고 성능을 달성한 것은, 후속 연구들이 쉽게 따라올 수 있는 길을 열어주었습니다.

[한계] 샘플링 속도: T=1000 단계의 순차적 denoising이 필요하여, GAN의 단일 forward pass 대비 생성 속도가 수백 배 느립니다. 이 문제는 이후 DDIM, consistency models 등에 의해 부분적으로 해결되었습니다.

[한계] log-likelihood 측면에서는 당시 autoregressive 모델들에 뒤처졌습니다. 저자들 스스로도 L_simple이 샘플 품질과 log-likelihood 사이의 트레이드오프임을 인정했습니다.

[시사점] '이론적으로 올바른 것'과 '실용적으로 좋은 것'이 반드시 일치하지 않는다는 교훈을 줍니다. L_simple의 성공은 때로는 엄밀한 수학적 최적화보다 적절한 단순화가 더 나은 결과를 낳을 수 있음을 보여줍니다.

CIFAR-10 FID 3.17 — Table 1, unconditional generation results

Inception Score 9.46 — Table 1, CIFAR-10 benchmark

L_simple vs variational bound 비교 — Table 2 및 Section 4, ablation on training objectives

노이즈 스케줄 β₁=0.0001 ~ β_T=0.02 — Section 4, linear schedule over T=1000 steps

Progressive lossy compression 해석 — Section 4.1, rate-distortion analysis 및 Figure 5

LSUN 256×256 샘플 품질 — Section 4, ProgressiveGAN과의 비교

Score matching 연결 — Section 3.2, connection to denoising score matching

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료❗️

최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩