TL;DR

📋 핵심 발견

WMT 2014 영어→독일어 번역에서 28.4 BLEU를 달성하여 기존 최고 기록(앙상블 포함)을 2 BLEU 이상 돌파했습니다. 단일 모델이 여러 모델의 합작품을 넘어선 것으로, 아키텍처 자체의 우수성을 증명합니다.

영어→프랑스어 번역에서 41.8 BLEU로 새로운 단일 모델 SOTA를 세웠는데, 이를 GPU 8장으로 단 3.5일 만에 달성했습니다. 기존 최고 모델들의 훈련 비용 대비 극히 일부에 불과한 수준입니다.

RNN과 CNN을 완전히 제거하고 attention mechanism만으로 sequence transduction 모델을 구축할 수 있음을 최초로 입증했습니다. 이는 병렬 처리를 가능하게 하여 훈련 속도를 비약적으로 높였습니다.

영어 구문 분석(constituency parsing)에서도 높은 성능을 보여, Transformer가 기계 번역을 넘어 다양한 시퀀스 태스크에 일반화됨을 확인했습니다.

Attention Is All You Need

arXiv: 1706.03762

💡이 논문이 등장한 배경

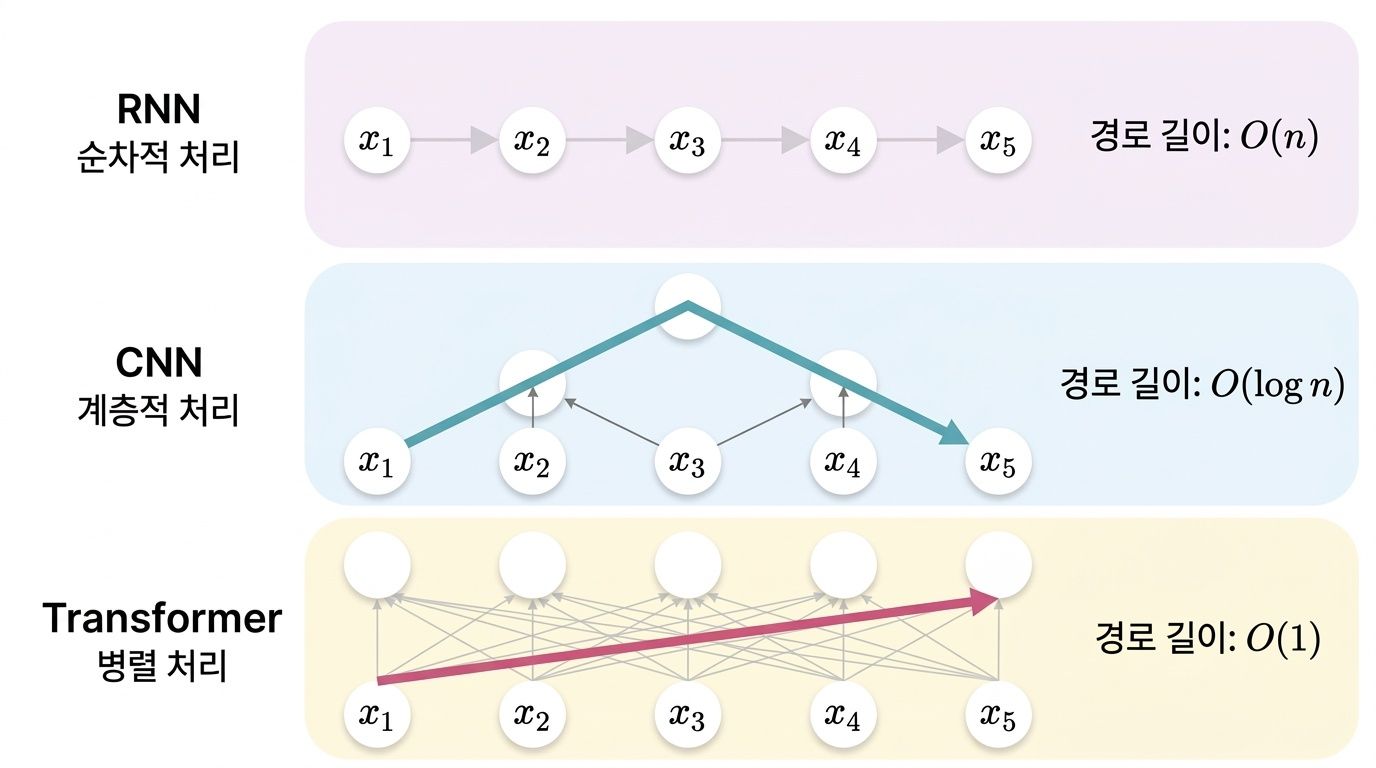

2017년, 자연어 처리의 지배적인 모델은 RNN(순환 신경망)과 그 변형인 LSTM, GRU였습니다. 이 모델들은 문장을 처리할 때 단어를 하나씩 순서대로 읽어야 했습니다. 마치 두꺼운 소설을 한 글자씩 손가락으로 짚어가며 읽는 것과 같습니다. 앞에서 읽은 내용을 기억하면서 뒤로 넘어가야 하니, 문장이 길어질수록 앞부분의 정보가 흐려지는 문제가 있었습니다.

이 '순차 처리'라는 본질적 특성은 두 가지 병목을 만들었습니다. 첫째, 현대 GPU의 강점인 병렬 연산을 제대로 활용할 수 없었습니다. t번째 단어를 처리하려면 반드시 t-1번째까지의 결과가 필요하기 때문입니다. 둘째, 문장 내 멀리 떨어진 단어들 사이의 관계(장거리 의존성)를 학습하기 어려웠습니다. '그 소녀가 ... (긴 수식어) ... 달렸다'에서 '소녀'와 '달렸다'의 관계를 파악하려면 정보가 여러 시간 단계를 거쳐 전달되어야 했고, 그 과정에서 신호가 약해졌습니다.

Attention mechanism은 이미 존재했지만, 항상 RNN 위에 보조 장치로 얹혀 있었습니다. 당시의 통념은 '시퀀스를 다루려면 순환 구조가 필수'라는 것이었고, attention은 그 위에 성능을 올려주는 부스터 정도로 여겨졌습니다. Vaswani 등 8명의 Google 연구자들은 과감한 질문을 던졌습니다 — attention만으로 충분하지 않을까?

🔍 핵심 아이디어

Transformer의 핵심 아이디어는 놀라울 정도로 단순합니다. 문장을 순서대로 한 단어씩 처리하는 대신, 모든 단어가 다른 모든 단어를 동시에 바라보게 하자는 것입니다. 교실에 비유하면, RNN은 학생들이 한 줄로 앉아 앞사람에게만 메모를 전달할 수 있는 구조이고, Transformer는 모든 학생이 원탁에 앉아 누구든 직접 눈을 맞추고 대화할 수 있는 구조입니다.

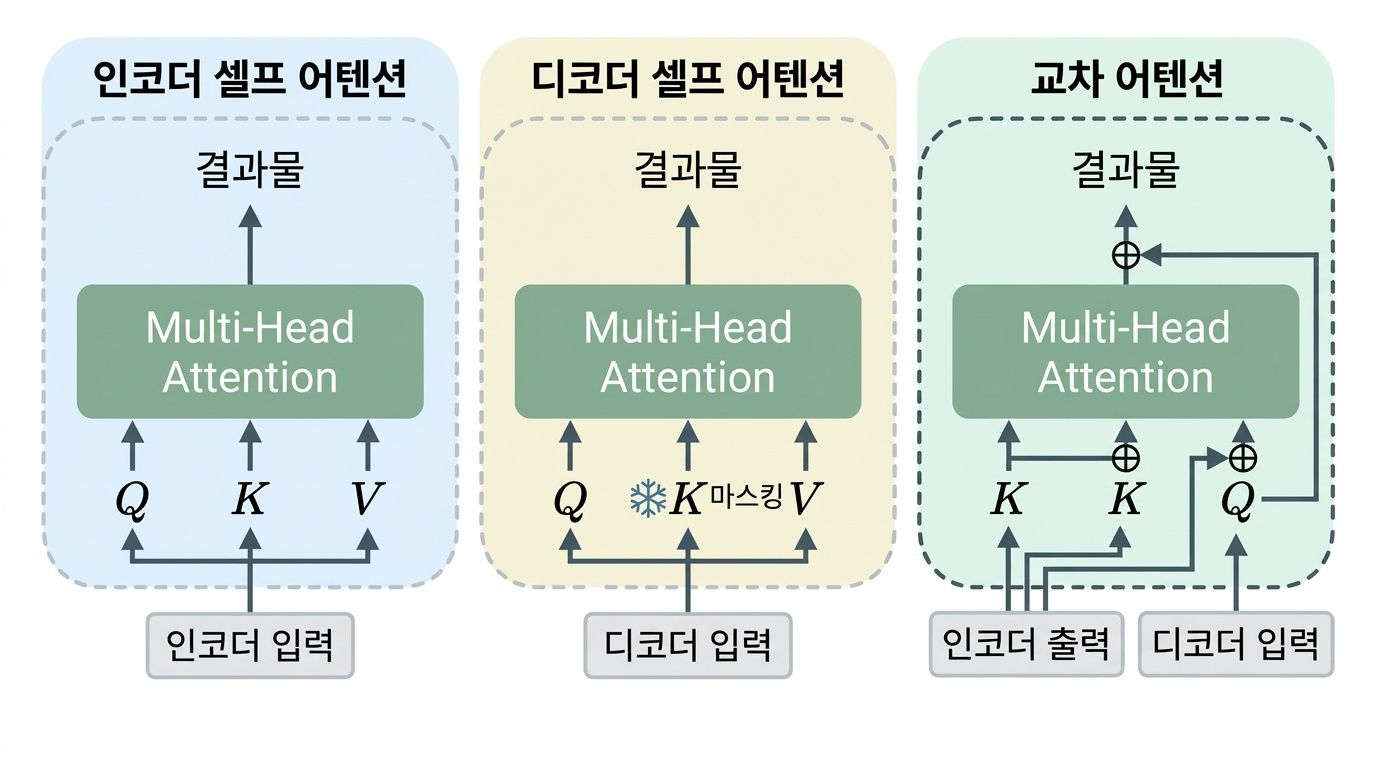

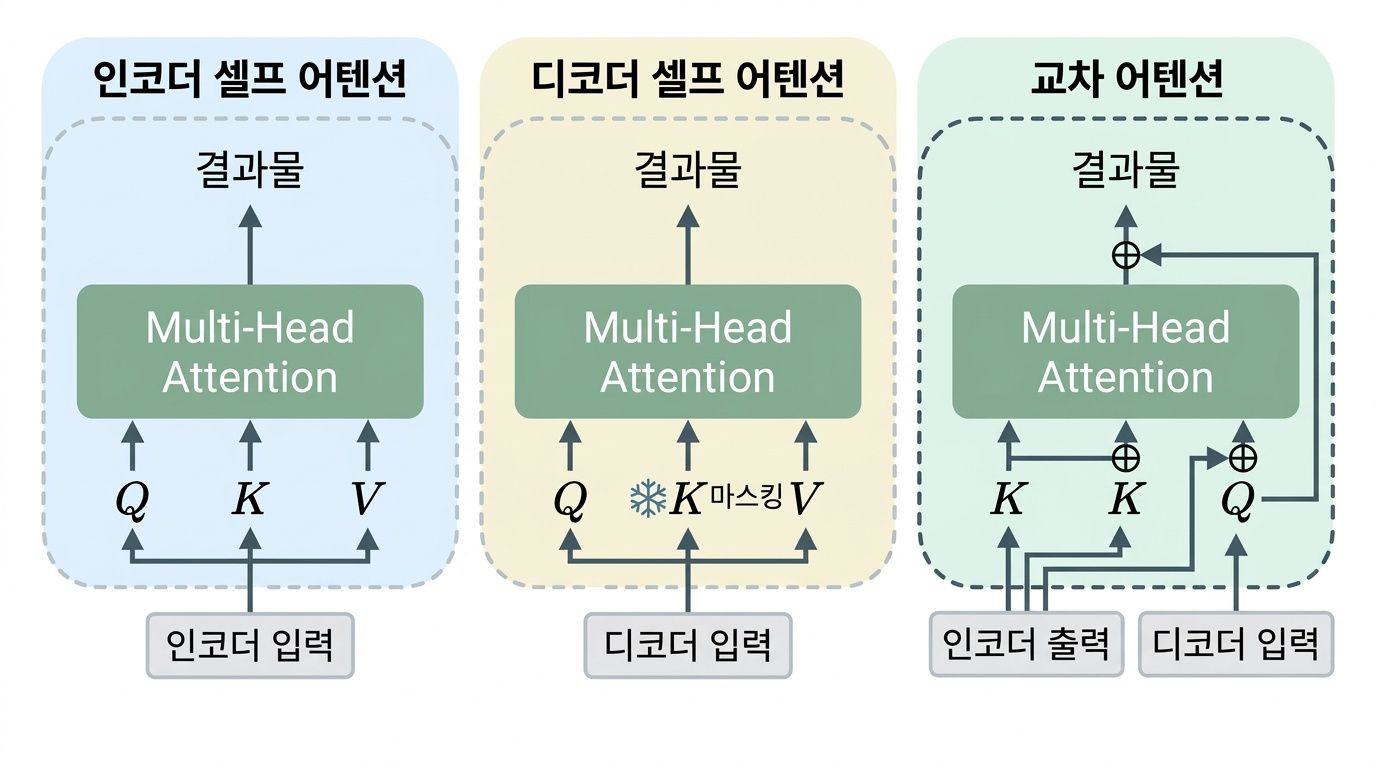

이 '모든 단어가 모든 단어를 바라보는' 메커니즘이 바로 Self-Attention입니다. 각 단어는 세 가지 역할을 동시에 수행합니다 — Query(질문하는 역할: '나와 관련 있는 단어가 뭐지?'), Key(응답하는 역할: '나는 이런 정보를 갖고 있어'), Value(실제 전달하는 정보). 모든 단어 쌍 사이의 관련도를 계산한 뒤, 관련도가 높은 단어의 정보를 더 많이 가져옵니다. 수식으로 표현하면 Attention(Q, K, V) = softmax(QK^T / √d_k)V 인데, 이는 결국 'Query과 Key의 유사도를 구하고, 그 유사도에 비례하여 값을 가중합산한다'는 의미입니다. √d_k로 나누는 것은 차원이 커질수록 내적 값이 커져서 softmax가 극단적으로 치우치는 것을 방지하는 스케일링입니다.

트랜스포머 모델 내에서 사용되는 세 가지 Multi-Head Attention 유형(Encoder Self-Attention, Decoder Self-Attention, Encoder-Decoder Attention) 각각에 대해 Query(Q), Key(K), Value(V) 입력이 어디에서 오는지 명확히 보여주는 개념적인 다이어그램을 만듭니다. Decoder Self-Attention의 마스킹(masking) 처리도 포함합니다.

Transformer는 이 attention을 하나만 쓰지 않고, 여러 개의 '관점'으로 동시에 바라봅니다 — 이것이 Multi-Head Attention입니다. 한 head는 문법적 관계에 주목하고, 다른 head는 의미적 관계에 주목하는 식입니다. 마치 같은 장면을 여러 카메라 앵글로 동시에 촬영하는 것과 같습니다. 논문에서는 8개의 head를 사용하여 512차원의 모델을 64차원씩 나눠 처리했습니다.

모델의 전체 구조는 Encoder-Decoder 형태입니다. Encoder는 입력 문장(예: 영어)을 이해하는 부분이고, Decoder는 출력 문장(예: 독일어)을 생성하는 부분입니다. Encoder는 6개의 동일한 레이어를 쌓아 올렸고, 각 레이어는 Multi-Head Self-Attention과 Feed-Forward Network라는 두 개의 서브레이어로 구성됩니다.

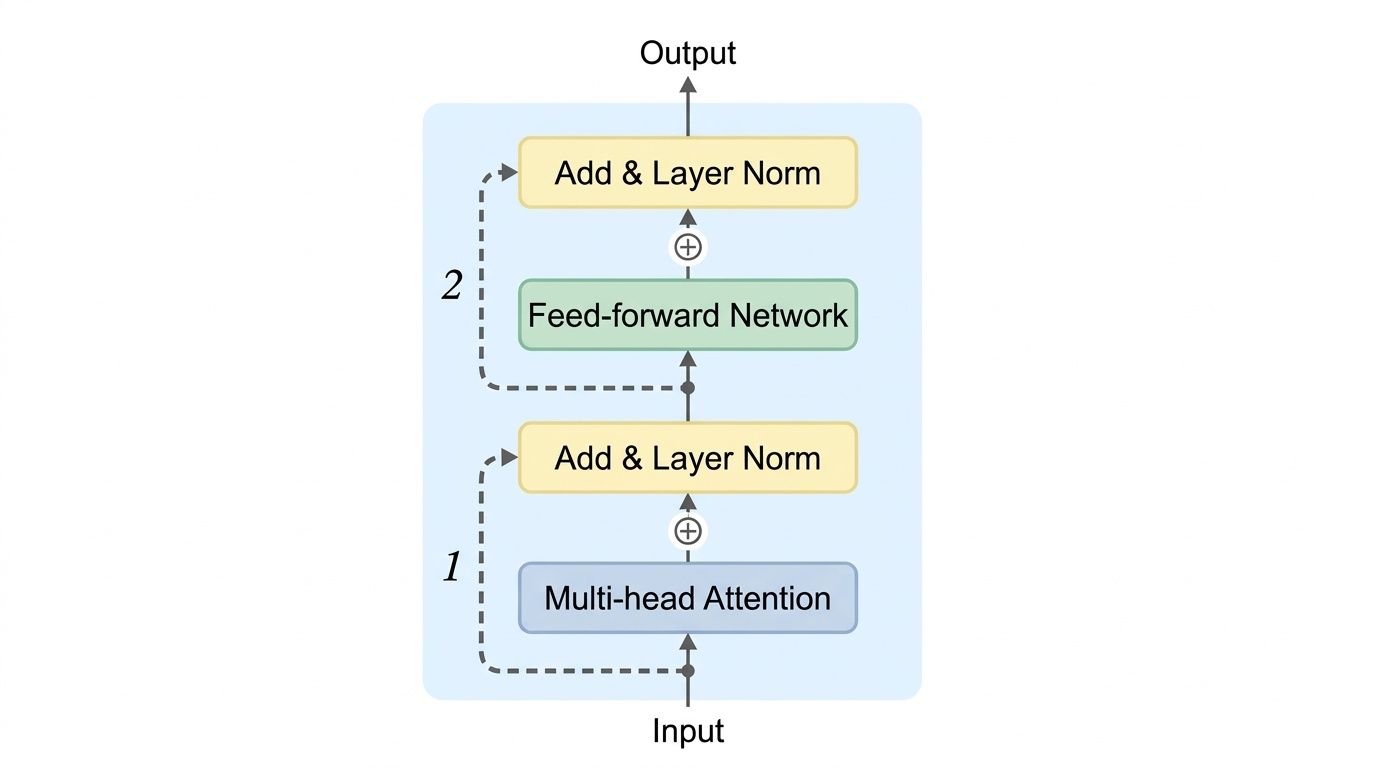

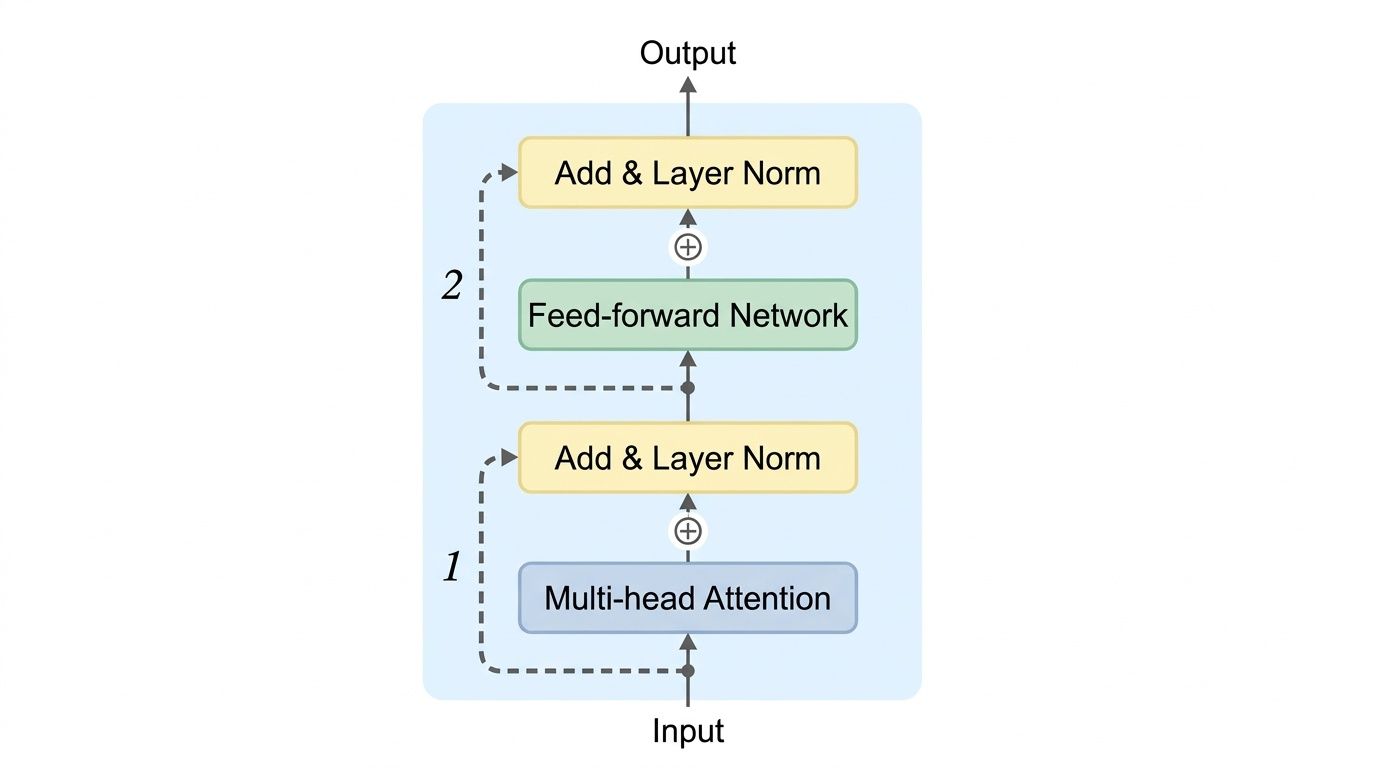

트랜스포머의 단일 인코더 레이어(또는 디코더 레이어)의 상세한 내부 구조를 시각화합니다. Multi-Head Attention 서브 레이어와 Position-wise Feed-Forward Network 서브 레이어를 보여주고, 각 서브 레이어를 감싸는 Residual Connection과 Layer Normalization이 어떻게 적용되는지 흐름을 나타냅니다.

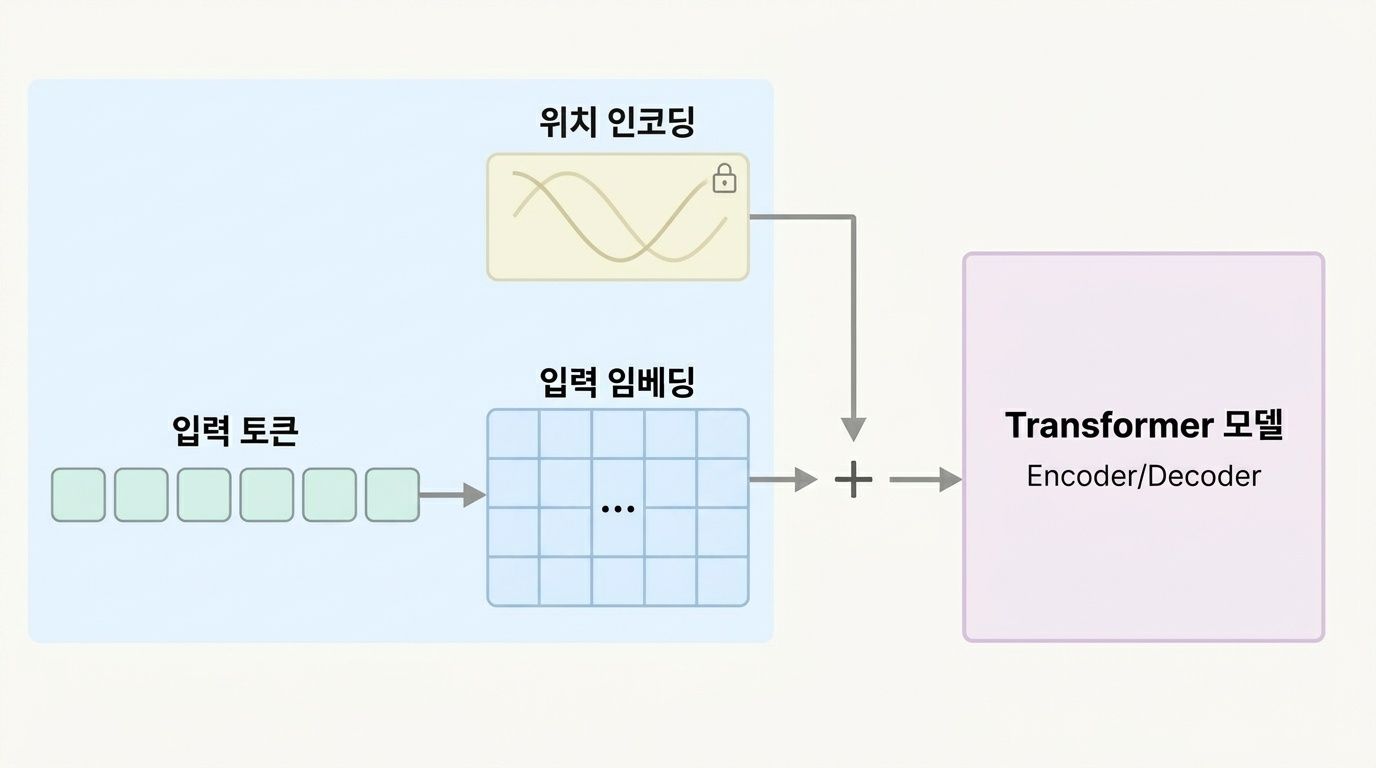

그런데 RNN을 제거하면 한 가지 중요한 정보가 사라집니다 — 바로 단어의 순서입니다. Self-Attention은 본질적으로 집합(set) 연산이라 '나는 밥을 먹는다'와 '밥은 나를 먹는다'를 구분하지 못합니다. 이 문제를 해결하기 위해 Positional Encoding을 도입했습니다. 각 위치에 고유한 패턴의 사인/코사인 함수 값을 생성하여 입력 임베딩에 더해줍니다. 이를 통해 모델은 단어의 절대적 위치뿐 아니라 상대적 거리도 학습할 수 있습니다.

🤔 어떻게 작동하는가

Step 1: 입력 임베딩 + 위치 인코딩 — 단어에 '좌석 번호'를 붙이기

입력 문장의 각 토큰은 먼저 학습 가능한 임베딩을 통해 512차원 벡터로 변환됩니다. 그런데 Transformer는 단어를 동시에 처리하므로 순서 정보가 없습니다. 이를 보완하기 위해 각 위치마다 고유한 사인/코사인 패턴의 Positional Encoding을 생성하여 임베딩 벡터에 더합니다. 마치 원탁 회의에서 이름표만으로는 발언 순서를 모르니, 각 좌석에 번호를 붙이는 것과 같습니다. 임베딩 가중치에는 √d_model을 곱해 위치 인코딩과 스케일을 맞춥니다.

입력 토큰이 임베딩 벡터로 변환된 후, Positional Encoding이 어떻게 생성되어 이 임베딩 벡터에 추가(summed)되는지 보여주는 다이어그램을 생성합니다. 이는 인코더/디코더 스택으로 들어가기 전의 초기 입력 처리 단계를 명확히 보여줍니다.

Step 2: Scaled Dot-Product Attention — 모든 단어가 서로를 '질문'하기

각 단어가 Q(Query), K(Key), V(Value) 세 벡터를 갖게 됩니다. Q와 K의 내적으로 두 단어 사이의 관련도를 계산하고, √d_k로 스케일링한 뒤 softmax를 적용하여 확률 분포로 만듭니다. 이 확률에 따라 V를 가중합산하면, 각 단어가 문맥에 맞게 '다른 단어들의 정보를 흡수한' 새로운 표현이 됩니다. 핵심은 이 연산이 행렬 곱셈으로 한 번에 수행되어 GPU에서 매우 효율적이라는 점입니다.

Step 3: Multi-Head Attention — 여러 관점으로 동시에 바라보기

하나의 attention으로는 단어 간 관계의 한 측면만 포착할 수 있습니다. Multi-Head Attention은 Q, K, V를 서로 다른 학습된 선형 변환으로 h번(논문에서는 8번) 투영한 뒤, 각각 독립적으로 attention을 수행합니다. 결과를 이어 붙인 후 다시 선형 변환을 거칩니다. 한 head가 주어-동사 관계를 학습하는 동안, 다른 head는 형용사-명사 관계를 학습할 수 있습니다. 512차원을 8개 head로 나누면 각 head는 64차원으로 작동하여, 단일 attention 대비 계산량이 거의 같습니다.

트랜스포머 모델 내에서 사용되는 세 가지 Multi-Head Attention 유형(Encoder Self-Attention, Decoder Self-Attention, Encoder-Decoder Attention) 각각에 대해 Query(Q), Key(K), Value(V) 입력이 어디에서 오는지 명확히 보여주는 개념적인 다이어그램을 만듭니다. Decoder Self-Attention의 마스킹(masking) 처리도 포함합니다.

Step 4: Encoder 레이어 — 이해의 층을 쌓아 올리기

하나의 Encoder 레이어는 두 개의 서브레이어로 구성됩니다: Multi-Head Self-Attention과 Position-wise Feed-Forward Network(FFN). FFN은 각 위치에 독립적으로 적용되는 두 층의 완전연결층(차원: 512→2048→512)으로, ReLU 활성화를 사용합니다. 각 서브레이어는 Residual Connection으로 감싸여 있어 입력이 직접 출력에 더해지고, Layer Normalization이 적용됩니다. 이 레이어를 6개 쌓으면, 낮은 층은 문법적 패턴을, 높은 층은 의미적 관계를 점진적으로 학습합니다.

트랜스포머의 단일 인코더 레이어(또는 디코더 레이어)의 상세한 내부 구조를 시각화합니다. Multi-Head Attention 서브 레이어와 Position-wise Feed-Forward Network 서브 레이어를 보여주고, 각 서브 레이어를 감싸는 Residual Connection과 Layer Normalization이 어떻게 적용되는지 흐름을 나타냅니다.

Step 5: Decoder의 세 가지 Attention — 과거만 보기, 원문 참조하기

Decoder 레이어는 Encoder보다 하나의 서브레이어가 더 있습니다. 첫째, Masked Self-Attention — 번역문을 생성할 때 아직 생성하지 않은 미래 단어를 보면 안 되므로, 미래 위치에 -∞ 마스크를 씌워 softmax 후 0이 되게 합니다. 둘째, Encoder-Decoder Attention — Decoder의 Q가 Encoder의 K, V를 참조하여 원문 정보를 가져옵니다. 셋째, Feed-Forward Network. 이 구조 덕분에 Decoder는 '지금까지 생성한 번역문'과 '원문 전체'를 동시에 고려하여 다음 단어를 예측합니다.

Step 6: 출력 생성 — 확률에서 단어로

Decoder의 최종 출력은 선형 변환과 softmax를 거쳐 다음 토큰의 확률 분포가 됩니다. 학습 시에는 정답 번역문을 한 칸씩 밀어서 입력하고(teacher forcing), 추론 시에는 이전에 생성한 토큰을 다시 입력하여 auto-regressive하게 문장을 완성합니다. 흥미로운 점은 출력 임베딩과 최종 선형 변환이 가중치를 공유한다는 것입니다 — 이는 파라미터를 절약하면서도 임베딩 공간의 일관성을 높입니다.

Step 7: 훈련 전략 — Warmup과 정규화

논문은 독특한 학습률 스케줄을 사용합니다 — 처음 warmup_steps(4000) 동안 학습률을 선형으로 올리다가, 이후 스텝 수의 역제곱근에 비례하여 감소시킵니다. 정규화로는 각 서브레이어 출력에 dropout(0.1)을, 그리고 label smoothing(ε=0.1)을 적용했습니다. Label smoothing은 모델이 정답에 100% 확신하지 못하게 하여 일반화 성능을 높이는데, perplexity는 올라가지만 BLEU와 accuracy는 오히려 개선됩니다.

🛠️ 실험이 말해주는 것

논문의 실험은 WMT 2014 번역 태스크를 중심으로 진행됩니다. 영어→독일어에서 Transformer(big) 모델은 28.4 BLEU를 달성하여, 이전 최고 기록이었던 앙상블 모델들을 2 BLEU 이상 앞섰습니다. 영어→프랑스어에서는 41.0 BLEU(base)와 41.8 BLEU(big)를 기록했는데, 특히 big 모델의 훈련 비용은 기존 최고 모델의 1/4 수준이었습니다. 이는 Transformer가 단순히 성능만 좋은 것이 아니라, 훈련 효율성에서도 압도적임을 보여줍니다.

Ablation study가 특히 흥미롭습니다. Attention head 수를 줄이면 성능이 하락하고, 너무 많아도(16개) 오히려 성능이 떨어졌습니다 — 각 head의 차원이 너무 작아지기 때문입니다. Attention의 key 차원(d_k)을 줄이면 성능이 하락하는데, 이는 '호환성 함수가 충분히 정교해야 한다'는 것을 시사합니다. 학습된 positional embedding을 사인/코사인 고정 인코딩으로 대체해도 성능이 거의 동일했다는 결과도 주목할 만합니다 — 이는 위치 정보의 표현 방식보다 위치 정보의 존재 자체가 중요함을 의미합니다.

번역 외에도 영어 구문 분석(constituency parsing)에 적용하여 BerkeleyParser를 제외한 모든 기존 모델을 능가했습니다. 특히 제한된 훈련 데이터(WSJ 약 40K 문장)에서도 우수한 성능을 보여, Transformer의 범용성을 입증했습니다.

⚡️ 현실 세계의 임팩트

ChatGPT, Claude, Gemini, LLaMA 등 2026년 현재 존재하는 거의 모든 대형 언어 모델(LLM)의 기반 아키텍처가 이 논문에서 제안한 Transformer입니다. GPT 시리즈는 Decoder만, BERT는 Encoder만, T5는 Encoder-Decoder 전체를 사용하는 등 변형이 있지만, 핵심 메커니즘은 동일합니다.

Google 검색, Google 번역, Microsoft Bing, GitHub Copilot, Notion AI 등 수십억 명이 매일 사용하는 서비스의 핵심 기술입니다. 2019년 Google은 검색 엔진에 BERT를 도입하며 '지난 5년간 가장 큰 도약'이라고 발표했는데, 그 BERT의 뿌리가 바로 이 논문입니다.

자연어 처리를 넘어 Vision Transformer(ViT), AlphaFold 2(단백질 구조 예측), DALL-E/Stable Diffusion(이미지 생성), Whisper(음성 인식) 등 거의 모든 AI 분야로 확산되었습니다. Transformer는 '범용 시퀀스 처리 엔진'으로서 텍스트, 이미지, 음성, 단백질 서열, 코드까지 처리합니다.

AI 역사상 가장 많이 인용된 논문 중 하나로, 2026년 현재 약 170,000회 이상 인용되었습니다. NeurIPS 2017에서 발표된 이후 'Test of Time' 수준을 넘어 하나의 시대를 정의한 논문으로 평가받고 있습니다.

☝️ 연구의 계보

Transformer는 Bahdanau et al.(2014)의 additive attention과 Luong et al.(2015)의 multiplicative attention 연구 위에 서 있습니다. 특히 attention을 RNN의 보조가 아닌 주역으로 승격시킨 것이 핵심적 기여입니다. 이 논문 이후 GPT(2018), BERT(2018), GPT-2(2019), T5(2019), GPT-3(2020), Vision Transformer(2020) 등이 잇따라 등장하며 Transformer 기반의 foundation model 시대를 열었습니다. 2026년 현재까지도 Transformer의 기본 골격은 유지되면서 Flash Attention, RoPE, GQA 등 효율성과 확장성을 개선하는 후속 연구가 활발히 진행되고 있습니다.

🫸 강점과 한계

[강점] 병렬 처리 가능성: RNN의 순차 처리를 완전히 제거하여 GPU 활용을 극대화했습니다. 이는 단순한 속도 개선이 아니라, 이후 수천억 파라미터 모델의 훈련을 가능하게 한 구조적 전환점이었습니다.

[강점] 아키텍처의 우아한 단순성: Encoder와 Decoder 모두 동일한 빌딩 블록(Multi-Head Attention + FFN + Residual + LayerNorm)의 반복으로 구성됩니다. 이 모듈화된 설계가 다양한 변형과 확장을 가능하게 했습니다.

[강점] 장거리 의존성 포착: Self-Attention은 시퀀스 내 임의의 두 위치 사이 경로 길이가 O(1)으로, RNN의 O(n)이나 CNN의 O(log_k(n))보다 월등합니다.

[한계] Self-Attention의 계산 복잡도가 시퀀스 길이의 제곱(O(n²))에 비례하여, 긴 시퀀스 처리에 메모리와 연산 부담이 큽니다. 이후 Linformer, Performer, Flash Attention 등이 이 문제를 해결하려 시도했습니다.

[한계] 논문은 기계 번역과 구문 분석에서만 실험을 진행했으며, 이후 밝혀진 Transformer의 범용성(비전, 음성, 과학 등)은 후속 연구들의 공입니다.

[시사점] '더 단순한 아키텍처가 더 강력할 수 있다'는 교훈을 남겼습니다. 복잡한 게이팅 메커니즘(LSTM)을 제거하고 attention이라는 하나의 원리에 집중한 것이 오히려 확장성과 성능 모두를 가져왔습니다.

📄 Attention Is All You Need [Submitted on 12 Jun 2017 (v1), last revised 2 Aug 2023 (this version, v7)] Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N. Gomez, Lukasz Kaiser, Illia Polosukhin

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료❗️

최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩