TL;DR

📋 핵심 발견

순수 Transformer만으로 ImageNet에서 88.55% 정확도 달성 — CNN 없이도 이미지 분류에서 최고 성능을 기록하며, 'vision = CNN'이라는 공식을 깨뜨렸습니다

JFT-300M(3억 장) 규모의 대규모 사전 학습 시, ViT는 동급 CNN 대비 2~4배 적은 계산 자원으로 동등하거나 더 나은 성능에 도달합니다. 학습 효율성에서 패러다임을 전환한 결과입니다

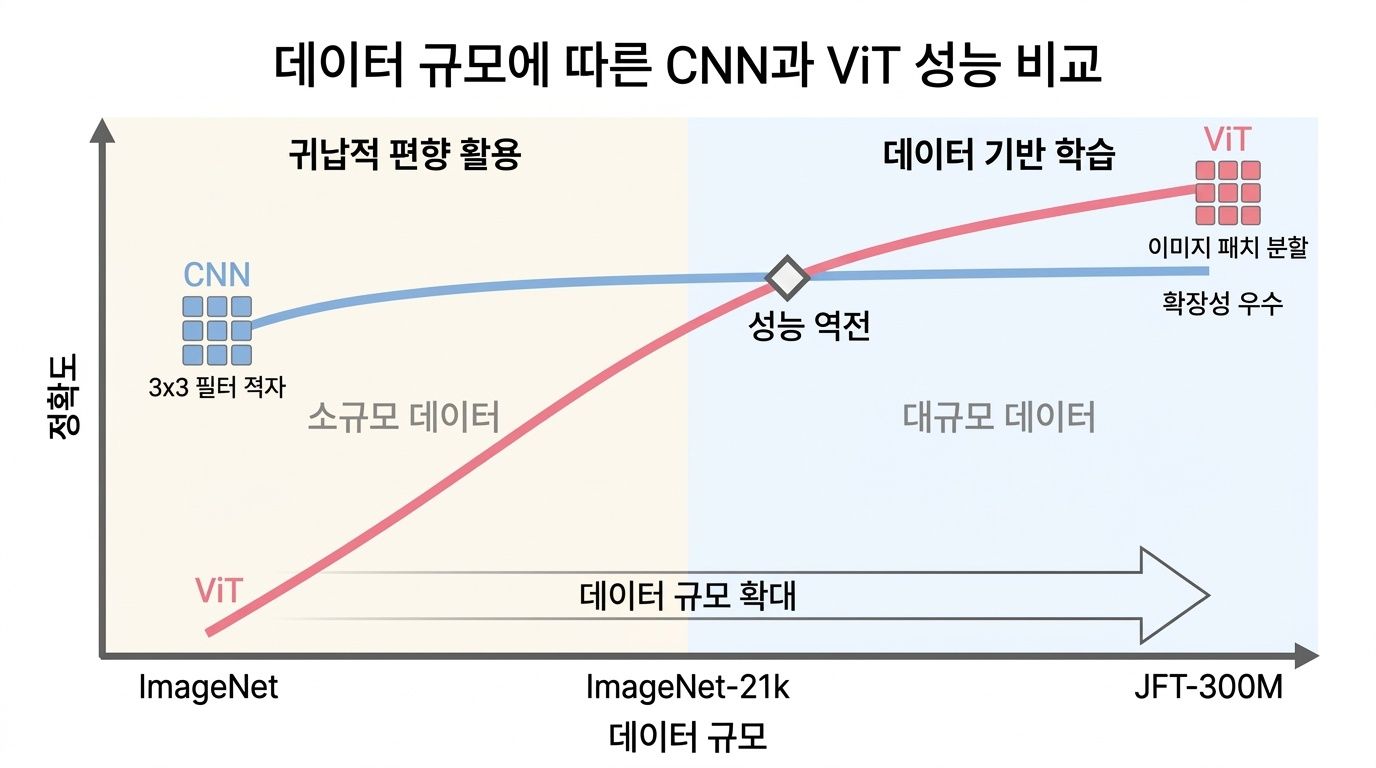

데이터 규모가 핵심 변수임을 실험적으로 증명 — ImageNet(130만 장)에서는 ResNet에 뒤처지지만, JFT-300M에서 사전 학습하면 역전합니다. 귀납적 편향 vs 데이터 규모의 트레이드오프를 명확히 보여준 첫 사례입니다

VTAB 벤치마크의 19개 다양한 태스크에서 기존 CNN 기반 모델(BiT-L)을 전반적으로 능가하며, 단일 아키텍처의 범용성을 입증했습니다

An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale arXiv: 2010.11929

Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, Dirk Weissenborn, Xiaohua Zhai et al.

💡이 논문이 등장한 배경

과거 2020년, 자연어 처리(NLP) 분야에서 Transformer는 이미 독보적인 위치를 차지하고 있었습니다. BERT, GPT 시리즈가 텍스트의 세계를 석권한 반면, 컴퓨터 비전은 여전히 CNN(Convolutional Neural Network)의 왕국이었습니다. ResNet, EfficientNet 같은 CNN 아키텍처가 이미지 인식의 표준이었죠.

물론 attention 메커니즘을 비전에 적용하려는 시도는 있었습니다. 하지만 대부분 CNN 구조 위에 attention을 '얹는' 방식이었습니다. 마치 기존 자동차 엔진에 터보차저를 추가하는 식이었지, 엔진 자체를 바꾸지는 않았던 겁니다. CNN의 핵심 구조 — 컨볼루션 레이어, 풀링 레이어 — 는 그대로 유지한 채 부분적으로만 Transformer를 차용했습니다.

이런 상황에서 Google Research 팀은 근본적인 질문을 던졌습니다: "CNN이 정말 필요한가? NLP에서 작동하는 Transformer를 이미지에 직접 적용하면 어떨까?" 이 질문이 바로 Vision Transformer(ViT)의 출발점이었습니다.

🔍 핵심 아이디어

ViT의 핵심 아이디어는 놀라울 정도로 단순합니다. 이미지를 단어처럼 취급하자는 것입니다.

책을 읽을 때 우리는 문장을 단어 단위로 나눠서 이해합니다. ViT는 이미지를 똑같이 처리합니다. 224x224 픽셀 이미지를 16x16 크기의 작은 패치 196개로 잘라냅니다. 각 패치가 하나의 '단어'가 되는 셈이죠. 논문 제목 "An Image is Worth 16x16 Words"는 바로 이 아이디어를 함축합니다.

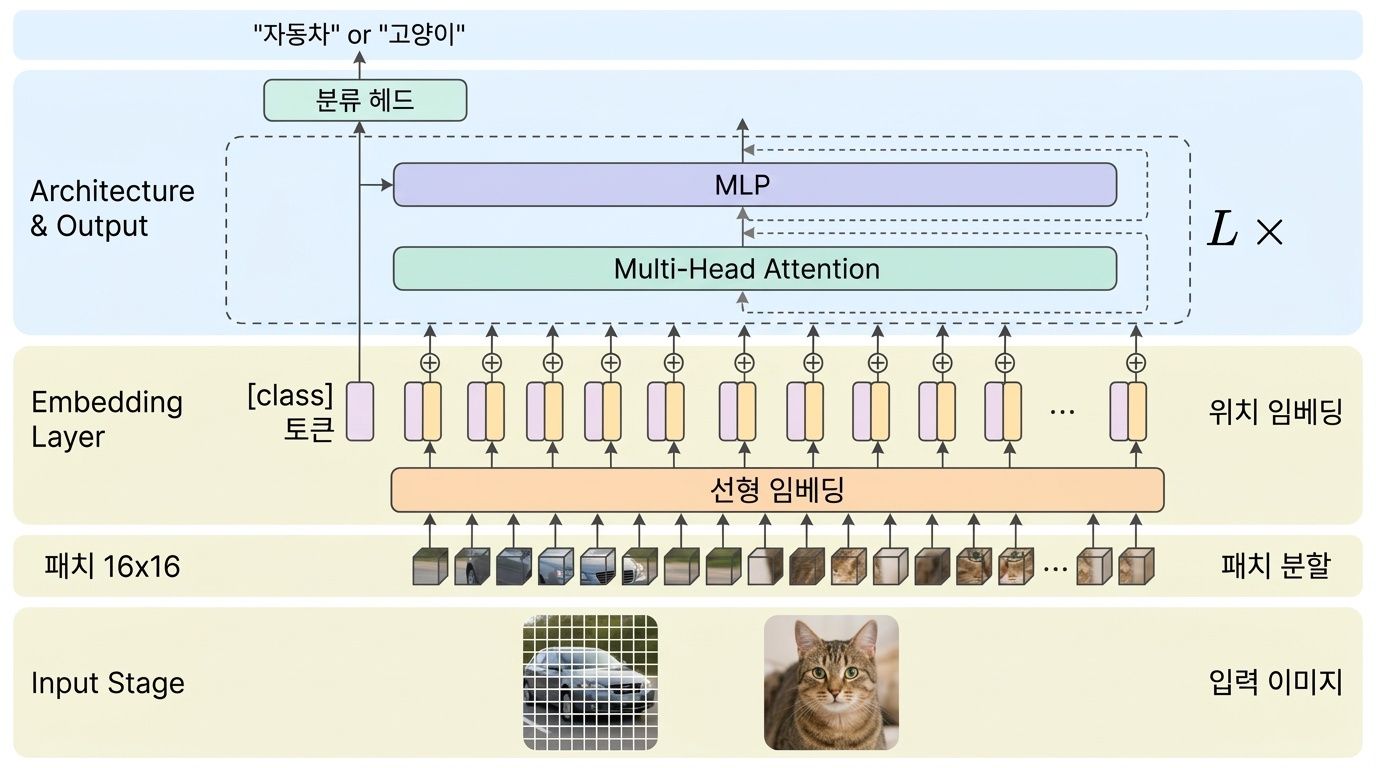

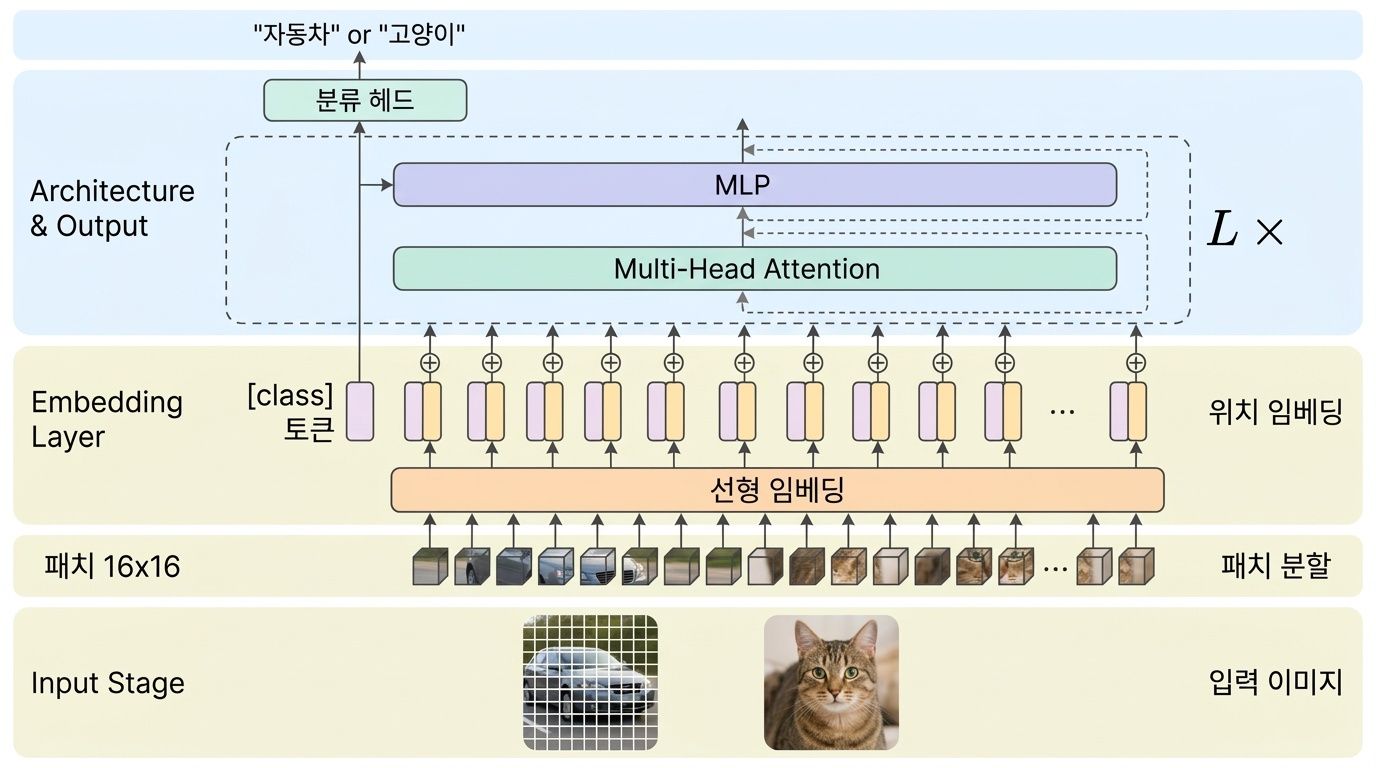

원본 이미지가 고정 크기 패치로 분할되고, 각 패치가 선형 임베딩된 후, 학습 가능한 [class] 토큰과 위치 임베딩이 추가되어 Transformer 인코더의 입력 시퀀스를 형성하는 과정을 보여줍니다. Transformer 인코더 스택을 거쳐 최종적으로 분류 헤드가 이미지 클래스를 예측하는 전체 파이프라인을 시각화합니다.

이렇게 잘린 패치들은 선형 변환(linear projection)을 거쳐 고정된 차원의 벡터로 변환됩니다. 여기에 NLP의 BERT에서 영감을 받은 [CLS] 토큰이 시퀀스 맨 앞에 추가됩니다. 이 특별한 토큰은 전체 이미지를 대표하는 역할을 하며, 최종 분류는 이 토큰의 출력에 기반합니다. 또한 각 패치에는 위치 임베딩(position embedding)이 더해져, 모델이 패치의 공간적 위치를 인식할 수 있게 합니다.

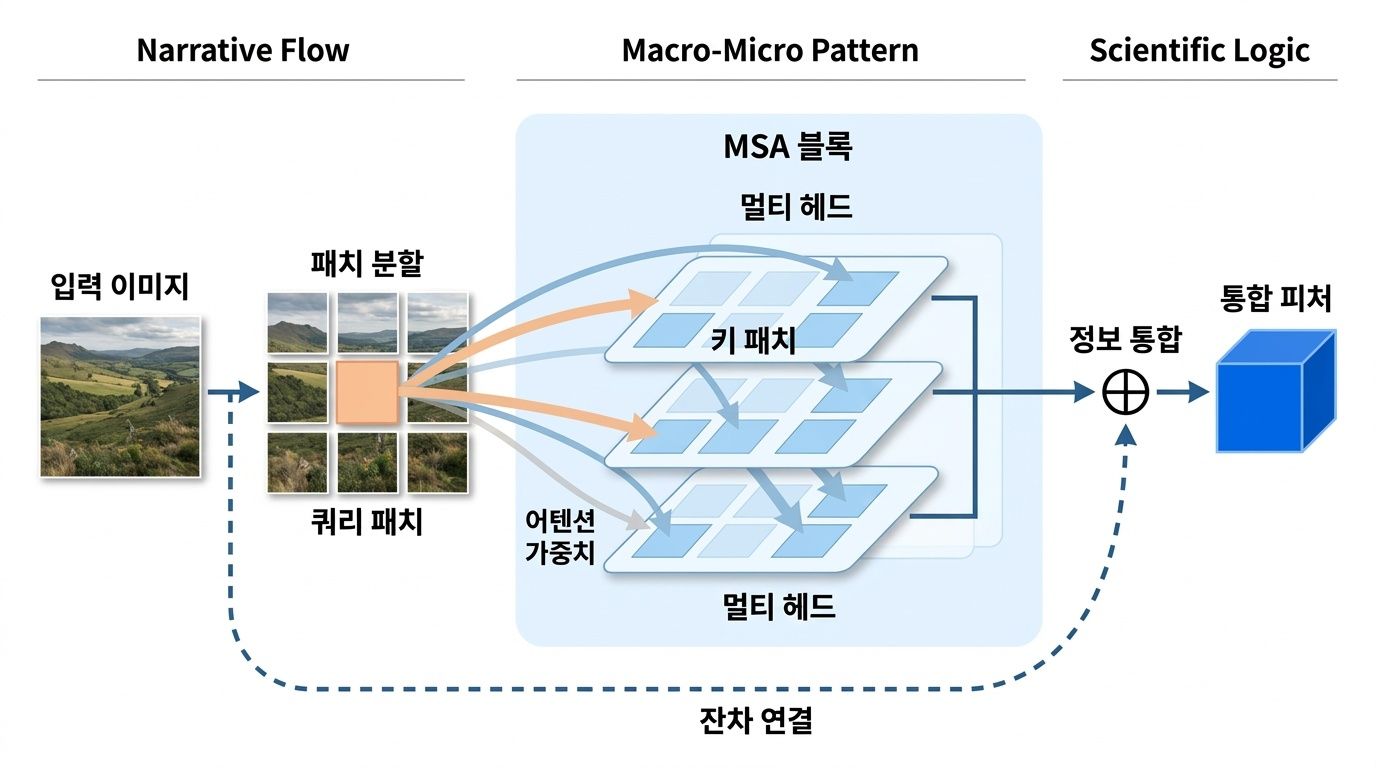

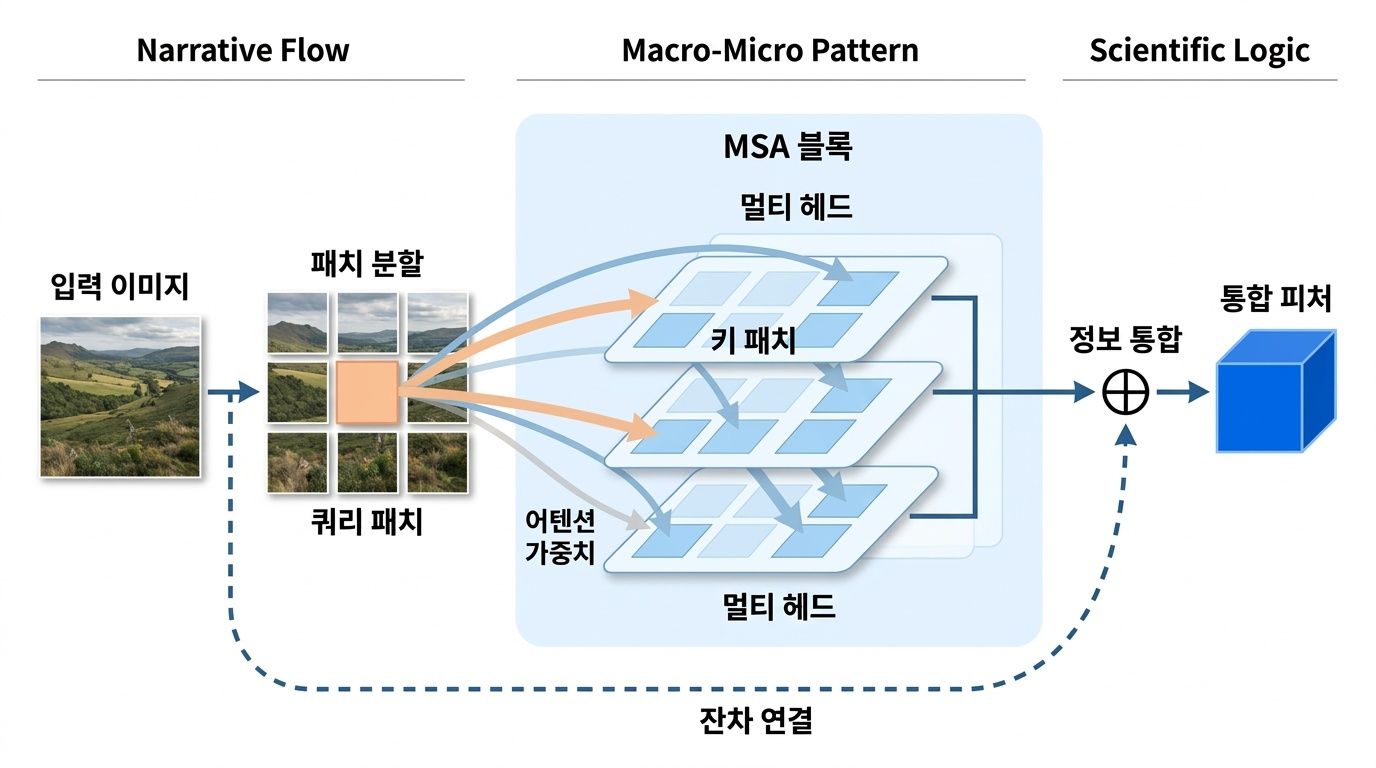

CNN과의 결정적 차이는 '시야'에 있습니다. CNN은 작은 필터(예: 3x3)로 주변 픽셀만 보면서 점점 시야를 넓혀가는 반면, ViT의 self-attention은 첫 레이어부터 모든 패치가 다른 모든 패치를 볼 수 있습니다. 마치 CNN이 돋보기로 그림을 한 부분씩 살피는 거라면, ViT는 처음부터 그림 전체를 한눈에 조망하는 것과 같습니다.

Transformer 인코더 내부의 Multi-Head Self-Attention (MSA) 블록이 어떻게 이미지 패치 간의 관계를 학습하고 정보를 통합하는지 개념적으로 설명합니다. 특정 쿼리 패치가 다른 모든 키 패치에 대해 어텐션 가중치를 계산하고, 이를 통해 전체 이미지의 정보를 통합하는 과정을 시각적인 화살표와 강도로 표현합니다.

하지만 이 '전역적 시야'에는 대가가 있습니다. CNN은 "가까운 픽셀끼리 관련이 있다"는 귀납적 편향(inductive bias)이 구조 자체에 내장되어 있어 적은 데이터로도 효율적으로 학습합니다. ViT에는 이런 사전 지식이 거의 없습니다. 따라서 데이터가 부족하면 일반화 성능이 떨어지지만, 충분한 데이터가 주어지면 편향 없이 데이터로부터 직접 최적의 패턴을 학습합니다. 이것이 ViT가 대규모 사전 학습에서 빛나는 이유입니다.

CNN은 이미지의 지역적 구조를 활용하는 귀납적 편향이 내재되어 있어 소규모 데이터셋에서도 효율적으로 학습됩니다. 반면 ViT는 이러한 편향이 부족하여 충분하지 않은 데이터로 학습할 경우 일반화 성능이 떨어지는 경향을 보입니다. 그러나 JFT-300M과 같은 대규모 데이터셋으로 학습할 경우, ViT는 데이터로부터 직접 시각적 특징을 학습하여 CNN의 성능을 추월하며 대규모 데이터 학습에 대한 뛰어난 확장성을 입증합니다.

🤔 어떻게 작동하는가

Step 1: 이미지를 패치로 분할 — 사진을 퍼즐 조각으로 자르기

입력 이미지(예: 224x224)를 고정 크기의 패치(예: 16x16)로 나눕니다. 224÷16 = 14이므로, 가로 14 x 세로 14 = 총 196개의 패치가 생성됩니다. 각 패치는 16x16x3(RGB) = 768차원의 벡터로 펼쳐집니다(flatten). 이 과정은 문장을 단어로 토큰화하는 것과 정확히 대응됩니다.

원본 이미지가 고정 크기 패치로 분할되고, 각 패치가 선형 임베딩된 후, 학습 가능한 [class] 토큰과 위치 임베딩이 추가되어 Transformer 인코더의 입력 시퀀스를 형성하는 과정을 보여줍니다. Transformer 인코더 스택을 거쳐 최종적으로 분류 헤드가 이미지 클래스를 예측하는 전체 파이프라인을 시각화합니다.

Step 2: 선형 임베딩 + 특별 토큰 — 퍼즐 조각에 번호표 달기

각 패치 벡터는 학습 가능한 선형 레이어(E)를 통해 D차원(예: 768)의 임베딩 벡터로 변환됩니다. 시퀀스 맨 앞에는 BERT의 [CLS] 토큰과 같은 역할을 하는 학습 가능한 클래스 토큰이 추가됩니다. 그리고 각 위치에 학습 가능한 1D 위치 임베딩이 더해져, 모델이 패치의 순서와 위치를 파악할 수 있게 합니다. 흥미롭게도, 저자들은 2D 위치 임베딩이 1D보다 큰 이점을 주지 않았다고 보고합니다.

Step 3: Transformer 인코더 — 모든 조각이 서로를 바라보다

NLP의 Transformer 인코더를 거의 그대로 사용합니다. 각 블록은 Multi-Head Self-Attention(MSA)과 MLP(Feed-Forward Network)로 구성되며, 두 블록 모두 Layer Normalization과 잔차 연결(residual connection)이 적용됩니다. 핵심은 MSA에서 모든 패치가 다른 모든 패치에 attention을 계산한다는 것입니다. 저자들의 분석에 따르면, 얕은 레이어의 attention head는 가까운 패치에 집중하고(CNN의 지역 필터처럼), 깊은 레이어로 갈수록 멀리 있는 패치까지 주의를 기울입니다.

Transformer 인코더 내부의 Multi-Head Self-Attention (MSA) 블록이 어떻게 이미지 패치 간의 관계를 학습하고 정보를 통합하는지 개념적으로 설명합니다. 특정 쿼리 패치가 다른 모든 키 패치에 대해 어텐션 가중치를 계산하고, 이를 통해 전체 이미지의 정보를 통합하는 과정을 시각적인 화살표와 강도로 표현합니다.

Step 4: [CLS] 토큰이 최종 답을 내다

Transformer 인코더의 마지막 레이어에서 [CLS] 토큰의 출력 벡터가 MLP 분류 헤드에 입력되어 최종 클래스를 예측합니다. 이 [CLS] 토큰은 self-attention을 통해 모든 패치의 정보를 종합한 '전체 이미지 요약'의 역할을 합니다.

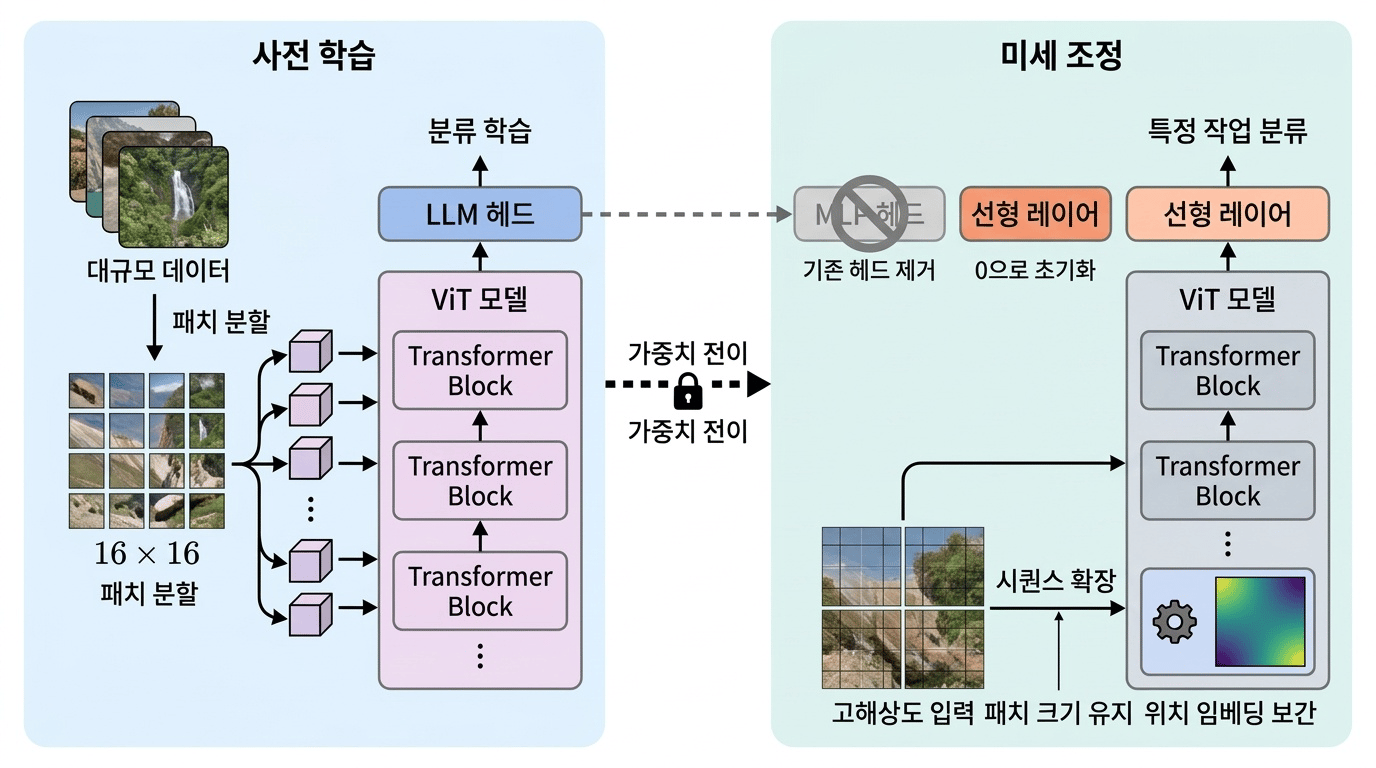

Step 5: 대규모 사전 학습 → 전이 학습 — 큰 그림을 먼저 보고, 세부 조정하기

ViT의 진정한 힘은 대규모 데이터셋(ImageNet-21k 1,400만 장 또는 JFT-300M 3억 장)에서의 사전 학습에서 나옵니다. 사전 학습 후 특정 태스크로 전이할 때, 사전 학습된 MLP 헤드를 제거하고 0으로 초기화된 새 선형 레이어를 붙입니다. 고해상도 이미지로 미세 조정할 경우, 패치 크기는 유지하되 시퀀스 길이가 늘어나므로, 사전 학습된 위치 임베딩을 2D 보간(interpolation)하여 적용합니다.

ViT는 대규모 데이터셋에서 사전 학습된 후 특정 작업을 위해 미세 조정(Fine-tuning)되는 파이프라인을 따릅니다. 사전 학습 단계에서는 MLP 헤드를 통해 분류를 학습하며, 전이 학습 시에는 이 헤드를 제거하고 새로운 작업에 맞는 0으로 초기화된 선형 레이어를 부착합니다. 특히 고해상도 이미지로 미세 조정할 때 패치 크기를 유지하면서 시퀀스 길이를 늘려 성능을 최적화하며, 이때 위치 임베딩을 이미지 내 위치에 따라 보간하여 적용합니다.

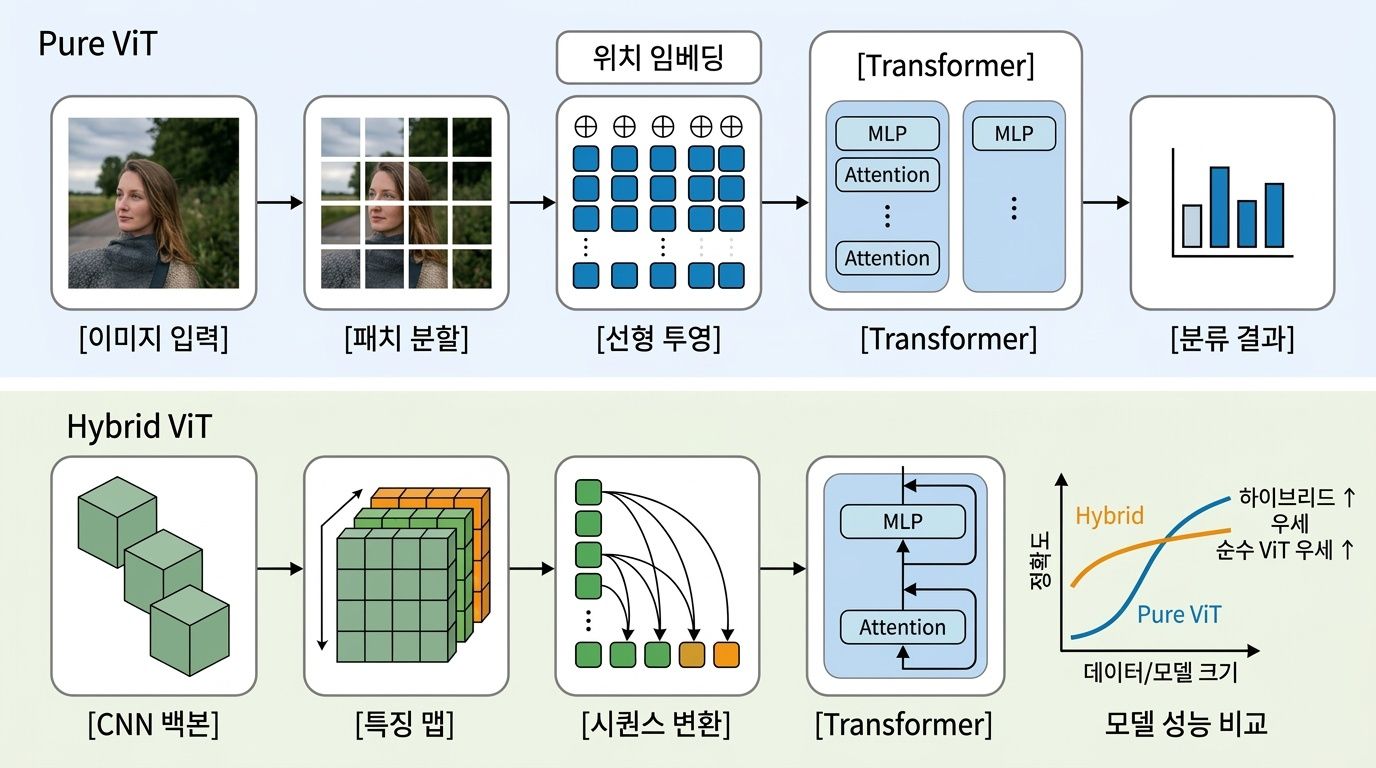

Step 6: 하이브리드 아키텍처 — CNN과의 협업도 가능

논문은 순수 ViT 외에도 CNN(ResNet)의 중간 특징 맵을 패치 대신 사용하는 하이브리드 모델도 실험합니다. 적은 계산 예산에서는 하이브리드가 순수 ViT보다 우수하지만, 모델과 데이터 규모가 충분히 커지면 순수 ViT가 하이브리드의 성능을 따라잡습니다. 이는 CNN의 귀납적 편향이 데이터가 적을 때만 유리하다는 핵심 발견을 뒷받침합니다.

순수 ViT는 이미지를 직접 패치로 나누는 반면, 하이브리드 아키텍처는 CNN 백본을 통해 추출된 특징 맵을 트랜스포머의 입력 시퀀스로 활용합니다. 실험 결과, 하이브리드 모델은 상대적으로 적은 계산 비용이 투입되는 구간에서 순수 ViT보다 높은 정확도를 보여 CNN의 초기 특징 추출 능력이 유효함을 시사합니다. 하지만 모델의 크기와 사전 학습 데이터가 충분히 커지면 순수 ViT가 하이브리드 모델의 성능을 따라잡거나 능가하게 됩니다.

🛠️ 실험이 말해주는 것

ViT는 세 가지 크기의 모델로 실험되었습니다: ViT-Base(86M 파라미터), ViT-Large(307M), ViT-Huge(632M). 가장 큰 모델인 ViT-H/14는 JFT-300M에서 사전 학습 후 ImageNet에서 88.55%의 top-1 정확도를 기록하며, 당시 최고 성능이던 Noisy Student EfficientNet(88.4%)을 넘어섰습니다. 특히 주목할 점은 이 성능을 달성하는 데 필요한 계산 비용이 2,500 TPUv3-core-days로, 비슷한 성능의 CNN 모델(BiT-L: 9,900 TPUv3-core-days)의 약 4분의 1에 불과했다는 것입니다.

데이터 규모에 따른 성능 변화가 가장 인상적인 실험입니다. ImageNet(130만 장)만으로 학습하면 ViT-Large는 BiT-L(ResNet152x4)보다 낮은 성능을 보입니다. ImageNet-21k(1,400만 장)으로 넓히면 격차가 줄어들고, JFT-300M(3억 장)에서는 역전이 일어납니다. 이 실험은 "ViT는 데이터가 곧 귀납적 편향"이라는 핵심 메시지를 명확히 전달합니다. 데이터가 충분하면 모델이 CNN이 구조적으로 가정하는 것들(지역성, 변환 등변성)을 스스로 학습할 수 있다는 것입니다.

VTAB(Visual Task Adaptation Benchmark)의 19개 다양한 태스크(자연 이미지, 특수 이미지, 구조화된 이미지)에서 ViT-H/14는 전반적으로 BiT-L을 능가하며, 특히 구조화된 태스크(structured tasks)에서 큰 격차를 보였습니다. 내부 분석에서 저자들은 ViT가 학습한 위치 임베딩이 2D 공간 구조를 반영하고 있으며, 낮은 레이어에서도 전역적 정보를 통합하고, 높은 레이어에서는 분류와 관련된 의미론적 영역에 집중한다는 것을 시각적으로 보여주었습니다.

⚡️ 현실 세계의 임팩트

ViT는 현재 컴퓨터 비전 분야의 사실상 표준 아키텍처가 되었습니다. Meta의 DINOv2, OpenAI의 CLIP, Meta의 Segment Anything Model(SAM) 등 현재 가장 영향력 있는 비전 모델들이 모두 ViT를 백본으로 사용합니다. Apple의 SAM-CLIP 연구에서도 ViT 기반 모델의 통합을 진행하고 있습니다

발표 후 약 5년 만에 50,000회 이상 인용되며, 딥러닝 역사상 가장 빠르게 인용이 증가한 논문 중 하나가 되었습니다. ViT는 DALL-E, Stable Diffusion 등 이미지 생성 모델에서도 핵심 컴포넌트로 활용되며, 비전-언어 통합 모델(GPT-4V, Gemini 등)의 시각 인코더로도 채택되었습니다

Vision Transformer 시장은 2024년 약 2.8억 달러에서 2032년 약 27.8억 달러로 성장이 전망됩니다(CAGR 33.2%). 의료 영상, 자율주행, 보안, 리테일 등 산업 전반에서 실제 제품에 탑재되어 사용되고 있습니다

ViT의 성공은 'NLP와 비전의 아키텍처 통일'이라는 거대한 흐름을 촉발했습니다. 이는 결국 텍스트, 이미지, 오디오를 하나의 Transformer로 처리하는 멀티모달 AI의 기반이 되었습니다

☝️ 연구의 계보

ViT는 Vaswani et al.의 "Attention Is All You Need"(2017) Transformer를 직접 계승합니다. NLP에서 BERT(2018)와 GPT 시리즈가 Transformer의 위력을 증명한 후, 이를 비전으로 확장한 첫 번째 성공적인 순수 Transformer 모델입니다. 이전에도 attention을 비전에 적용한 연구(Non-local Neural Networks, Stand-Alone Self-Attention 등)가 있었지만, CNN 구조를 완전히 제거한 것은 ViT가 처음입니다.

ViT 이후 DeiT(Data-efficient Image Transformers), Swin Transformer, BEiT, MAE(Masked Autoencoders) 등 수많은 후속 연구가 이어졌습니다. 특히 Swin Transformer는 계층적 구조를 도입하여 detection과 segmentation으로 확장했고, MAE는 ViT에 자기지도 학습을 적용하여 레이블 없는 대규모 학습의 가능성을 열었습니다. 현재 DINO, DINOv2, SAM, CLIP 등 비전 foundation model의 거의 모든 주류가 ViT 기반입니다.

🫸 강점과 한계

[강점] 아키텍처의 단순함 — NLP의 Transformer를 최소한의 수정만으로 비전에 적용하여, 두 분야의 아키텍처 통일 가능성을 최초로 증명했습니다

[강점] 확장성(scalability)이 탁월합니다. 모델 크기와 데이터 규모를 키울수록 성능이 포화 없이 계속 향상되며, 같은 성능 대비 CNN보다 2~4배 적은 계산 자원을 사용합니다

[강점] 귀납적 편향 vs 데이터 규모에 대한 명확한 실험적 분석을 제공하여, 후속 연구의 설계 원칙에 큰 영향을 미쳤습니다

[한계] 대규모 데이터셋(JFT-300M)에 대한 접근이 전제되어야 합니다. 소규모 데이터에서는 CNN 대비 성능이 떨어지며, JFT-300M은 Google 내부 데이터셋으로 공개되지 않았습니다

[한계] 이미지 분류에만 집중하며, object detection이나 segmentation 같은 밀집 예측(dense prediction) 태스크는 다루지 않았습니다. 이 확장은 후속 연구(Swin Transformer, ViTDet 등)에 맡겨졌습니다

[시사점] 이 논문의 핵심 교훈은 '충분한 데이터가 주어지면 도메인 특화 귀납적 편향보다 범용 아키텍처가 승리한다'는 것이며, 이는 이후 foundation model 패러다임의 이론적 근거가 되었습니다

ViT-H/14 ImageNet 88.55% — Table 2, Section 4.2 — JFT-300M 사전 학습 후 ImageNet 전이 학습 결과

CNN 대비 2~4배 적은 계산 자원 — Figure 5, Section 4.4 — ViT-H/14: 2,500 TPUv3-core-days vs BiT-L: 9,900

1D vs 2D 위치 임베딩 성능 차이 미미 — Table 8, Appendix D.4 — 다양한 위치 임베딩 방식 비교 실험

데이터 규모별 ViT vs CNN 성능 역전 — Figure 3, Figure 4, Section 4.4 — ImageNet → ImageNet-21k → JFT-300M 순으로 실험

VTAB 19개 태스크 전반적 우위 — Table 2, Section 4.2 — Natural, Specialized, Structured 세 그룹 결과

Attention head의 지역→전역 패턴 — Figure 7, Section 4.5 — mean attention distance 분석

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료❗️

최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩