TL;DR

📋 2026년 3월 19일 오늘의 논문

오늘은 'AI가 숨기려 해도 결국 드러나는 것들'을 모았어요. 거짓말할 때 심박수가 올라가는 것처럼 AI도 헛소리하면 흔적이 남고, 복잡한 치아 배열도 핵심 포인트만 짚으면 한눈에 보이거든요. 감추려 해도 패턴은 못 속인다는 걸 보여주는 두 편이에요.

[☝️] AI가 거짓말하는 순간, 노이즈에서 흔적이 남는다고요?

[✌️] AI가 치아를 구분하는 비결? 딱 16개 점만 찍으면 된대요

[☝️]. AI가 거짓말하는 순간, 노이즈에서 흔적이 남는다고요?

DynHD: Hallucination Detection for Diffusion Large Language Models via Denoising Dynamics Deviation Learning

#D-LLM #Dream #LLaDA #denoising #denoising dynamics #diffusion #diffusion language model #hallucination detection

💡 TL;DR AI가 그럴듯한 거짓말을 할 때, 어떻게 잡아낼 수 있을까요? DynHD는 AI가 답을 만들어가는 과정을 심전도처럼 읽어요. 정상 답변은 심박이 안정적으로 내려가는데, 거짓말은 끝부분에서 심박이 튀거든요. 이 '궤적의 흔들림'을 포착해서 기존 최고 방법보다 정확도를 12.2%나 끌어올렸어요.

🔍 핵심 발견

기존 최고 성능 모델보다 12.2% 더 정확해요. 여러 벤치마크에서 일관되게 이겼어요. 한쪽만 잘하는 게 아니라 전방위로 잘한다는 뜻이에요.

AI가 만드는 토큰 중 진짜 의미 있는 건 일부뿐이에요. 마치 시험 답안지에서 이름·학번 칸은 채점 안 하듯, 패딩이나 구두점 같은 '빈 칸'을 걸러내니까 정확도가 확 올라갔어요.

정직한 답변은 노이즈가 깔끔하게 줄어들어요. 반면 거짓말은 끝부분에서 엔트로피가 멈추거나 다시 튀어올라요. 체온계로 비유하면, 건강한 사람은 체온이 36.5도로 안정되는데 아픈 사람은 내려가다 다시 오르는 거예요.

정확할 뿐 아니라 빠르기까지 해요. 실제 서비스에 붙일 수 있을 만큼 효율적이라는 게 핵심이에요.

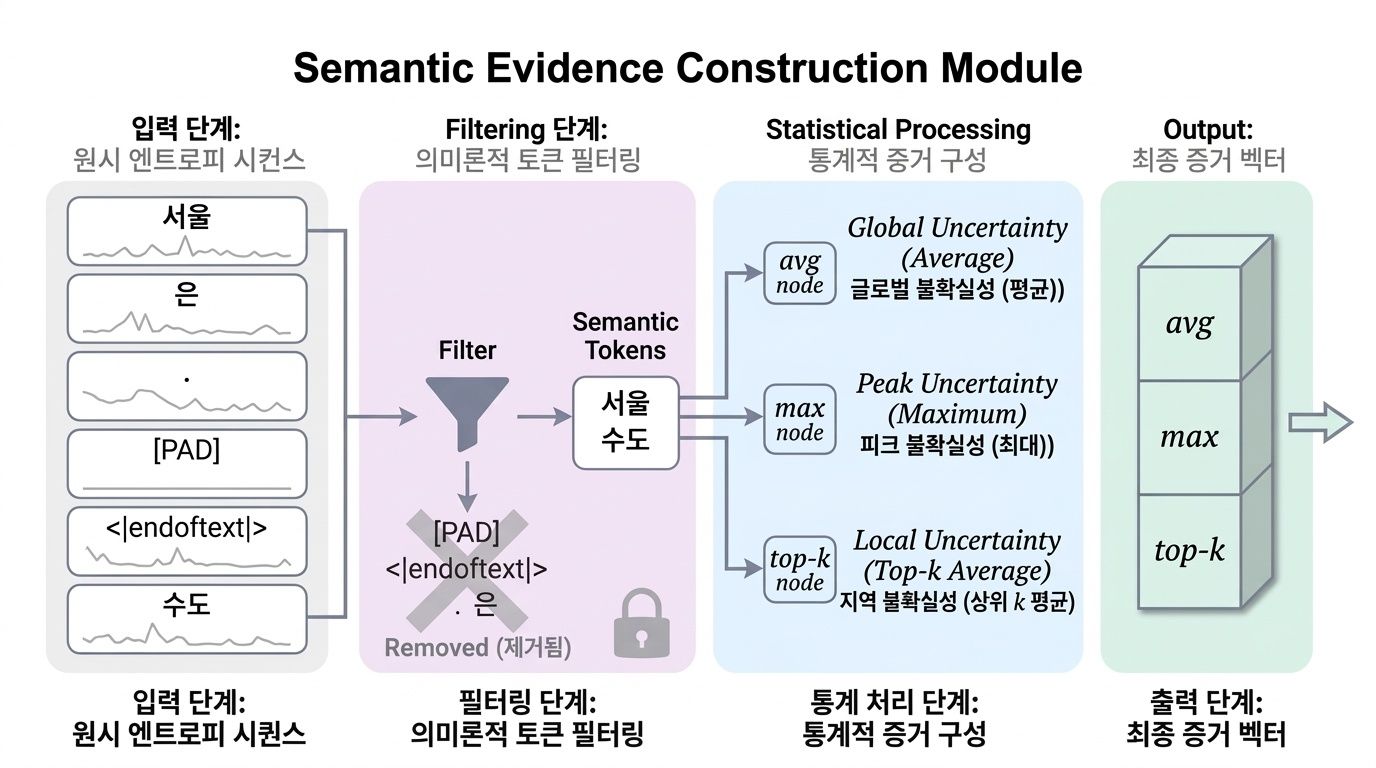

의미론적 증거 구성 모듈 상세 — D-LLM의 원시 토큰 엔트로피 시퀀스를 입력으로 받아, 규칙 기반 필터링을 통해 <|endoftext|>, [PAD], 구두점, 불용어 등 비정보성/구조적 토큰을 제거하는 '의미론적 토큰 필터링' 과정을 시각화합니다. 이어서, 남은 의미론적 토큰들의 엔트로피 분포에서 글로벌 불확실성(평균), 피크 불확실성(최대), 지역 불확실성(상위 k 평균)과 같은 통계적 증거를 추출하여 최종 증거 벡터를 구성하는 '통계적 증거 구성' 과정을 단계별로 보여줍니다.

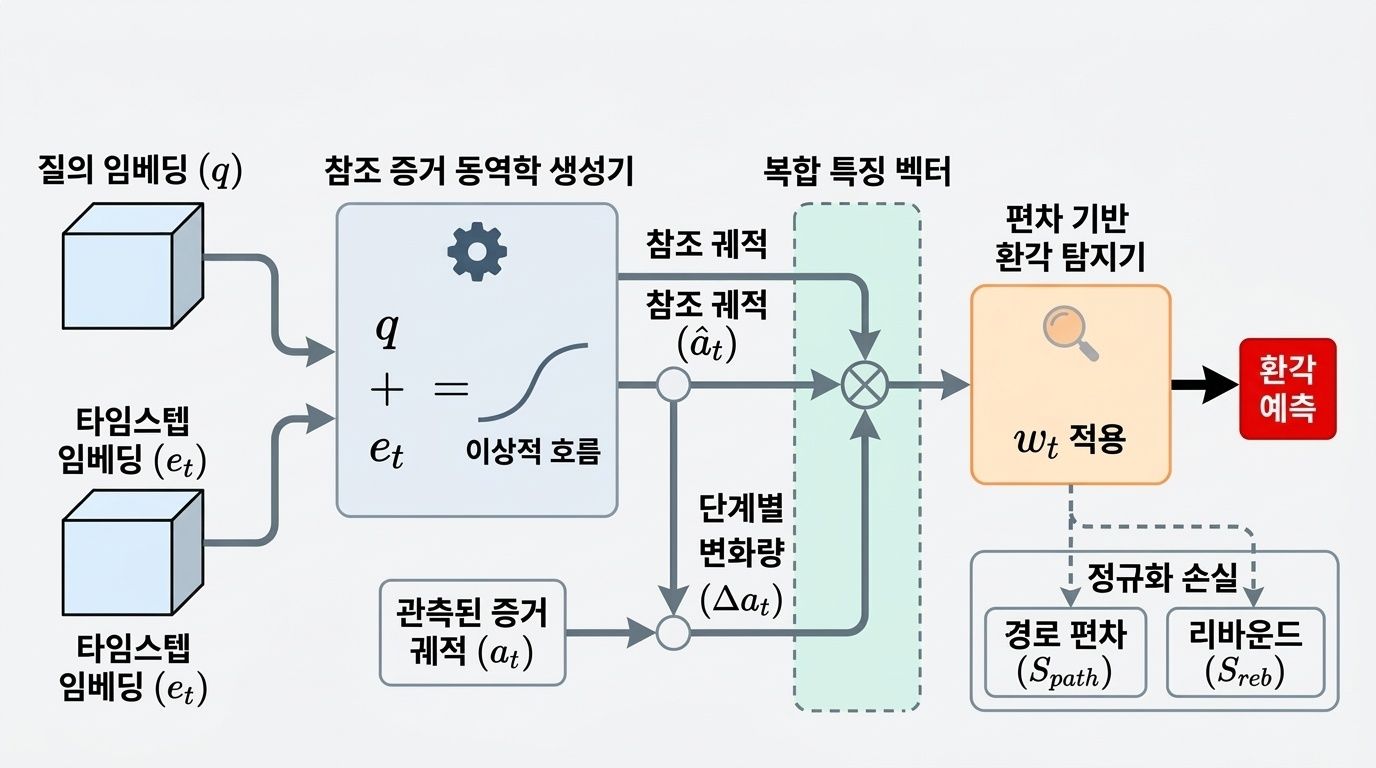

동적 편차 학습 모듈 작동 원리 — DynHD의 동적 편차 학습 모듈의 핵심 구성 요소를 시각화합니다. 먼저, 질의 임베딩(q)과 타임스텝 임베딩(e_t)을 입력으로 받아 사실적 응답에 대한 예상 '참조 증거 궤적(â_t)'을 생성하는 '참조 증거 동역학 생성기(Reference Evidence Dynamics Generator)'의 역할을 보여줍니다. 다음으로, 실제 관측된 '증거 궤적(a_t)'과 참조 궤적(â_t), 그리고 단계별 변화량(Δa_t)을 결합한 복합 특징 벡터를 입력으로 받아 환각 여부를 예측하는 '편차 기반 환각 탐지기(Deviation-based Hallucination Detector)'의 데이터 흐름과 가중치(w_t) 적용 과정을 상세하게 보여줍니다. 최종 예측에 기여하는 '경로 편차(S_path)' 및 '리바운드(S_reb)' 정규화 손실의 개념도 포함합니다.

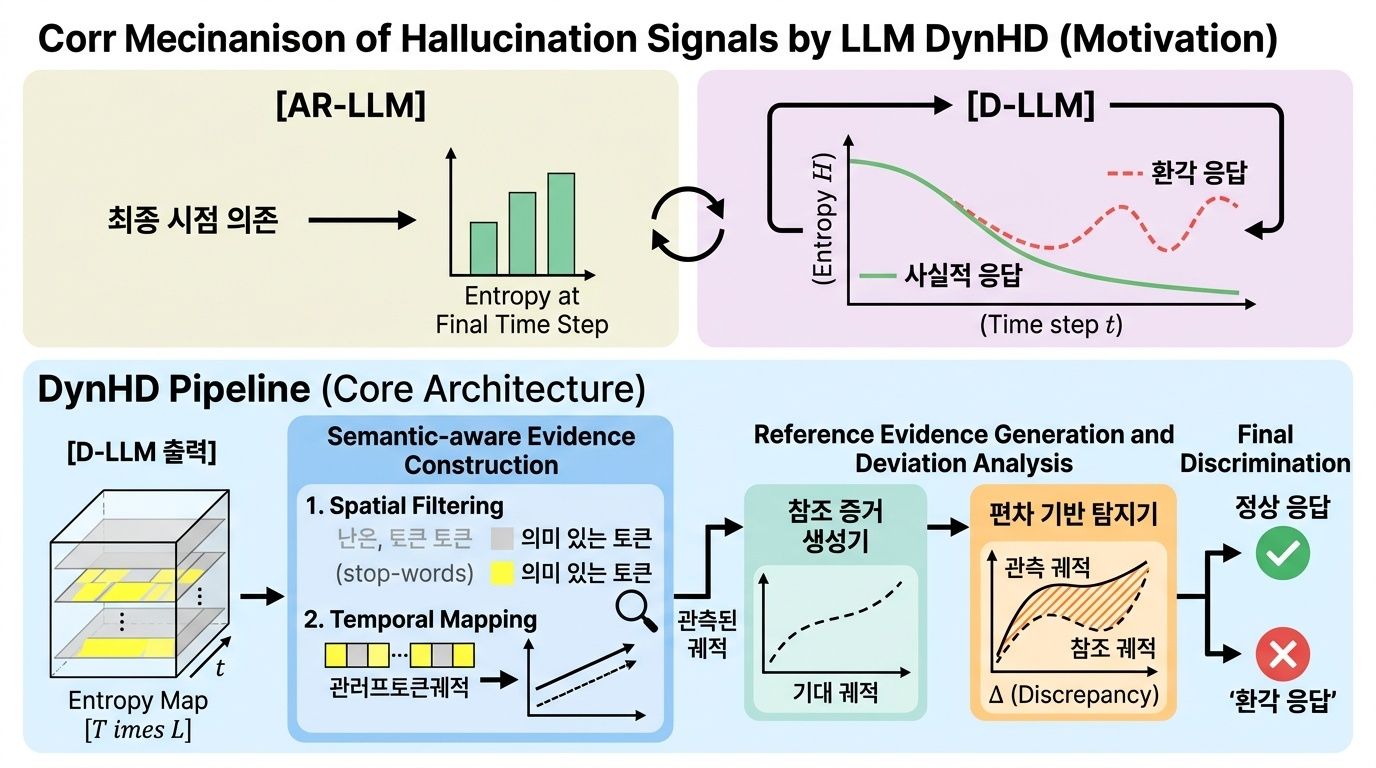

LLM 유형별 환각 신호 특성 및 DynHD의 차별점 — AR-LLM이 주로 최종 단계의 확률값에 의존하는 것과 달리, D-LLM은 여러 단계의 반복적인 정제 과정을 거치므로 환각 신호가 전체 궤적에 걸쳐 나타납니다. DynHD는 단순히 특정 시점의 불확실성을 보는 것이 아니라, 전체 노이즈 제거 동역학(Denoising Dynamics)의 형태를 모델링한다는 점에서 차별화됩니다. Figure 2와 5에서 보여주듯, 사실적인 응답은 엔트로피가 매끄럽게 감소하지만 환각은 후기 단계에서 불안정한 패턴을 보입니다. DynHD는 이러한 궤적의 '모양'과 '수렴 양상'을 참조 경로와 비교함으로써 훨씬 정밀한 탐지가 가능합니다.

🛠️ 실무 시사점

D-LLM(확산 기반 언어모델, LLaDA나 Dream 같은 차세대 AI)을 실제 서비스에 쓸 때, DynHD를 뒷단 필터로 달면 거짓 답변을 걸러낼 수 있어요. 챗봇이 엉뚱한 말 하는 걸 막아주는 거예요.

고정 길이로 답을 만드는 AI에서는 모든 토큰을 똑같이 취급하면 안 돼요. 앞으로 이런 모델을 설계할 때 의미 있는 토큰만 골라보는 전처리가 기본이 될 거예요.

노이즈 제거 궤적의 '모양'을 분석한다는 건 완전히 새로운 접근이에요. 기존 ChatGPT 같은 모델용 환각 탐지와는 근본적으로 달라요.

속도도 빨라서 실시간 대화에서도 쓸 수 있어요. 고객 상담 AI 같은 데 바로 적용할 수 있다는 뜻이에요.

📄 DynHD: Hallucination Detection for Diffusion Large Language Models via Denoising Dynamics Deviation Learning [Submitted on 17 Mar 2026] Yanyu Qian, Yue Tan, Yixin Liu, Wang Yu, Shirui Pan

[✌️]. AI가 치아를 구분하는 비결? 딱 16개 점만 찍으면 된대요

TCATSeg: A Tooth Center-Wise Attention Network for 3D Dental Model Semantic Segmentation

#3D #3D dental segmentation #Chamfer Distance #Hungarian matching #attention #ball query #channel-wise attention #dual attention

💡 TL;DR 치과에서 3D 스캔 뜬 경험 있나요? 그 스캔 데이터에서 치아 하나하나를 자동으로 구분하는 건 AI한테도 꽤 어려운 일이에요. 한마디로, TCATSeg는 치아마다 '대표 점' 16개만 콕콕 찍어서 전체 배치를 파악하는 AI예요. 마치 교실 자리배치표에 이름표만 붙이면 누가 어딘지 바로 아는 것처럼요.

🔍 핵심 발견

핵심은 '슈퍼포인트'라는 대표 점 16개예요. 치아마다 중심에 깃발을 꽂는 것과 비슷해요. AI가 스스로 깃발 위치를 학습하면서, 치아 전체 배치를 효율적으로 파악하게 돼요. 기존 방법들은 이런 전체 지도 없이 일했거든요.

생긴 게 비슷한 옆 치아, 어떻게 구분할까요? DPDA와 SGDA라는 이중 어텐션(집중) 모듈이 해결해요. 쉽게 말하면, 멀리서 전체 배치를 보는 눈과 가까이서 디테일을 보는 눈을 동시에 쓰는 거예요. 두 시야를 똑똑하게 섞어서 헷갈리는 치아도 정확히 구분해요.

교정 전 삐뚤빼뚤한 치아 데이터 400개를 새로 만들었어요. 기존 데이터셋은 가지런한 치아 위주라 쉬운 시험만 본 셈이었거든요. 이번엔 진짜 어려운 케이스로 실력을 검증한 거예요.

입력 포인트 10,000개를 4단계로 줄여가며 분석해요. 세그멘테이션(영역 구분), 슈퍼포인트 위치 정렬, 경계 다듬기까지 세 가지 기준을 동시에 최적화해요. 덕분에 치아와 잇몸 경계가 깔끔하게 나뉘어요.

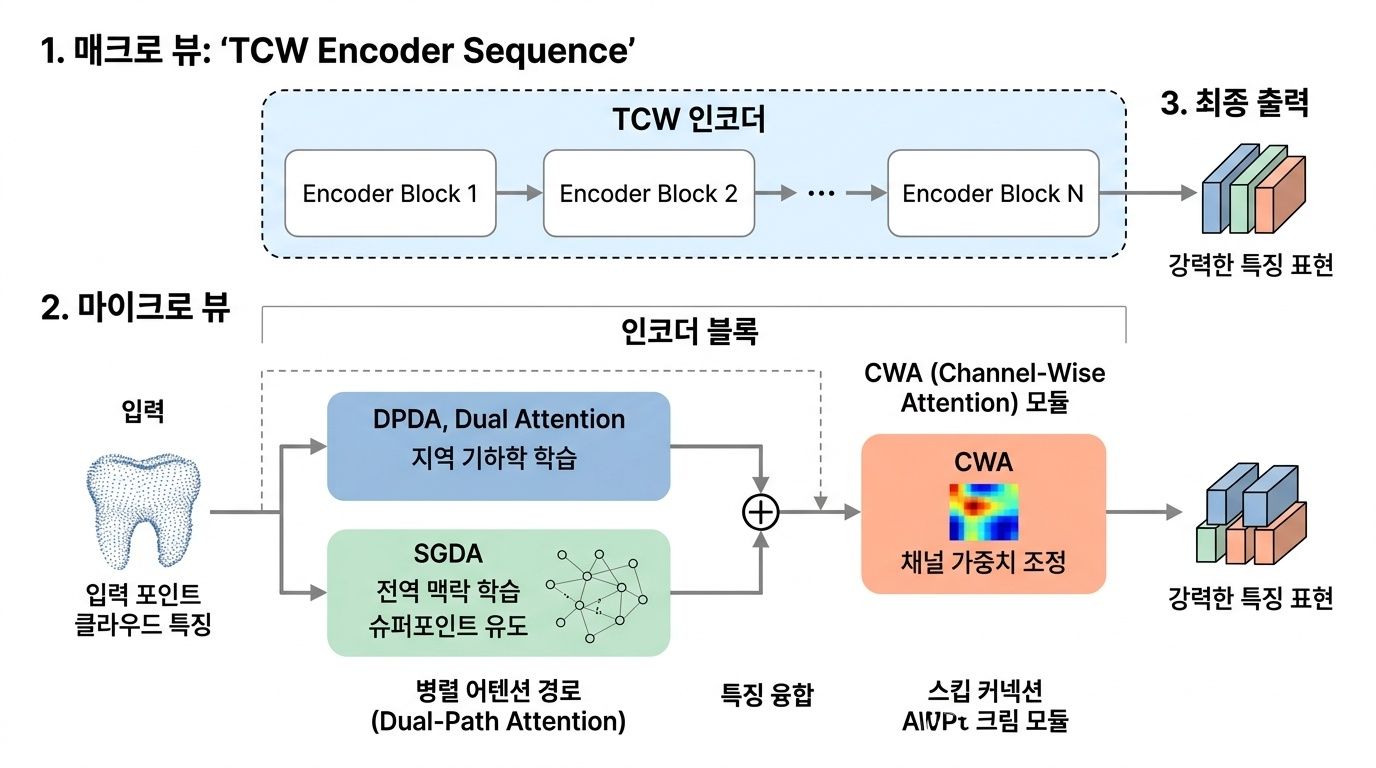

TCW 인코더 내부 구조 — TCW 인코더는 TCATSeg 아키텍처의 핵심으로, 입력된 3D 치아 모델의 포인트 클라우드 특징을 계층적으로 추출합니다. 각 인코더 블록은 DPDA(Dental Perception Dual Attention)와 SGDA(Superpoint Guided Dual Attention)라는 두 가지 혁신적인 모듈을 포함하여 전역적 맥락과 지역적 기하학을 동시에 학습합니다. CWA(Channel-Wise Attention) 메커니즘을 기반으로 채널별 가중치를 적응적으로 조정하여 치아의 복잡한 배치와 형태적 유사성을 효과적으로 구분할 수 있는 강력한 특징 표현을 생성합니다.

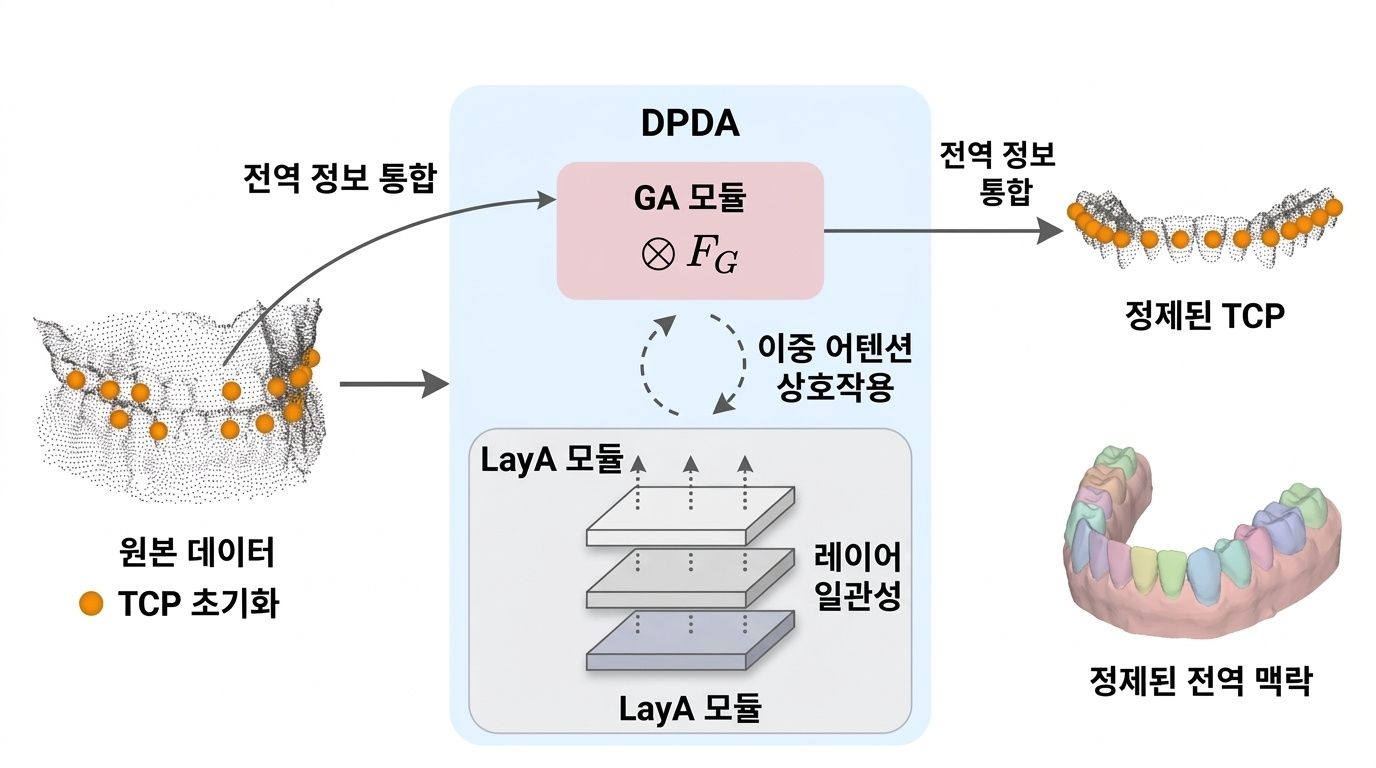

DPDA (Dental Perception Dual Attention) 메커니즘 — DPDA 모듈은 치아의 전역적인 배치 정보를 포착하기 위해 희소한 슈퍼포인트(TCP)를 학습하고 정제하는 과정을 담당합니다. GA 모듈은 원본 포인트 클라우드 전체에서 특징을 집계하여 슈퍼포인트에 전역적 의미를 부여하며, LayA 모듈은 여러 인코더 레이어 간에 슈퍼포인트 표현의 일관성을 유지합니다. 이를 통해 모델은 개별 치아의 위치 관계를 파악하고, 형태가 유사한 인접 치아를 전역적 맥락 내에서 정확하게 식별할 수 있게 됩니다.

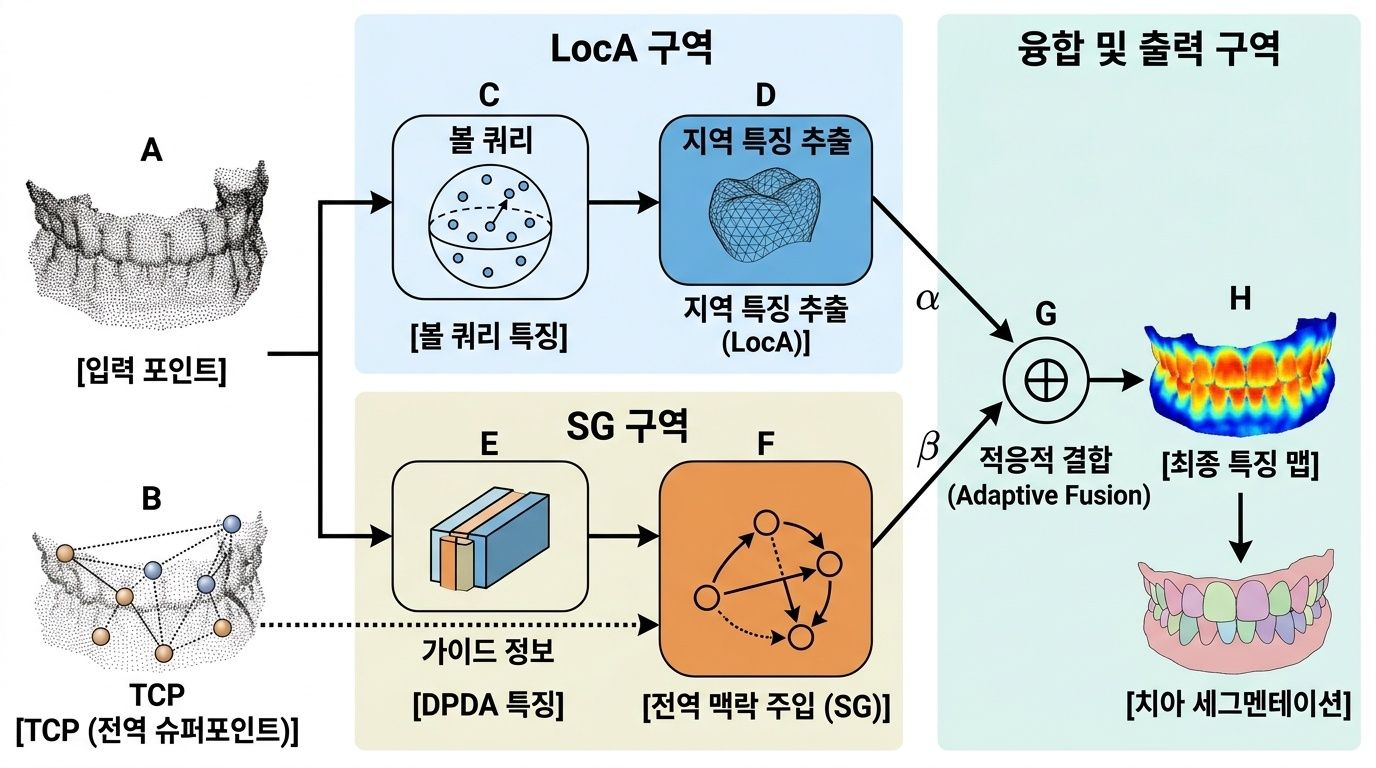

SGDA (Superpoint Guided Dual Attention) 메커니즘 — SGDA 모듈은 DPDA에서 추출된 전역적 의미 맥락을 지역적 기하학적 특징과 효과적으로 통합합니다. LocA는 볼 쿼리(ball query)를 통해 이웃 포인트들의 특징을 집계하여 개별 치아의 세밀한 기하학적 구조를 포착하며, SG는 TCP로부터 얻은 전역 정보를 포인트별 특징에 주입합니다. 이 두 스트림은 학습 가능한 가중치를 통해 적응적으로 결합되어, 치아 경계의 정밀도와 인스턴스 식별 능력을 동시에 향상시킵니다.

🛠️ 실무 시사점

교정 치료받으러 가면 3D 스캔을 떠요. 이 AI가 삐뚤빼뚤한 치아도 자동으로 구분해줘요. 교정 계획 세우는 시간이 확 줄어들 수 있어요.

임플란트나 보철물 설계할 때도 쓸 수 있어요. 옆 치아를 자동으로 인식하니까, 디지털 치과 작업 흐름이 더 빨라져요.

슈퍼포인트 16개만 쓰는 가벼운 설계예요. 치과 진료실 장비처럼 컴퓨팅 파워가 약한 곳에서도 실시간 처리 가능성이 열려요.

교정 전 데이터 400개를 공개했어요. 부정교합(치아가 안 맞는 경우) 연구에 비교 기준이 생긴 셈이에요.

📄 TCATSeg: A Tooth Center-Wise Attention Network for 3D Dental Model Semantic Segmentation [Submitted on 17 Mar 2026] Qiang He, Wentian Qu, Jiajia Dai, Changsong Lei, Shaofeng Wang, Feifei Zuo, Yajie Wang, Yaqian Liang, Xiaoming Deng, Cuixia Ma, Yong-Jin Liu, Hongan Wang

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료로 최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩