TL;DR

📋 2026년 3월 20일 오늘의 논문

오늘은 'AI의 공간 감각'이라는 주제로 두 편을 모았어요. 우리가 사진 한 장만 봐도 물체의 깊이감을 느끼는 것처럼, AI도 평면 데이터만으로 3D 세계를 이해할 수 있을까요? 놀랍게도, 별도의 3D 교본 없이도 입체를 꿰뚫어 보는 방법들이 속속 등장하고 있어요.

[☝️]. 영상 만드는 AI가 3D도 이해한다고? 별도 3D 데이터 없이 공간 추론 끌어올린 비결

[✌️]. 라벨 없이 3D 형상을 매칭하는 새로운 대조 학습법, 지도 학습마저 뛰어넘다

[☝️]. 영상 만드는 AI가 3D도 이해한다고? 별도 3D 데이터 없이 공간 추론 끌어올린 비결

Generation Models Know Space: Unleashing Implicit 3D Priors for Scene Understanding

#3D #3D scene understanding #Latent World Simulator #MLLM #adaptive gated fusion #denoising #denoising features #diffusion

💡 TL;DR 한마디로, 영상 생성 AI 속에 숨어있던 3D 감각을 꺼내 쓰는 방법이에요. 영화감독이 촬영하면서 자연스럽게 공간감을 익히듯, 비디오 생성 모델도 영상을 만들며 3D 구조를 이미 체득하고 있었거든요. VEGA-3D는 이 숨겨진 3D 지식을 뽑아내서, 3D 학습 데이터 없이도 AI의 공간 이해력을 크게 높였어요.

🔍 핵심 발견

영상 생성 AI 내부에 진짜 3D 감각이 있다는 걸 눈으로 확인했어요. 마치 애니메이터가 캐릭터를 여러 각도로 그리다 보면 자연스럽게 입체 감각이 생기는 것처럼요. 시간순으로 매끄러운 영상을 만들려다 보니 3D 구조까지 저절로 익힌 거예요.

기존 최고 성능 모델들을 뛰어넘었는데요, 핵심은 '추가 3D 데이터가 전혀 필요 없다'는 점이에요. 기존 방법들은 별도의 3D 정보를 넣어줘야 했거든요. 그 수고 없이도 더 좋은 결과를 낸 거예요.

비디오 생성 모델에서 딱 적당한 수준의 특징을 뽑아내는 게 비결이에요. 커피를 내릴 때 물 온도가 중요하듯, 노이즈 수준을 잘 맞춰야 3D 정보가 가장 풍부하게 나와요. 너무 깨끗해도, 너무 지저분해도 안 돼요.

의미 정보와 공간 정보의 균형을 AI가 스스로 조절해요. 사진 속 '이건 컵이다'라는 정보와 '컵이 어디에 있다'라는 정보를, 상황에 따라 자동으로 배합하는 거예요. 칵테일 바텐더가 재료 비율을 조절하는 것과 비슷해요.

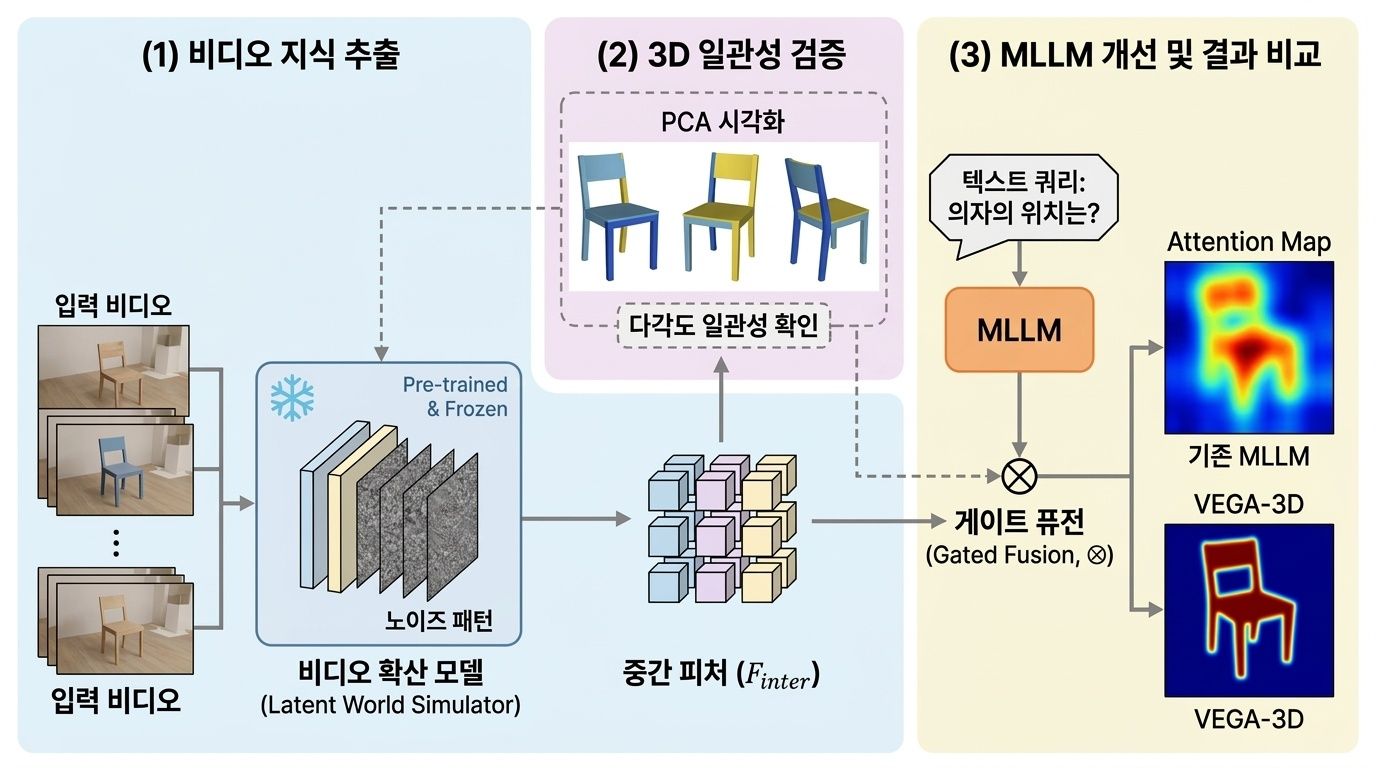

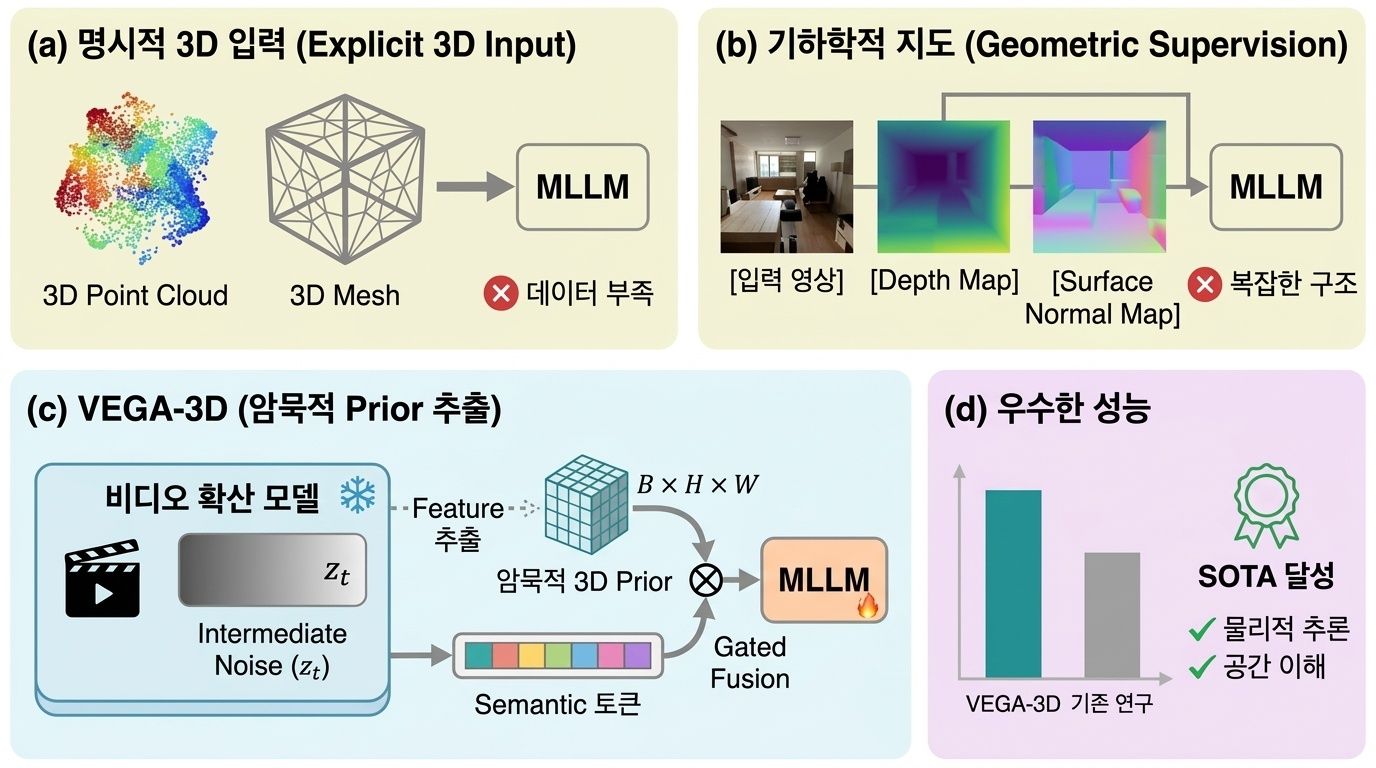

패러다임 비교 및 VEGA-3D의 기여 — 기존 MLLM 방법론들이 (a) 명시적 3D 입력이나 (b) 복잡한 기하학적 supervision에 의존하여 겪는 한계를 보여주고, (c) VEGA-3D가 비디오 생성 모델에서 암묵적 3D priors를 추출하여 이 문제를 해결하고 (d) 우수한 성능을 달성하는 과정을 비교하여 시각화합니다.

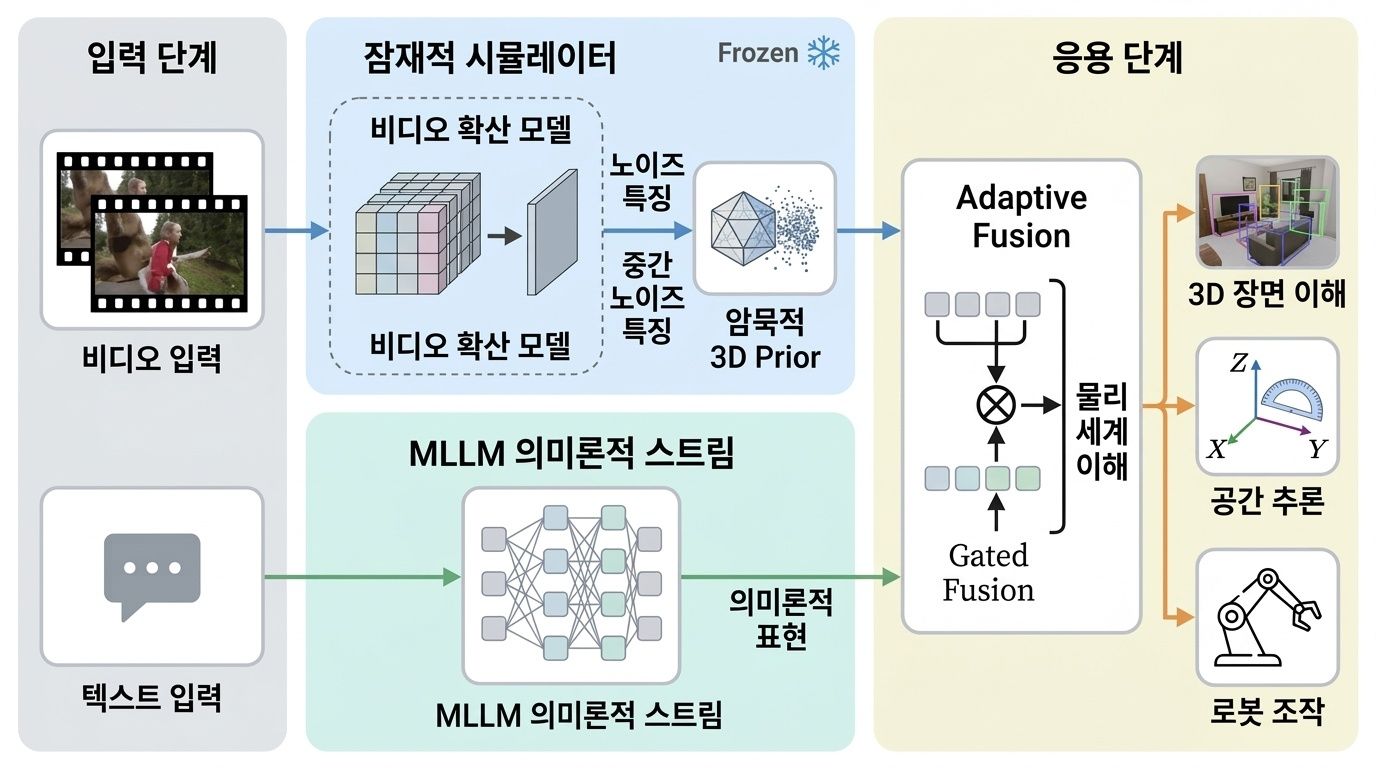

VEGA-3D 프레임워크 개요 — VEGA-3D 프레임워크의 고수준 아키텍처를 보여줍니다. frozen된 비디오 생성 모델을 'Latent World Simulator'로 재활용하여 암묵적 3D priors를 추출하고, 이를 Adaptive Gated Fusion을 통해 MLLM의 semantic stream과 통합하는 전체 과정을 시각화합니다.

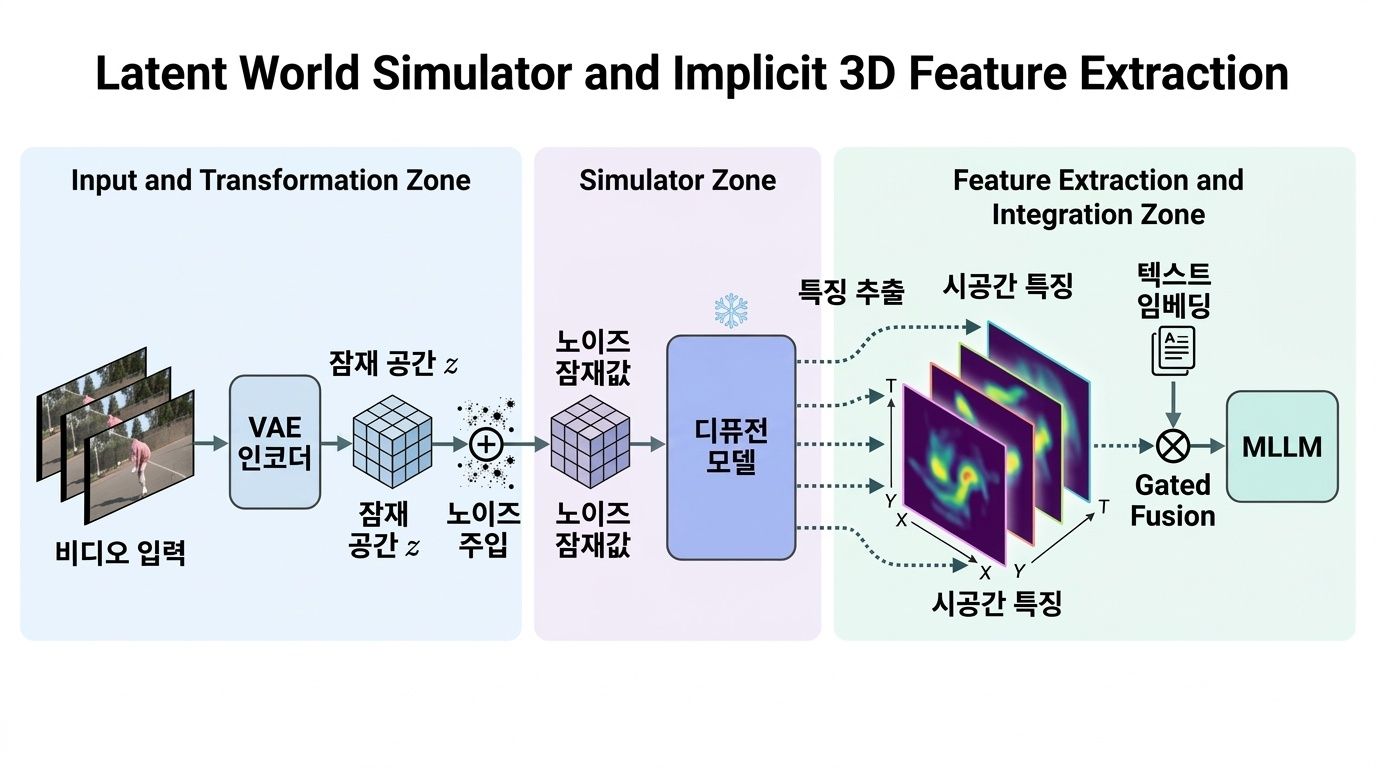

잠재 세계 시뮬레이터 및 암묵적 3D 특징 추출 — 'Latent World Simulator'가 어떻게 작동하는지 상세히 보여줍니다. 입력 비디오 시퀀스가 VAE를 통해 잠재 공간으로 매핑된 후, 노이즈 주입(noise injection)을 통해 중간 노이즈 레벨에서 spatiotemporal features가 추출되는 과정을 시각화합니다.

🛠️ 실무 시사점

3D 데이터를 따로 모으지 않아도 돼요. 깊이 센서나 3D 스캔 장비 없이도 AI에 공간 감각을 심어줄 수 있어요. 데이터 구축 비용이 크게 줄어드는 거예요.

기존 멀티모달 AI에 플러그인처럼 끼워 넣을 수 있어요. 이미 쓰고 있는 AI 시스템을 크게 바꾸지 않고도 공간 이해력을 업그레이드할 수 있다는 뜻이에요.

로봇이 물건을 잡거나, 자율주행차가 주변을 파악하는 데 바로 활용할 수 있어요. 실제 물리 환경에서 동작하는 AI에 특히 유용해요.

소라(Sora)나 런웨이(Runway) 같은 대형 영상 생성 모델이 이미 갖고 있는 3D 지식을 재활용하는 거예요. 처음부터 3D 전용 모델을 만들 필요가 없으니 비용이 절약돼요.

📄 Generation Models Know Space: Unleashing Implicit 3D Priors for Scene Understanding [Submitted on 19 Mar 2026] Xianjin Wu, Dingkang Liang, Tianrui Feng, Kui Xia, Yumeng Zhang, Xiaofan Li, Xiao Tan, Xiang Bai

[✌️]. 라벨 없이 3D 형상을 매칭하는 새로운 대조 학습법, 지도 학습마저 뛰어넘다

Unsupervised Contrastive Learning for Efficient and Robust Spectral Shape Matching

#contrastive learning #functional maps #spectral shape matching #3D shape correspondence #unsupervised learning #Laplace-Beltrami #pointwise map #non-rigid registration

💡 TL;DR 비강체 3D 형상 매칭을 위한 최초의 비지도 대조 학습 기반 접근법을 제안합니다. 긍정/부정 유사도 쌍을 활용한 대조 학습 프레임워크와 기존의 고비용 함수 맵 솔버를 제거한 간소화된 아키텍처를 통합하여, 계산 효율성과 매칭 정확도 모두에서 기존 SOTA를 능가하며 심지어 지도 학습 기법까지 초월하는 성능을 달성합니다.

🔍 핵심 발견

비지도 대조 학습을 3D 형상 매칭에 최초로 도입하여, cross-contrastive loss와 self-contrastive loss를 결합한 Hybrid Similarity Generator로 특징 표현의 일관성(consistency)과 변별력(discriminability)을 동시에 향상시켰습니다.

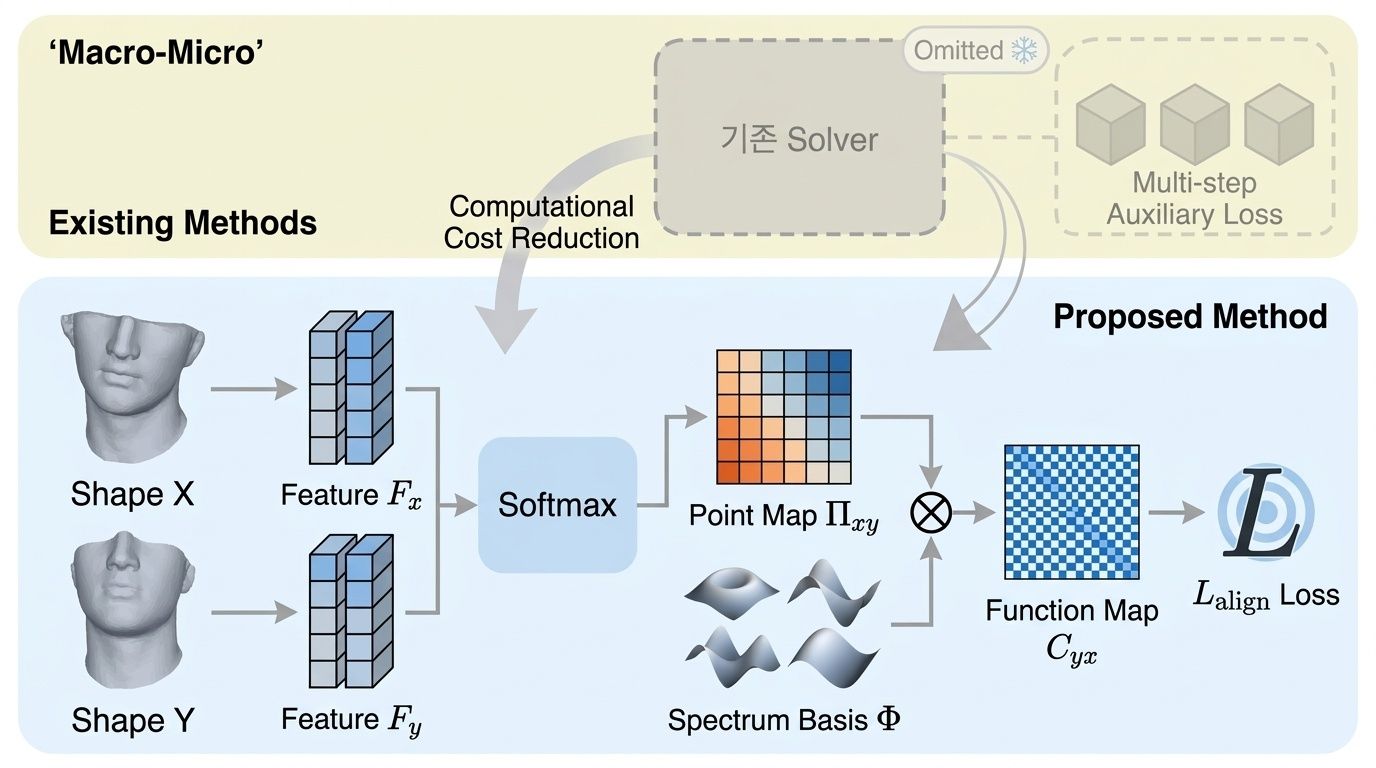

기존 딥 함수 맵 방법들이 의존하던 계산 비용이 큰 함수 맵 솔버와 다수의 보조 손실 함수를 완전히 제거한 간소화된 아키텍처를 설계하여, 계산 효율성을 크게 개선했습니다. Softmax 연산자와 스펙트럼 기저 투영만으로 포인트와이즈 맵과 함수 맵을 계산합니다.

기존 딥 함수 맵 방법들이 의존하던 계산 비용이 큰 함수 맵 솔버와 다수의 보조 손실 함수를 완전히 제거한 간소화된 아키텍처를 설계하여, 계산 효율성을 크게 개선했습니다. Softmax 연산자와 스펙트럼 기저 투영만으로 포인트와이즈 맵과 함수 맵을 계산합니다.

두 개의 브랜치(대조 학습 + 간소화된 함수 맵)를 통합 파이프라인으로 결합함으로써, 정확도와 효율성 간의 트레이드오프를 극복하고 두 지표 모두에서 SOTA를 달성했습니다.

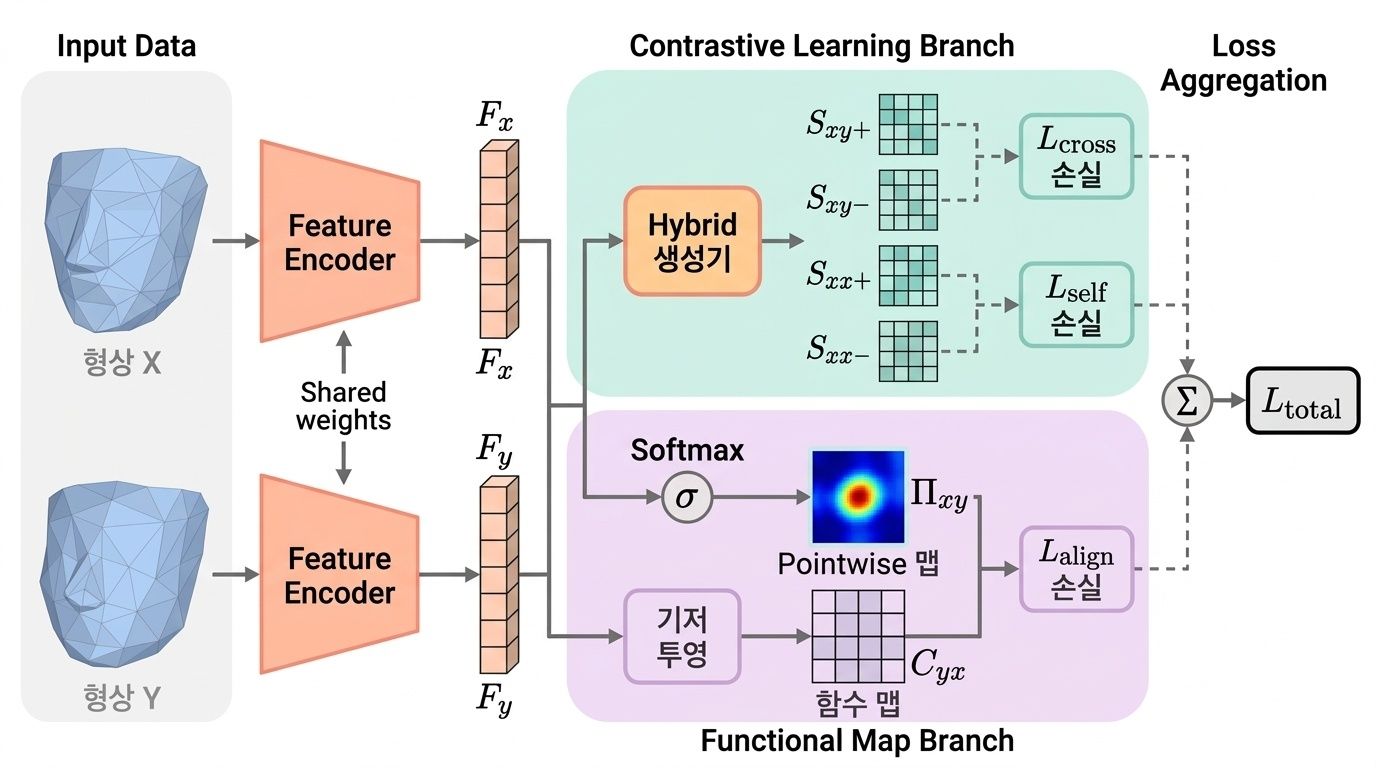

제안된 방법론의 전체 아키텍처 — 입력 3D 형상 X와 Y로부터 특징 Fx, Fy를 추출하는 과정, 추출된 특징을 사용하여 Hybrid Similarity Generator를 통해 긍정 및 부정 유사도 쌍(Sxy+, Sxy-, Sxx+, Sxx-)을 생성하고 Lcross 및 Lself 손실을 계산하는 대조 학습 브랜치, 그리고 Softmax 연산자로 포인트와이즈 맵 Πxy를 계산하고 스펙트럼 기저 투영으로 함수 맵 Cyx를 계산하여 Lalign 손실을 적용하는 단순화된 함수 맵 학습 브랜치를 포함하는 전체 2-브랜치 파이프라인을 보여줍니다. 최종적으로 모든 손실이 합쳐져 Ltotal이 되는 과정을 시각화합니다.

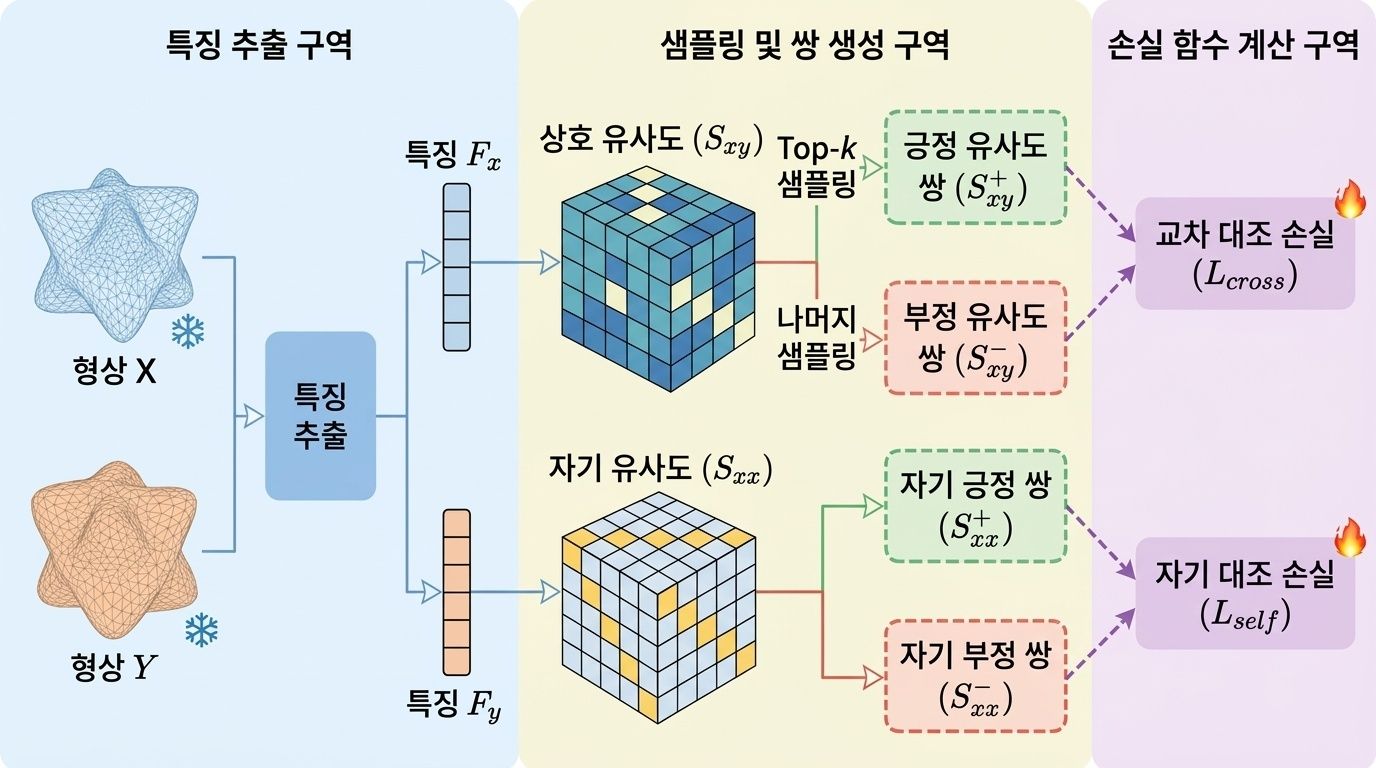

비지도 대조 학습 프레임워크 상세 — 두 형상 X와 Y의 특징 Fx, Fy로부터 유사도 점수 행렬 Sxy가 계산되는 과정을 보여줍니다. 이 Sxy를 기반으로 top-k 샘플링 및 나머지 샘플링을 통해 긍정 유사도 쌍 (Sxy+)과 부정 유사도 쌍 (Sxy-)이 어떻게 생성되는지 시각화합니다. 또한, 각 형상 X와 Y 내에서 자기 유사도 Sxx 및 Sxx- 쌍이 생성되는 과정을 포함하여, cross-contrastive loss (Lcross)와 self-contrastive loss (Lself)가 이들 쌍으로부터 어떻게 계산되는지 상세하게 설명합니다.

단순화된 함수 맵 학습 브랜치 및 기존 방법론과의 비교 — 제안된 방법의 단순화된 함수 맵 학습 브랜치(특징 Fx, Fy에서 Softmax를 통한 포인트와이즈 맵 Πxy 계산, 스펙트럼 기저 투영을 통한 함수 맵 Cyx 계산, 그리고 Lalign 손실 적용)의 흐름을 보여줍니다. 이와 대조적으로, 기존 딥 함수 맵 방법론에서 일반적으로 사용되는 계산 비용이 많이 드는 함수 맵 솔버와 다수의 보조 손실 함수가 생략되었음을 명확히 강조하여 제안된 방법의 효율성을 부각시킵니다.

🛠️ 실무 시사점

고비용 함수 맵 솔버를 제거함으로써, 3D 형상 매칭 시스템의 실시간 또는 대규모 처리가 가능해지며, 산업용 3D 스캔 정합이나 디지털 트윈 구축 등 실용적 응용에 직접 적용 가능합니다.

비지도 학습 기반이므로 라벨링된 대응점 데이터 없이도 학습이 가능하여, 의료 영상(장기 형상 매칭)이나 고고학적 유물 분석 등 전문 라벨이 부족한 도메인에서의 활용 가능성이 높습니다.

위상 불일치와 비등거리 변형에도 강건한 성능을 보여, 실세계에서 발생하는 노이즈나 스캔 아티팩트가 있는 3D 데이터에 대한 신뢰성 있는 매칭이 가능합니다.

📄 Unsupervised Contrastive Learning for Efficient and Robust Spectral Shape Matching [Submitted on 19 Mar 2026] Feifan Luo, Hongyang Chen

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료로 최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩