TL;DR

📋 2026년 3월 20일 오늘의 논문

오늘은 AI의 '감각'을 확장하는 연구를 가져왔어요. 우리가 글로 읽을 때와 귀로 들을 때 이해력이 다르듯, AI도 똑같은 문제를 겪고 있거든요. 더 적은 데이터로 이 격차를 메운 영리한 방법, 같이 살펴봐요.

[☝️] 음성 AI, 텍스트만큼 똑똑해질 수 있을까? 데이터 10분의 1로 해낸 비결

[☝️]. 음성 AI, 텍스트만큼 똑똑해질 수 있을까? 데이터 10분의 1로 해낸 비결

Closing the Gap Between Text and Speech Understanding in LLMs

#LLM #active data selection #alignment #catastrophic forgetting #cross-modal #cross-modal distillation #distillation #edge

💡 TL;DR 시리나 빅스비에게 말로 물어보면 글로 물어볼 때보다 답이 부실하다고 느낀 적 있나요? 이게 바로 '텍스트-음성 이해 격차'예요. SALAD라는 프레임워크가 이 격차를 6.2%까지 좁혔어요. 한마디로, 경쟁 모델보다 데이터를 10배나 적게 쓰고도 더 잘 알아듣는 AI를 만든 거예요.

🔍 핵심 발견

SALAD-7B는 음성 이해 정확도 75.4%를 기록했어요. 텍스트와의 격차는 겨우 6.2%예요. 경쟁 모델들은 17~20%나 벌어졌거든요. 비싼 데이터 없이도 이만큼 된다는 게 핵심이에요.

새 기술을 배우면 옛 기술을 까먹잖아요? AI도 마찬가지예요. 그런데 SALAD는 음성을 배우면서도 텍스트 실력을 거의 그대로 유지했어요. 텍스트 성능 저하가 -0.9%에 불과해요. 피아노 치던 사람이 기타까지 배웠는데 피아노 실력은 안 줄어든 셈이에요.

보통 음성 AI를 만들려면 엄청난 양의 데이터가 필요해요. SALAD는 경쟁 모델 대비 약 10분의 1 데이터만 썼어요. 적은 재료로 맛있는 요리를 해낸 것과 같아요. 비용 부담이 확 줄어들죠.

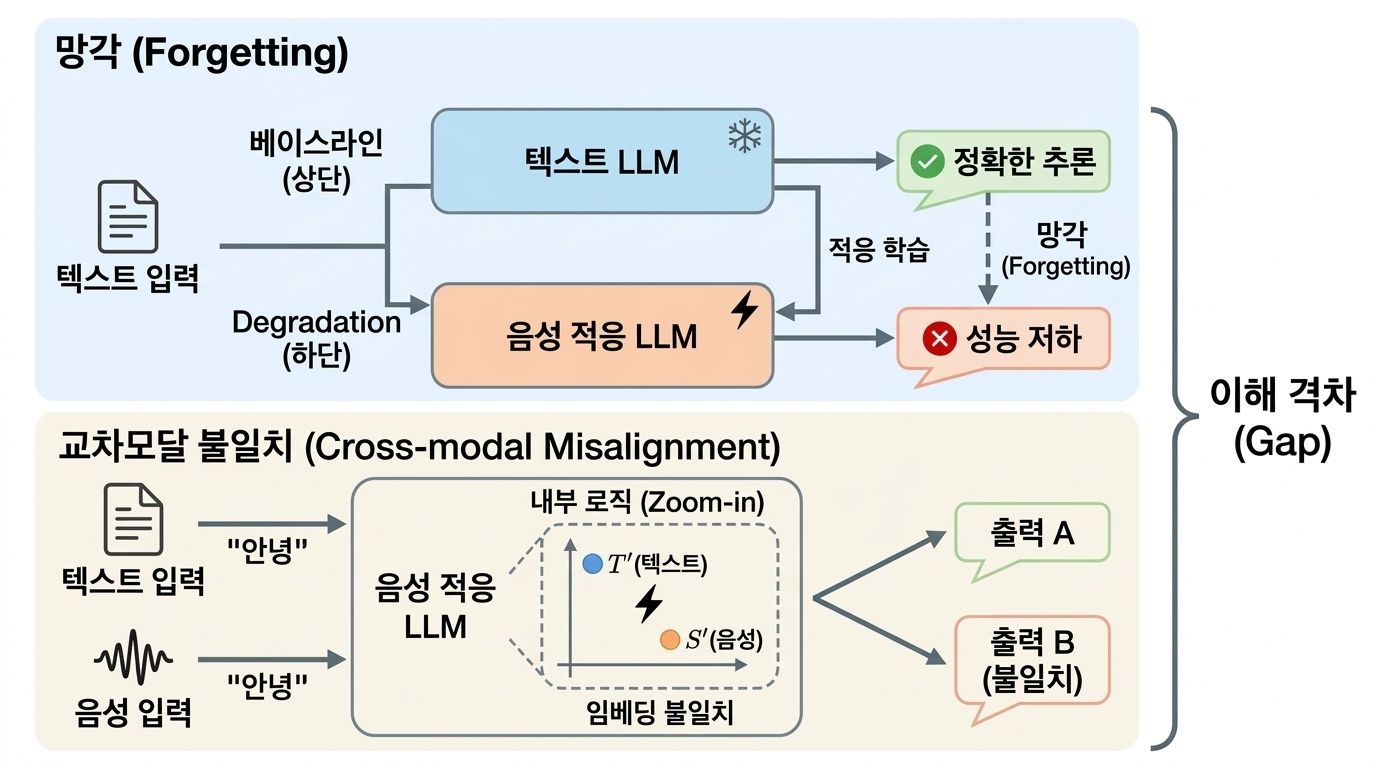

이 연구가 특별한 건 '왜 격차가 생기는지'를 먼저 진단했다는 거예요. 원인을 '까먹음(forgetting)'과 '감각 불일치(cross-modal misalignment)'로 나눴어요. 병원에서 진단 먼저 하고 처방하는 것처럼요.

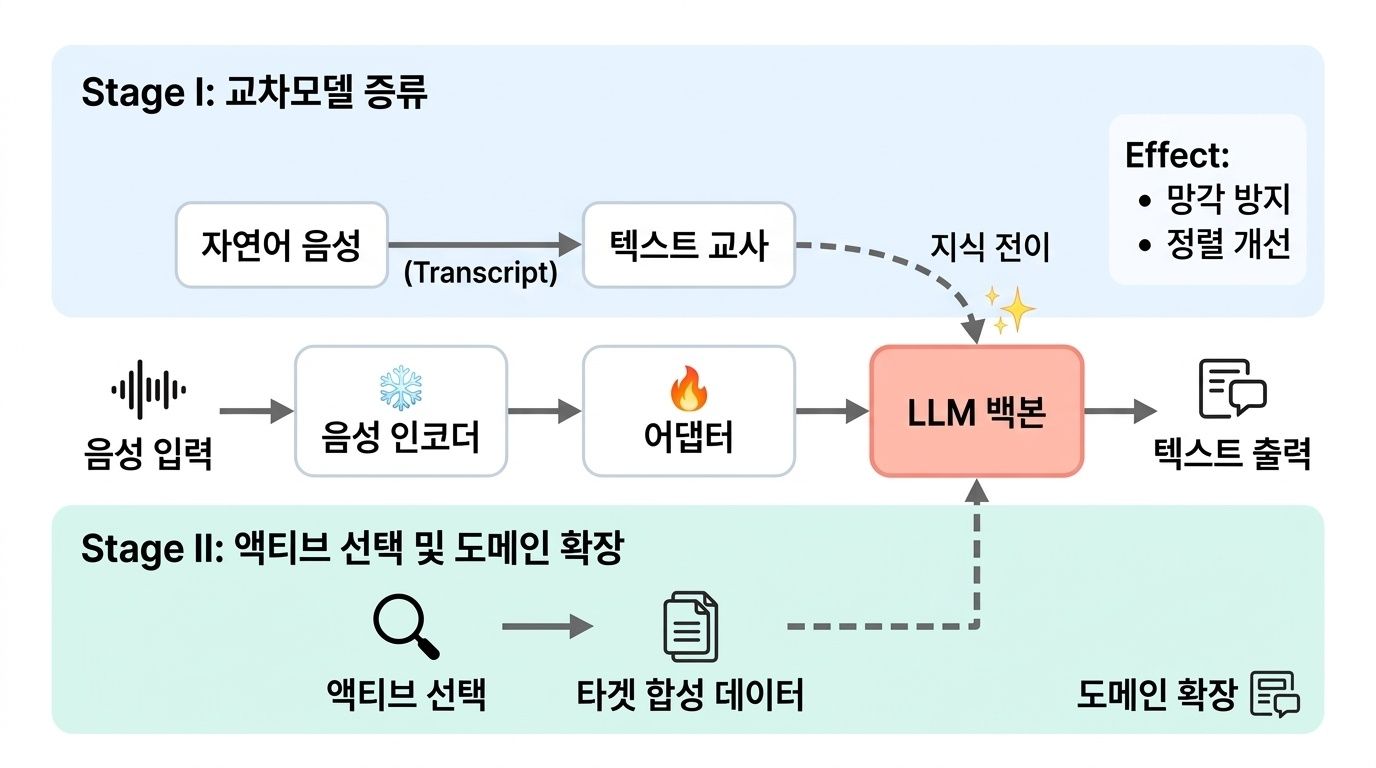

SALAD 전체 파이프라인 — SALAD 모델의 전체 아키텍처와 두 단계 학습(Stage I: 자연어 음성 데이터 기반 Distillation, Stage II: Active Selection을 통한 도메인 확장) 과정을 보여주는 다이어그램을 생성하세요. 음성 인코더, 어댑터, LLM 백본, 그리고 음성 입력이 텍스트 출력으로 변환되는 흐름을 포함해야 합니다.

텍스트-음성 이해 격차 개념 — LLM에서 발생하는 'forgetting'(텍스트 기반 LLM의 기존 텍스트 능력 상실)과 'cross-modal misalignment'(의미론적으로 동일한 텍스트 및 음성 입력에 대한 LLM 출력 불일치)를 시각적으로 설명하는 개념 다이어그램을 생성하세요. 이상적인 LLM과 음성 적응형 LLM 간의 성능 차이를 대비하여 보여줄 수 있습니다.

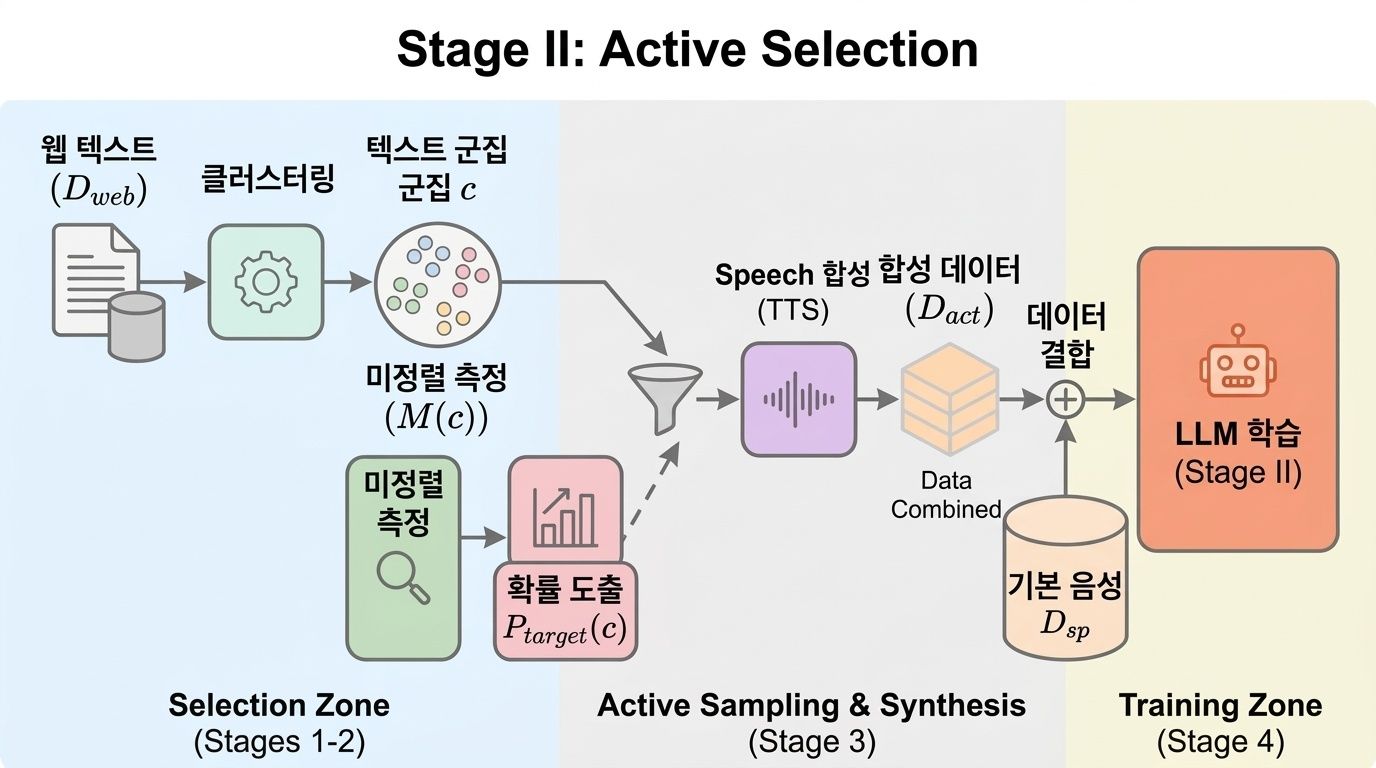

SALAD Active Selection 메커니즘 — SALAD의 Stage II 학습 단계에서 Active Selection을 통해 합성 음성 데이터(Dactive)가 어떻게 선택되는지 상세한 흐름을 보여주는 다이어그램을 생성하세요. 광범위한 텍스트 코퍼스(Dweb)를 클러스터링하고, 각 클러스터의 cross-modal misalignment(M(c))를 계산하며, 이를 기반으로 Ptarget(c)를 도출하여 합성 데이터를 샘플링하고, Dspeech와 결합하는 과정을 포함해야 합니다.

🛠️ 실무 시사점

거대 데이터셋이 없는 스타트업도 음성 AI를 만들 수 있게 돼요. 예를 들어, 소규모 팀이 고객 상담 음성봇을 구축할 때 이 방법을 쓸 수 있어요.

약점만 골라서 보강하는 Active Selection 전략은 음성뿐 아니라 이미지, 영상 등 다른 감각을 AI에 추가할 때도 쓸 수 있어요. 범용적인 레시피인 셈이죠.

기존 AI의 텍스트 능력을 해치지 않고 음성 기능을 얹을 수 있어요. 이미 잘 돌아가는 챗봇에 음성 기능만 추가하고 싶은 서비스에 딱이에요.

공개 데이터만으로 재현 가능해요. 누구나 따라 해볼 수 있다는 뜻이에요. 음성 AI 연구의 진입 장벽이 낮아지는 거죠.

📄 Closing the Gap Between Text and Speech Understanding in LLMs [Submitted on 15 Oct 2025 (v1), last revised 23 Feb 2026 (this version, v2)] Santiago Cuervo, Skyler Seto, Maureen de Seyssel, Richard He Bai, Zijin Gu, Tatiana Likhomanenko, Navdeep Jaitly, Zakaria Aldeneh

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어떠셨나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료로 최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩