TL;DR

📋 2026년 4월 3일 오늘의 논문

3B 파라미터만으로 ScreenSpot-V2에서 91.6% 정확도를 달성하여, 최대 72B(24배 큰) 모델과 대등하거나 이를 능가하는 GUI grounding 성능을 보여줍니다. 소형 모델도 정밀한 설계만 있으면 대형 모델에 필적할 수 있음을 입증한 결과입니다.

ScreenSpot-Pro에서 53.3%를 기록해 동급 3B 모델들(대부분 30%대)을 크게 앞서고, 7B 모델인 GUI-Owl(54.9%)에 근접합니다. 파라미터 효율성 측면에서 획기적인 성과입니다.

AndroidWorld에서 28.0%, OSWorld에서 19.8%의 task success rate를 달성했습니다. 단순 grounding을 넘어 실제 멀티스텝 네비게이션까지 소형 모델로 수행 가능함을 보여줍니다.

RLVR(Reinforcement Learning with Verifiable Rewards) 훈련과 Zoom-in 메커니즘의 결합으로, SFT만으로는 달성하기 어려운 정밀한 좌표 타겟팅과 멀티스텝 추론 능력을 확보했습니다.

Ferret-UI Lite: Lessons from Building Small On-Device GUI Agents

#efficient_models #foundation_models #multimodal #optimization #robotics_embodied #Chain-of-Thought #GRPO #GUI agent #RLVR #SFT #Zoom-in mechanism #agent #dense reward #function calling #grounding

💡 TL;DR 스마트폰에서 "알람 7시로 맞춰줘"라고 말하면, AI가 시계 앱을 열고, 알람 탭을 누르고, 시간을 설정하는 일련의 과정을 대신해준다고 상상해보세요. 이것이 바로 GUI 에이전트가 하는 일입니다. 하지만 2025년까지 이 일을 제대로 해내는 모델들은 대부분 수십~수백 억 개의 파라미터를 가진 거대한 클라우드 모델이었습니다.

문제는 명확합니다. 거대한 모델은 서버에서 돌아가므로, 사용자의 화면 스크린샷을 클라우드로 전송해야 합니다. 은행 앱, 메시지, 건강 데이터가 담긴 화면을 외부 서버로 보내는 것은 심각한 프라이버시 문제입니다. 또한 네트워크 지연(latency)으로 실시간 상호작용이 어렵고, 오프라인 환경에서는 아예 작동하지 않습니다.

그렇다면 스마트폰 위에서 직접 돌아갈 수 있을 만큼 작으면서도, 화면을 정확하게 '읽고' 올바른 버튼을 눌러주는 모델을 만들 수 있을까요? Apple의 연구팀은 바로 이 질문에 답하기 위해 Ferret-UI Lite를 설계했습니다.

🔍 핵심 발견

Ferret-UI Lite의 핵심 아이디어는 한 마디로 요약됩니다: 작지만 똑똑하게 만들기. 30억 개 파라미터라는 제한된 예산 안에서, 큰 모델이 '무차별적 규모'로 해결하는 문제를 '정밀한 설계'로 풀어냅니다.

비유하자면, 대형 모델이 모든 도구가 갖춰진 대형 공구상자라면, Ferret-UI Lite는 꼭 필요한 도구만 골라 넣은 여행용 멀티툴입니다. 도구 수는 적지만, 각 도구가 최적으로 배치되어 있어 실전에서 대형 공구상자 못지않은 성능을 냅니다.

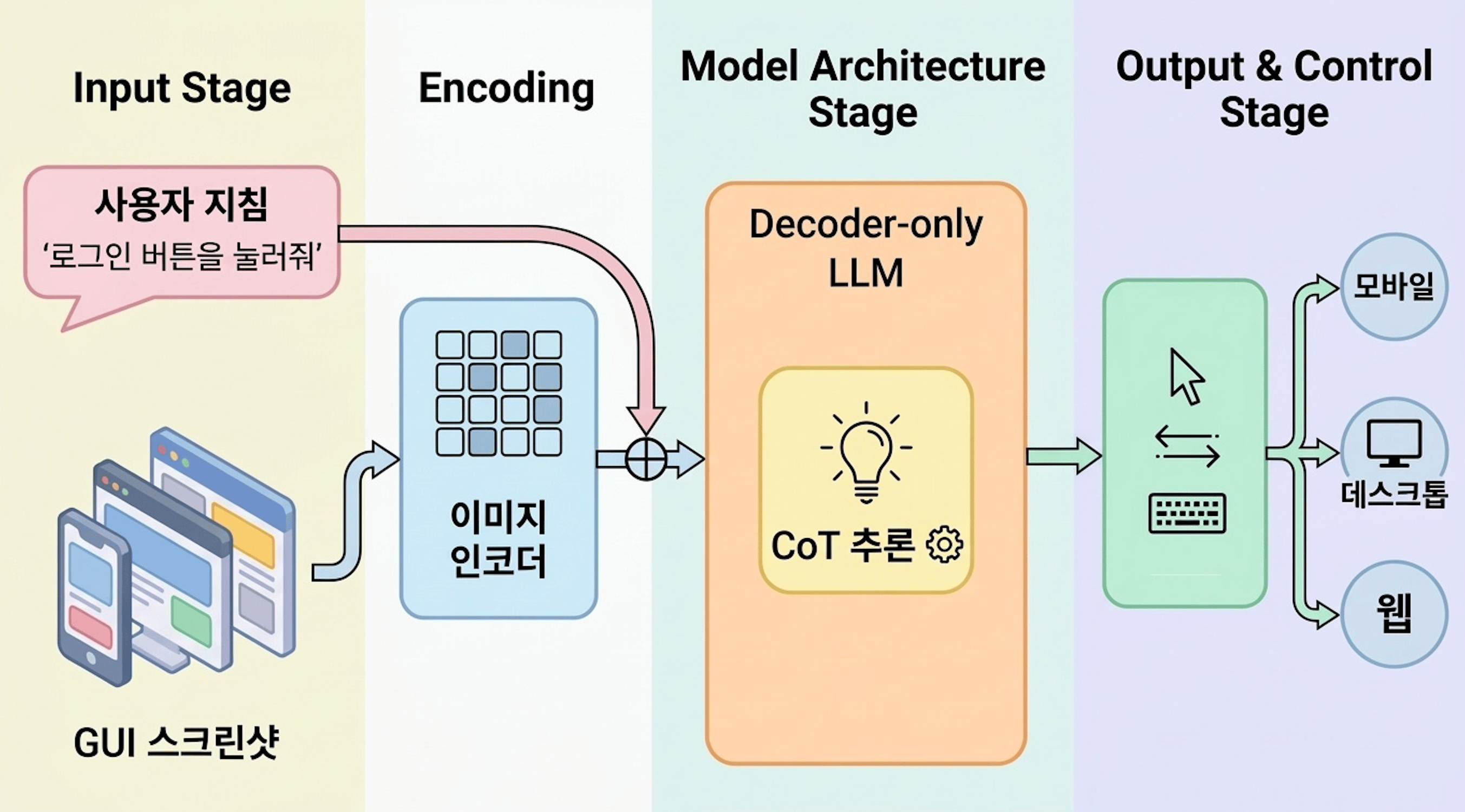

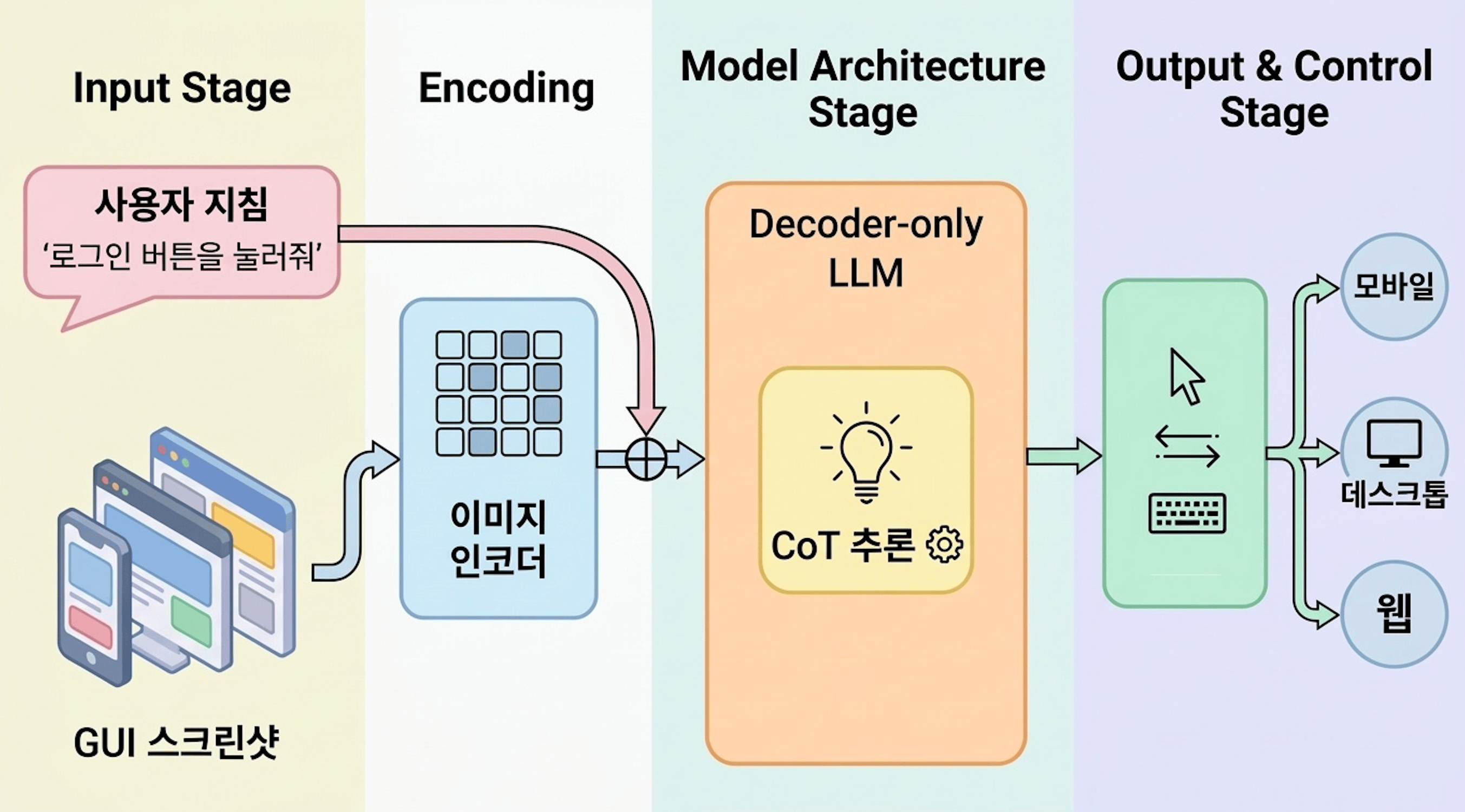

이 멀티툴의 구조를 살펴보면, Ferret-UI Lite는 이미지 인코더와 Decoder-only LLM으로 구성된 엔드-투-엔드 아키텍처입니다. 사용자의 자연어 지시("설정 앱에서 Wi-Fi를 켜줘")와 현재 화면의 스크린샷을 입력받아, Chain-of-Thought 추론을 거쳐 구체적인 액션(tap, swipe 등)을 직접 출력합니다. 중간에 별도의 UI 요소 감지기나 OCR 모듈 없이, 스크린샷 한 장에서 바로 행동으로 이어지는 것이 특징입니다.

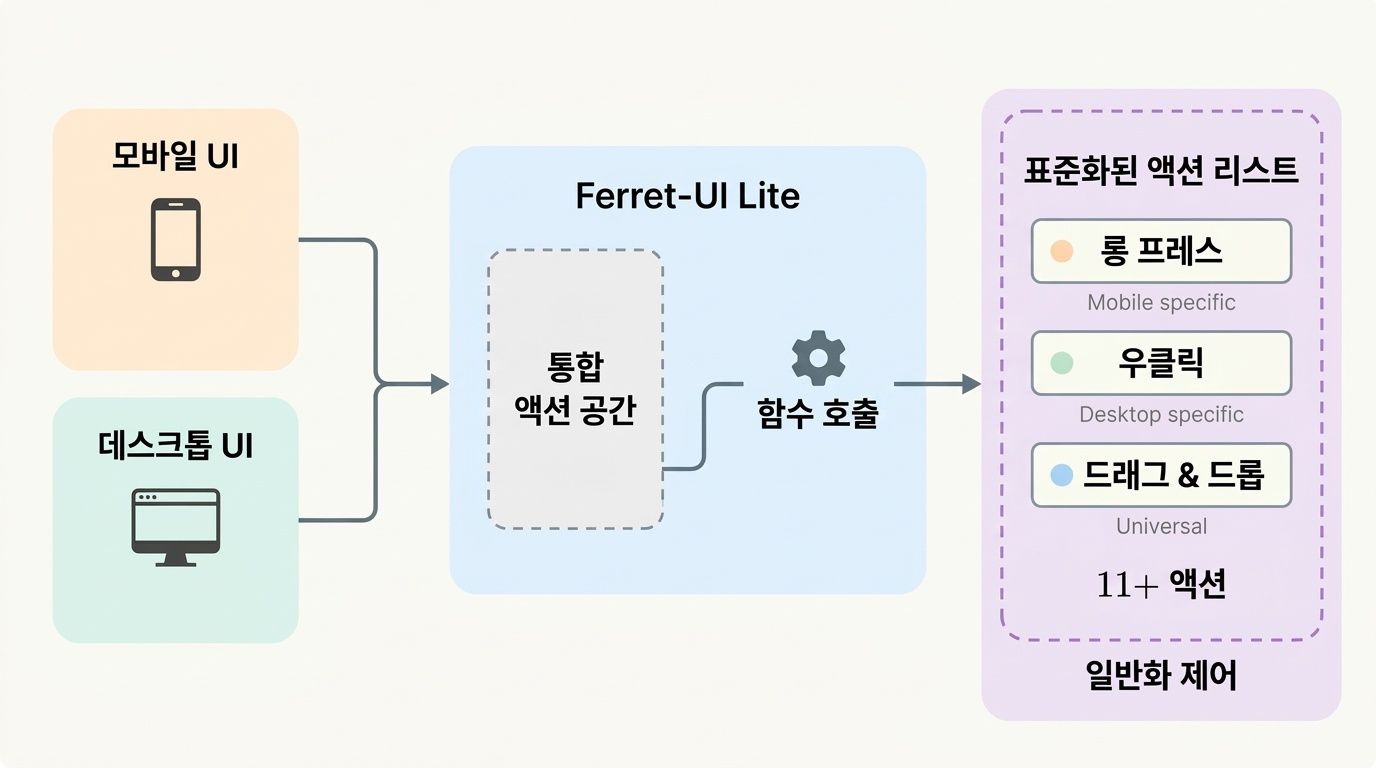

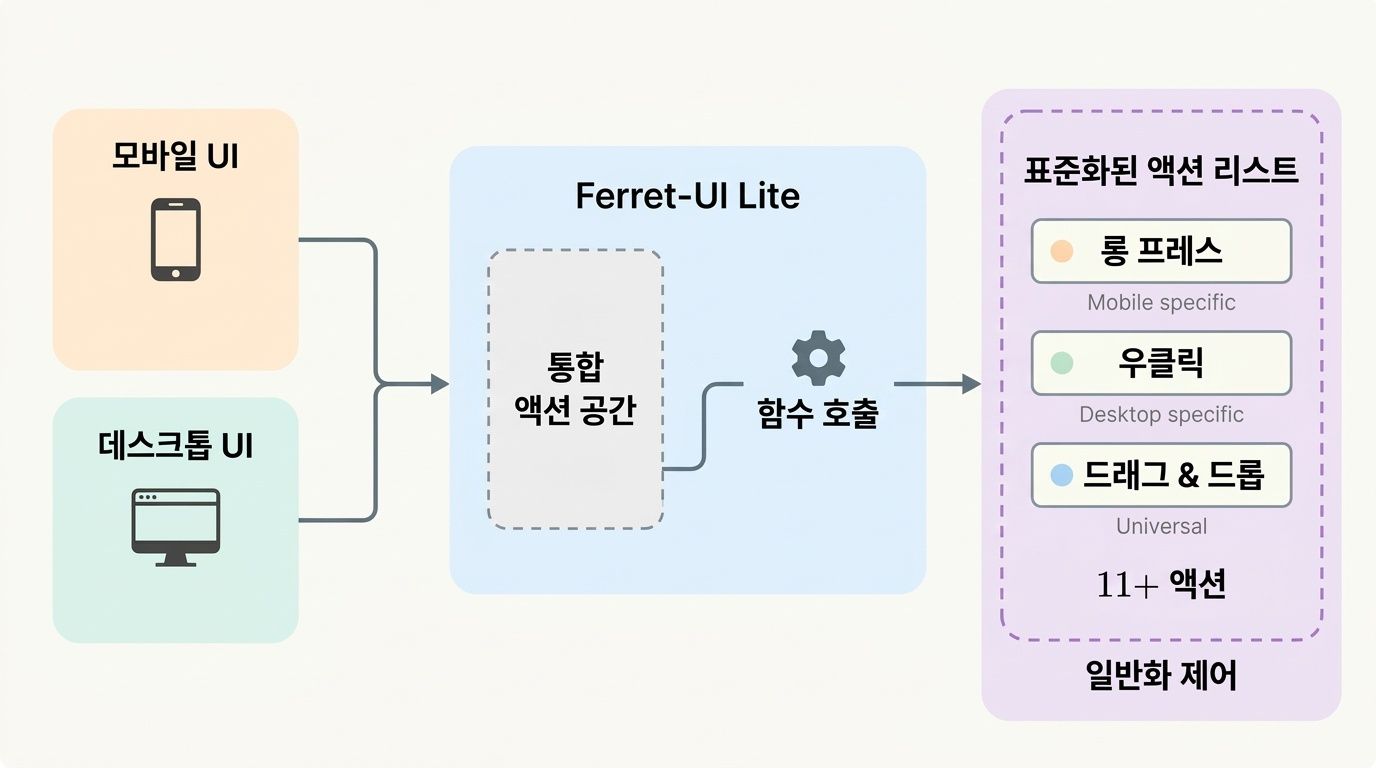

기존 GUI 에이전트들과의 결정적 차이는 세 가지입니다. 첫째, 통합 액션 공간 — 모바일(tap, long_press, swipe), 데스크톱(right_click, double_click, press_hotkey), 웹을 하나의 함수 호출 체계로 통합했습니다. 마치 하나의 리모컨으로 TV, 에어컨, 조명을 모두 제어하는 것과 같습니다. 둘째, 2단계 학습 — SFT로 기초 체력을 다진 후, RLVR로 정밀도를 끌어올리는 투-스테이지 훈련을 채택했습니다. 셋째, Zoom-in 메커니즘 — 작은 아이콘이나 텍스트를 놓치지 않도록, 관심 영역을 확대해서 다시 보는 시각적 도구를 모델이 스스로 사용할 수 있게 했습니다.

특히 통합 액션 공간의 설계가 인상적입니다. 11개 이상의 대표 액션을 tap(x, y), swipe(start_x, start_y, end_x, end_y) 같은 함수 호출 형태로 정형화하여, 모델의 출력이 곧바로 실행 가능한 코드가 됩니다. 이는 LLM의 tool-use 능력을 GUI 제어에 그대로 활용하는 영리한 설계입니다.

🤔 어떻게 작동하는가

Step 1: 화면 인식 — 스크린샷을 '이해'하기

사용자의 현재 화면 스크린샷이 이미지 인코더에 입력됩니다. 이 인코더는 화면 속 버튼, 텍스트, 아이콘 등 UI 요소들을 시각적 특징(visual feature)으로 변환합니다. 마치 사람이 화면을 훑어보며 "여기에 검색창이 있고, 저기에 메뉴 버튼이 있네"라고 파악하는 것과 같습니다. 사용자의 자연어 지시도 함께 입력되어, 모델은 '무엇을 해야 하는지'와 '화면이 어떻게 생겼는지'를 동시에 처리합니다.

사용자 지침과 GUI 스크린샷을 입력으로 받아, 이미지 인코더와 Decoder-only LLM을 통해 Chain-of-Thought 추론을 수행하고, 모바일, 데스크톱, 웹 등 다양한 플랫폼에서 GUI 장치를 제어하는 낮은 수준의 액션 정책을 직접 출력하는 Ferret-UI Lite의 엔드-투-엔드 아키텍처를 보여줍니다.

Step 2: Chain-of-Thought 추론 — 생각하고 나서 행동하기

화면을 인식한 후 바로 행동하지 않고, 먼저 '생각'합니다. "사용자가 Wi-Fi를 켜달라고 했으니, 먼저 설정 메뉴를 찾아야 하고, Wi-Fi 토글이 보이므로 그것을 탭해야겠다"는 식의 추론 과정을 텍스트로 생성합니다. 이 CoT(Chain-of-Thought) 추론은 특히 여러 단계를 거쳐야 하는 복잡한 작업에서 정확도를 크게 높여줍니다.

Step 3: 액션 출력 — 함수 호출로 GUI 제어

추론이 끝나면, 모델은 구체적인 액션을 함수 호출 형태로 출력합니다. 예를 들어 tap(0.45, 0.32)는 화면의 (45%, 32%) 좌표를 탭하라는 의미이고, textentry("Hello")는 텍스트를 입력하라는 명령입니다. 이 출력은 별도의 후처리 없이 OS의 접근성 API를 통해 직접 실행될 수 있습니다.

Ferret-UI Lite는 서로 다른 운영체제와 인터페이스를 통합적으로 제어하기 위해 '통합 액션 공간'을 정의합니다. 총 11개 이상의 대표적인 액션을 함수 호출 방식으로 정형화하여, 모델이 프로그래밍 언어의 도구 사용(Tool-use) 능력과 유사하게 GUI를 제어하도록 합니다. 이를 통해 모바일의 'Long Press'나 데스크톱의 'Right Click' 같은 플랫폼 고유의 동작을 하나의 모델 내에서 일관되게 처리할 수 있습니다. 이러한 설계는 모델의 출력 해석력을 높이고 다양한 환경으로의 일반화를 용이하게 합니다.

Step 4: SFT — 기초 체력 만들기 (1단계 학습)

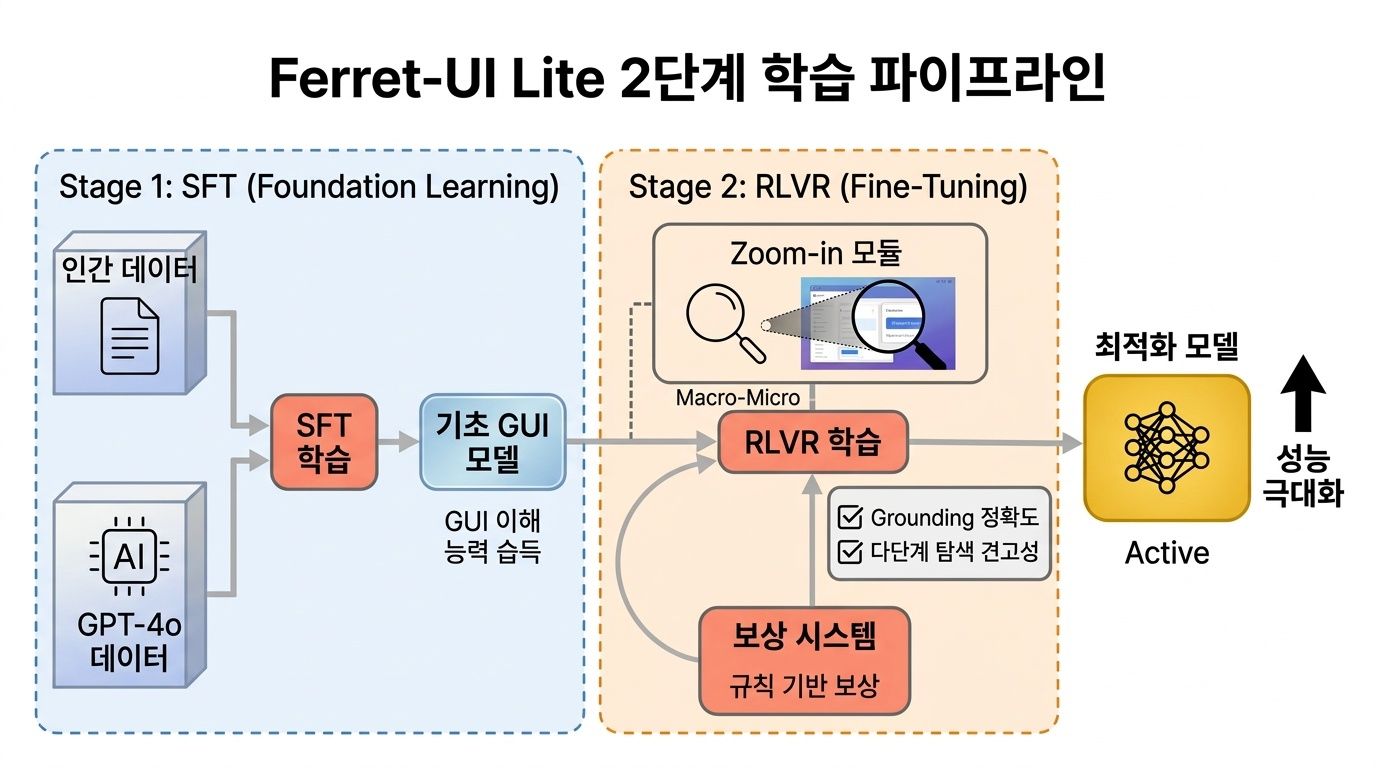

모델의 첫 번째 학습 단계는 Supervised Fine-Tuning입니다. 인간이 실제로 앱을 조작한 궤적(trajectory) 데이터와 GPT-4o로 생성한 합성 데이터를 혼합하여 10,000 스텝 동안 학습합니다. 이 단계에서 모델은 화면을 읽고, 올바른 액션 유형을 선택하고, 대략적인 좌표를 찍는 기본 능력을 익힙니다. 운전으로 비유하면, 교본을 읽고 교습소 코스를 도는 단계입니다.

Step 5: RLVR — 정밀 사격 훈련 (2단계 학습)

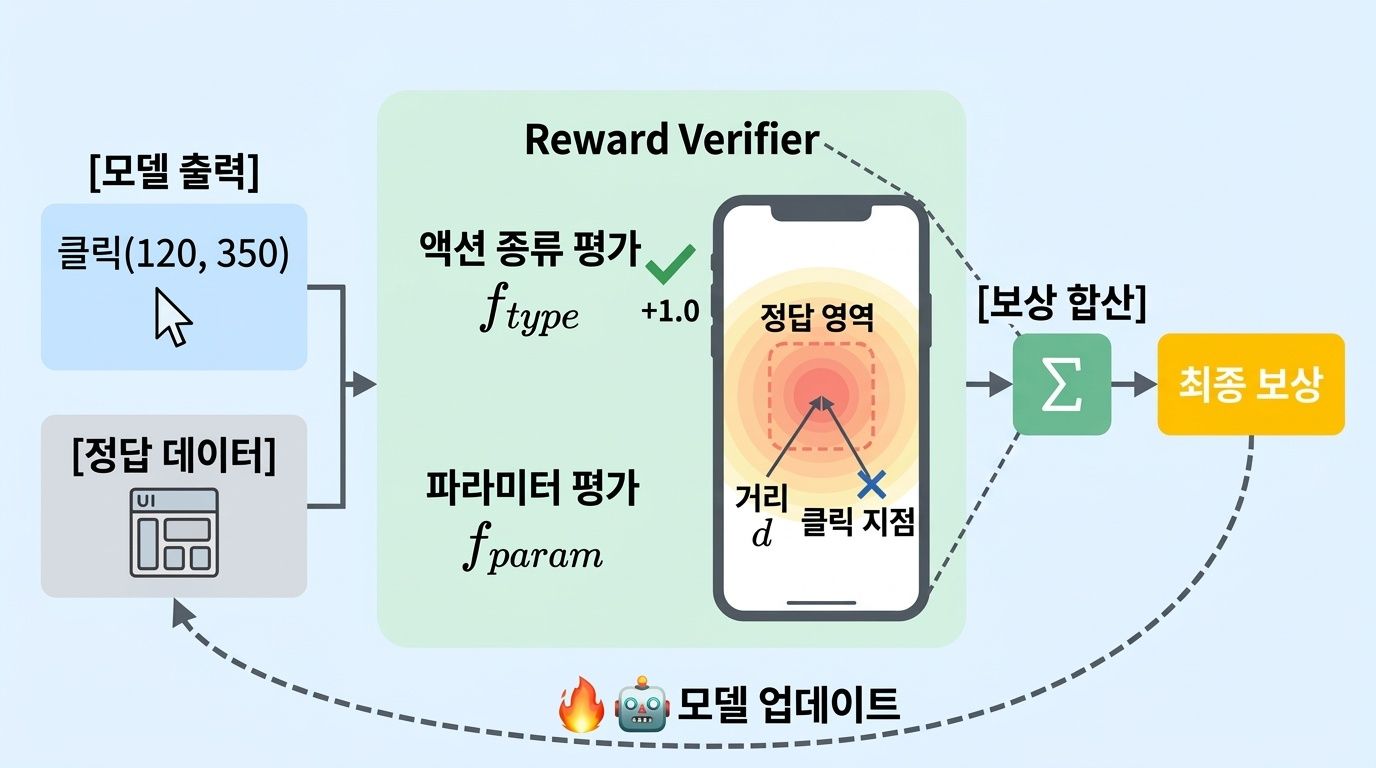

SFT가 '대략 맞는' 수준까지 끌어올렸다면, RLVR은 '정확히 맞는' 수준으로 다듬습니다. 핵심은 보상 설계입니다. 모델의 출력을 정답과 자동 비교하여 점수를 매기되, 이진(맞다/틀리다)이 아닌 연속적인 보상을 줍니다. 클릭 좌표가 정답 영역의 중심에 가까울수록 높은 점수, 멀수록 낮은 점수를 받아, 모델이 점진적으로 더 정밀한 타겟팅을 학습합니다. GRPO(Group Relative Policy Optimization) 알고리즘으로 1,500 스텝 학습합니다.

RLVR 단계에서는 모델의 출력을 정답과 비교하여 자동으로 계산되는 검증 가능한 보상 체계를 사용합니다. 보상은 크게 올바른 액션 종류를 선택했는지를 평가하는 f_type과, 클릭 좌표 등의 파라미터가 얼마나 정확한지를 평가하는 f_param으로 나뉩니다. 특히 위치 기반 액션의 경우, 정답 영역과의 거리에 따라 점진적인 점수를 부여하는 Dense Reward 설계를 통해 모델이 더 정밀하게 UI 요소를 타겟팅하도록 유도합니다. 이러한 보상 설계는 소형 모델이 복잡한 UI 환경에서도 높은 성공률을 기록하게 하는 핵심 요소입니다.

Step 6: Zoom-in 메커니즘 — 돋보기로 다시 보기

작은 아이콘이나 빽빽한 UI 요소가 있는 화면에서는 일반 해상도로는 정확한 좌표를 잡기 어렵습니다. Ferret-UI Lite는 이를 해결하기 위해 RLVR 단계에서 'Zoom-in' 메커니즘을 도입합니다. 모델이 특정 영역을 확대해서 다시 관찰하는 시각적 도구를 사용할 수 있게 한 것입니다. 마치 지도 앱에서 핀치-줌으로 골목길을 확대하는 것처럼, 관심 영역을 확대하여 더 정밀한 grounding을 수행합니다.

모델의 성능 극대화를 위해 SFT와 RLVR로 구성된 2단계 학습 파이프라인을 채택했습니다. SFT 단계에서는 인간의 작업 데이터와 GPT-4o를 통해 생성된 합성 데이터를 혼합하여 기초적인 GUI 이해 능력을 학습합니다. 이후 RLVR 단계에서는 규칙 기반의 검증 가능한 보상을 사용하여 Grounding 정확도와 다단계 탐색의 견고성을 세밀하게 조정합니다. 특히 RLVR 과정에서 'Zoom-in' 메커니즘을 도입하여 작은 UI 요소에 대한 인식 정밀도를 높였습니다.

🛠️ 실험이 말해주는 것

Ferret-UI Lite의 실험 결과는 "크기가 전부가 아니다"라는 메시지를 명확하게 전달합니다.

GUI grounding 벤치마크에서 Ferret-UI Lite(3B)는 ScreenSpot-V2에서 91.6%, ScreenSpot-Pro에서 53.3%, OSWorld-G에서 61.2%를 달성했습니다. 특히 ScreenSpot-Pro에서 동급 3B 모델들이 대부분 30%대에 머무르는 반면, Ferret-UI Lite는 53.3%로 압도적인 차이를 보였고, 7B 규모의 GUI-Owl(54.9%)에 거의 근접했습니다. 이는 단순히 모델 크기를 키우는 것이 아닌, 학습 전략의 정교함이 성능을 결정할 수 있음을 보여줍니다.

GUI 네비게이션(실제 멀티스텝 작업 수행)에서는 AndroidWorld 28.0%, OSWorld 19.8%의 success rate를 기록했습니다. 이 수치는 grounding보다 낮아 보이지만, 멀티스텝 네비게이션은 한 번의 클릭이 아닌 여러 단계의 연쇄 행동이 모두 성공해야 하므로 본질적으로 더 어려운 과제입니다. RLVR 훈련이 특히 이 멀티스텝 시나리오에서 SFT 대비 의미 있는 개선을 가져왔으며, Dense Reward 설계와 Zoom-in 메커니즘이 각각 grounding 정밀도와 소형 요소 인식에 기여했음이 확인되었습니다.

⚡️ 현실 세계의 임팩트

Apple의 Siri 진화 방향을 직접적으로 보여주는 연구입니다. 업계 분석가들은 Ferret-UI Lite의 기술이 향후 iOS에 통합되어, Siri가 앱을 '보고' 직접 제어하는 능력을 갖추게 될 것으로 전망합니다. 클라우드 없이 온디바이스로 작동하므로, Apple의 프라이버시 중심 철학과 완벽하게 부합합니다.

GUI 에이전트 분야 전체에 '소형화 가능성'의 벤치마크를 제시했습니다. ShowUI(2B), SeeClick, CogAgent, UI-TARS 등 경쟁 모델들이 있는 가운데, 3B로 72B급 성능을 내는 것이 가능함을 실증한 것은 온디바이스 AI 에이전트의 실용화를 크게 앞당기는 결과입니다.

Ferret 시리즈(Ferret → Ferret-UI → Ferret-UI 2 → Ferret-UI Lite)는 Apple ML Research의 대표적 연구 라인으로, 시각적 grounding에서 GUI 이해, 그리고 실제 제어까지의 진화를 보여줍니다. 오픈소스 코드가 GitHub(apple/ml-ferret)에 공개되어 커뮤니티의 후속 연구를 촉진하고 있습니다.

Google의 Android 에이전트, Microsoft의 UFO 프로젝트 등과 함께, OS 레벨에서 AI가 GUI를 직접 조작하는 '에이전틱 OS' 시대의 도래를 알리는 핵심 연구 중 하나입니다.

☝️ 연구의 계보

Ferret-UI Lite는 Apple의 Ferret 연구 계보 위에 있습니다. 2023년의 FERRET(시각적 grounding), 2024년의 Ferret-UI(모바일 UI 이해, ECCV 2024), Ferret-UI 2(다중 플랫폼 UI 이해)를 거쳐, Ferret-UI Lite는 '이해'에서 '행동'으로의 도약을 이뤘습니다. 동시에, SeeClick(2024), CogAgent(2024), ShowUI(2025, CVPR 2025), UI-TARS(2025) 등 GUI 에이전트 연구의 급성장 흐름 속에 있으며, 특히 RLVR을 GUI 에이전트에 적용한 선구적 사례로 자리잡고 있습니다.

🫸 강점과 한계

[강점] 3B 파라미터로 최대 72B 모델에 필적하는 성능을 달성한 것은 온디바이스 AI의 실용성을 입증하는 강력한 결과입니다.

[강점] SFT + RLVR 2단계 학습 파이프라인과 Dense Reward 설계는 소형 모델에서 정밀도를 끌어올리는 체계적인 방법론을 제시합니다.

[강점] 모바일/데스크톱/웹을 아우르는 통합 액션 공간 설계는 하나의 모델로 다양한 플랫폼을 커버할 수 있게 하여, 실제 배포 시 관리 복잡도를 크게 줄여줍니다.

[한계] 학습 데이터가 Android, 웹, 데스크톱 중심이며 iOS 데이터는 포함되어 있지 않아, Apple의 실제 제품 통합까지는 추가 데이터 확보와 적응이 필요합니다.

[한계] 짧고 단순한 1~2단계 작업에서는 강력하지만, 긴 멀티스텝 워크플로우에서의 성공률(OSWorld 19.8%)은 아직 개선 여지가 큽니다.

[시사점] 이 연구는 AI 에이전트의 미래가 반드시 '더 큰 모델'이 아닌, '더 똑똑한 학습'에 있을 수 있음을 시사하며, 프라이버시와 성능을 동시에 잡는 온디바이스 패러다임의 가능성을 열었습니다.

📄 Ferret-UI Lite: Lessons from Building Small On-Device GUI Agents [Submitted on 30 Sep 2025] Zhen Yang, Zi-Yi Dou, Di Feng, Forrest Huang, Anh Nguyen, Keen You, Omar Attia, Yuhao Yang, Michael Feng, Haotian Zhang, Ram Ramrakhya, Chao Jia, Jeffrey Nichols, Alexander Toshev, Yinfei Yang, Zhe Gan

안녕하세요 제이슨입니다!🤗 오늘 다이제스트 어땠나요?

코멘트가 있으시면 저에게 LinkedIn DM으로 알려주세요.

피드백은 향후 양질의 뉴스래터 컨텐츠 퀄리티 향상에 큰 도움이 됩니다! 🙌

최신 논문을 씹고 뜯고 소화하는 PaperGOAT — 🗞️🐐

Greatest of All Time — It’s You🫵

AI 엔지니어 3,000명이 아침마다 여는 논문 브리핑⚡️

유료급 퀄리티, 하지만 무료❗️

최신 AI 논문 요약 뉴스래터를 매일 받아보세요📩